വലിയ ഭാഷാ മോഡലുകൾക്കും മനുഷ്യർക്കും എങ്ങനെ ഒരുമിച്ച് തന്ത്രപരമായ തീരുമാനങ്ങൾ എടുക്കാൻ കഴിയും

കഴിഞ്ഞ ഒരു വർഷമായി, ലാർജ് ലാംഗ്വേജ് മോഡലുകൾ (എൽഎൽഎം) ലോകത്തെ ഞെട്ടിച്ചു. 2022 ന്റെ അവസാനത്തിൽ ഓപ്പൺഎഐയുടെ ചാറ്റ്ജിപിടി അവതരിപ്പിച്ചപ്പോൾ എൽഎൽഎമ്മുകളുടെ വിപ്ലവകരമായ കഴിവുകൾ പൊതുജനങ്ങളിൽ ഭൂരിഭാഗവും ആദ്യമായി തുറന്നുകാട്ടി.

എല്ലാത്തരം ജോലികളും പൂർത്തിയാക്കാൻ ചാറ്റ്ജിപിടി ഉപയോഗിക്കുന്ന എൽഎൽഎമ്മുകളെക്കുറിച്ച് യാതൊരു അറിവുമില്ലാത്ത ആളുകളെ പെട്ടെന്ന് ഞങ്ങൾ കണ്ടു. “എനിക്ക് 10 വയസ്സുള്ളതുപോലെ ഒരു സൂപ്പർനോവ എന്നോട് വിശദീകരിക്കുക” പോലുള്ള ചോദ്യങ്ങൾ സങ്കീർണ്ണമായ ഒരു ആശയം എടുക്കുകയും അത് കൂടുതൽ വ്യക്തമായി വിവരിക്കാൻ ശ്രമിക്കുകയും ചെയ്യുന്നു. ഒരു ലേഖനം മുതൽ കവിത വരെ എല്ലാം രചിക്കാൻ ഉപയോക്താക്കൾക്ക് ചാറ്റ്ജിപിടി ഉപയോഗിക്കാം, ചിലപ്പോൾ നിർദ്ദിഷ്ട ശൈലികളും ഫോമുകളും അഭ്യർത്ഥിക്കുമ്പോൾ അവിശ്വസനീയമാംവിധം ഹാസ്യ ഫലങ്ങളോടെ. വാലന്റൈൻസ് ഡേയെക്കുറിച്ച് ഒരു രസകരമായ ലിമെറിക്ക്? കുഴപ്പമില്ല. Star Wars-നെ കുറിച്ച് ഒരു സോണറ്റ്? നിനക്ക് കിട്ടി. കൂടുതൽ പ്രായോഗിക മേഖലയിൽ, കോഡ് സൃഷ്ടിക്കാനും ഡീബഗ് ചെയ്യാനും ഭാഷ വിവർത്തനം ചെയ്യാനും ഇമെയിലുകൾ എഴുതാനും മറ്റും ചാറ്റ്ജിപിടി ഉപയോഗിക്കുന്നത് ഞങ്ങൾ കാണുന്നു.

ഇത് ജോലിക്കോ കളിയ്ക്കോ ആകട്ടെ, ഉപയോക്താക്കൾക്ക് ഇപ്പോൾ തിരഞ്ഞെടുക്കാൻ കൂടുതൽ ഓപ്ഷനുകൾ ഉണ്ട്. OpenAI ChatGPT പുറത്തിറക്കിയതിന് തൊട്ടുപിന്നാലെ, മറ്റ് എതിരാളികളായ എൽഎൽഎമ്മുകൾ സ്വന്തമായി അരങ്ങേറ്റം നടത്തി. ഗൂഗിൾ ബാർഡിനെ പുറത്തിറക്കി, കൂടാതെ എൽഎൽഎമ്മുകളുടെ ആന്തരിക സംവിധാനങ്ങൾ പഠിക്കാനും ക്രമീകരിക്കാനും വിപുലീകരിക്കാനും അക്കാദമിക് വിദഗ്ധരെ പ്രാപ്തമാക്കുന്ന ഒരു ലൈസൻസിന് കീഴിൽ മെറ്റ എൽഎൽഎഎംഎ പുറത്തിറക്കി. അതിനുശേഷം, എല്ലാ വലുപ്പത്തിലുമുള്ള കമ്പനികൾ ഒന്നുകിൽ സ്വന്തം എൽഎൽഎം വികസിപ്പിക്കുകയോ അല്ലെങ്കിൽ ഒരു മൂന്നാം കക്ഷി എൽഎൽഎമ്മിന്റെ കഴിവുകൾ പ്രയോജനപ്പെടുത്തി ഉപഭോക്താക്കൾക്ക് എങ്ങനെ മൂല്യം നേടാമെന്ന് കണ്ടെത്താൻ ശ്രമിക്കുകയോ ചെയ്യുന്നതിനാൽ ടെക് വ്യവസായത്തിൽ പ്രകടമായ തിരക്ക് ഉണ്ടായിട്ടുണ്ട്.

ഇതെല്ലാം കണക്കിലെടുക്കുമ്പോൾ, ഉത്തരവാദിത്തത്തോടെയും ധാർമ്മികമായും എൽഎൽഎമ്മുകളെ അവരുടെ ബിസിനസ്സ് പ്രക്രിയകളിലേക്ക് എങ്ങനെ സംയോജിപ്പിക്കാമെന്ന് ബിസിനസുകൾ പരിഗണിക്കുന്നത് വിവേകപൂർണ്ണമാണ്. എൽഎൽഎമ്മുകൾ കൊണ്ടുവരുന്ന അപകടസാധ്യതകളും ഈ അപകടസാധ്യതകൾ എങ്ങനെ കൈകാര്യം ചെയ്യാനും ലഘൂകരിക്കാനും കഴിയുമെന്നും മനസിലാക്കിക്കൊണ്ട് ഓർഗനൈസേഷനുകൾ ആരംഭിക്കണം.

എൽഎൽഎമ്മുകളുടെ അപകടസാധ്യതകൾ മനസ്സിലാക്കുക

കഴിഞ്ഞ കുറച്ച് മാസങ്ങളായി എൽഎൽഎമ്മുകളുടെ പല ഉപയോക്താക്കളും കണ്ടെത്തിയതുപോലെ, എൽഎൽഎമ്മുകൾക്ക് നിരവധി പരാജയ മോഡുകൾ ഉണ്ട്, അവ പലപ്പോഴും വരുന്നു.

ഒന്നാമതായി, എൽഎൽഎമ്മുകൾ പലപ്പോഴും ലോകത്തെക്കുറിച്ചുള്ള വസ്തുതകളെ തെറ്റിദ്ധരിപ്പിക്കും. ഉദാഹരണത്തിന്, ഒരു പത്രപ്രവർത്തകൻ ചാറ്റ്ജിപിടിയോട് “എപ്പോഴാണ് ‘ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസ്’ സംബന്ധിച്ച ആദ്യത്തെ റിപ്പോർട്ട് ചെയ്തത്?” എന്ന് ചോദിച്ചപ്പോൾ, “1956 ജൂലൈ 10 ന് ഡാർട്ട്മൗത്ത് കോളേജിൽ നടന്ന ഒരു കോൺഫറൻസിനെക്കുറിച്ചുള്ള “യന്ത്രങ്ങൾക്ക് പഠിക്കാനും പ്രശ്നങ്ങൾ പരിഹരിക്കാനും ശാസ്ത്രജ്ഞർ പ്രവചിക്കാനും കഴിയും” എന്ന തലക്കെട്ടിലുള്ള ഒരു ലേഖനത്തിൽ മറുപടി ലഭിച്ചു.

ടൈംസ് പറയുന്നു, “1956 ലെ സമ്മേളനം യാഥാർത്ഥ്യമായിരുന്നു. ലേഖനം അങ്ങനെയല്ല.” അത്തരമൊരു പിശക് സാധ്യമാണ്, കാരണം നിങ്ങൾ ഒരു എൽഎൽഎമ്മിനോട് ഒരു ചോദ്യം ചോദിക്കുമ്പോൾ, അത് പരിശീലിപ്പിച്ച ഡാറ്റയെ അടിസ്ഥാനമാക്കി വിശ്വസനീയമായ ഒരു ഉത്തരം കെട്ടിച്ചമയ്ക്കാൻ കഴിയും. ഈ മതിഭ്രമങ്ങൾ പലപ്പോഴും മതിയായ വിവരങ്ങളിലും ചിലപ്പോൾ ശരിയായ വസ്തുതകളിലും ഉൾച്ചേർന്നിരിക്കുന്നു, അവ നമ്മൾ സമ്മതിക്കാൻ ആഗ്രഹിക്കുന്നതിനേക്കാൾ പലപ്പോഴും നമ്മെ വിഡ്ഢികളാക്കും.

രണ്ടാമതായി, അന്വേഷണ ഫലങ്ങൾ ഒരു എൽഎൽഎമ്മിന്റെ പരിശീലന ഡാറ്റയിൽ എൻകോഡ് ചെയ്ത പക്ഷപാതങ്ങളെ പ്രതിഫലിപ്പിച്ചേക്കാം. ചരിത്രപരമായ ഡാറ്റയെ അടിസ്ഥാനമാക്കിയുള്ള മോഡലുകൾ യഥാർത്ഥത്തിൽ ആ ഡാറ്റ സൃഷ്ടിച്ച ആളുകളുടെ പക്ഷപാതത്തിന് വിധേയമാണ് എന്നതാണ് ഇതിന് കാരണം. ഏതൊക്കെ തൊഴിലുകളോ വികാരങ്ങളോ “പുരുഷത്വം” അല്ലെങ്കിൽ “സ്ത്രീലിംഗം” പോലുള്ള സ്റ്റീരിയോടൈപ്പുകളെ പ്രതിഫലിപ്പിക്കുന്ന അവരുടെ പരിശീലന ഡാറ്റയിൽ പ്രത്യക്ഷപ്പെടുന്ന വാചകങ്ങൾ തമ്മിൽ എൽഎൽഎമ്മുകൾ ബന്ധം പുലർത്തുമെന്ന് ഗവേഷണങ്ങൾ തെളിയിച്ചിട്ടുണ്ട്.

മാത്രമല്ല, എൽഎൽഎമ്മുകളിലും ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസ് പ്രക്രിയകളിലും മാത്രമല്ല പക്ഷപാതം നിലനിൽക്കുന്നത്; ചിലപ്പോൾ അത് വളരെയധികം വർദ്ധിക്കുന്നു. ചിക്കാഗോയിൽ നിന്നുള്ള ചരിത്രപരമായ ഡാറ്റ അർത്ഥമാക്കുന്നത് ആ ഡാറ്റയെ അടിസ്ഥാനമാക്കിയുള്ള ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസ് അൽഗോരിതങ്ങൾ “റെഡ്ലൈനിംഗ്” എന്ന വിവേചനപരമായ പ്രക്രിയ വർദ്ധിപ്പിക്കുകയും ആഫ്രിക്കൻ അമേരിക്കക്കാരിൽ നിന്നുള്ള വായ്പാ അപേക്ഷകൾ യാന്ത്രികമായി നിഷേധിക്കുകയും ചെയ്തുവെന്ന് സിഎൻബിസി റിപ്പോർട്ട് ചെയ്തു.

മൂന്നാമതായി, യുക്തിസഹമായ ചിന്ത പ്രയോഗിക്കുന്നതിനും അക്കങ്ങളുമായി പ്രവർത്തിക്കുന്നതിനും എൽഎൽഎമ്മുകൾ പലപ്പോഴും ബുദ്ധിമുട്ടുന്നു. ലളിതമായ ഗണിതപരമായ ചോദ്യങ്ങൾ പലപ്പോഴും ശരിയായി പരിഹരിക്കപ്പെടുമെങ്കിലും, ഒരു ചോദ്യം പരിഹരിക്കാൻ ആവശ്യമായ യുക്തി കൂടുതൽ സങ്കീർണ്ണമാകുന്നു, ഒരു എൽഎൽഎം തെറ്റായ ഉത്തരത്തിൽ എത്താനുള്ള സാധ്യത കൂടുതലാണ്.

ഗൂഗിളിൽ നിന്നുള്ള ഒരു ബ്ലോഗ് പോസ്റ്റ് നിരീക്ഷിക്കുന്നതുപോലെ, സാധാരണ എൽഎൽഎമ്മുകളെ സിസ്റ്റം 1 ചിന്ത ഉപയോഗിക്കുന്നതായി കരുതാം, ഇത് “വേഗതയേറിയതും അവബോധജനകവും അനായാസവുമാണ്”, പക്ഷേ സിസ്റ്റം 2 ചിന്തയിലേക്ക് ടാപ്പുചെയ്യാനുള്ള കഴിവില്ല, ഇത് “മന്ദഗതിയിലുള്ളതും മനഃപൂർവ്വവും ശ്രമകരവുമാണ്.” പല ഗണിത ചോദ്യങ്ങൾക്കും ഉത്തരം നൽകാൻ ആവശ്യമായ ഘട്ടം ഘട്ടമായുള്ള ന്യായവാദത്തിന്റെ നിർണായക ഘടകമാണ് സിസ്റ്റം 2 ടൈപ്പ് ചിന്ത. ഗൂഗിളിന്റെ ക്രെഡിറ്റിൽ, അവരുടെ ബ്ലോഗ് പോസ്റ്റ് അവരുടെ എൽഎൽഎം, ബാർഡ്, സിസ്റ്റം 2 ചിന്തയുടെ അളവ് വർദ്ധിപ്പിക്കുന്നതിന് അവർ വികസിപ്പിക്കുന്ന ഒരു പുതിയ രീതി വിശദീകരിക്കുന്നു.

ഈ സന്ദർഭങ്ങളിൽ ഓരോന്നിലും, ഒരു എൽഎൽഎം ചോദ്യത്തിന് ആത്മവിശ്വാസമുള്ളതും കൃത്യവും നന്നായി എഴുതപ്പെട്ടതുമായ പ്രതികരണം രൂപപ്പെടുത്താൻ സാധ്യതയുണ്ട്. അത് ഒരു എൽഎൽഎമ്മിന്റെ ഏറ്റവും അപകടകരമായ ഭാഗമാണ്: ഒരു ഉത്തരം എല്ലായ്പ്പോഴും നൽകുന്നു, അത് സാങ്കൽപ്പികമോ പക്ഷപാതപരമോ തെറ്റോ ആണെങ്കിൽ പോലും.

ഈ പരാജയ മോഡുകൾ ഒരു എൽഎൽഎമ്മിൽ അടിസ്ഥാനമാക്കിയുള്ള ഒരു ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസ് മോഡലിന്റെ കൃത്യതയെ ബാധിക്കുക മാത്രമല്ല (ഉദാഹരണത്തിന്, വ്യാജ അവലംബങ്ങൾ അല്ലെങ്കിൽ തകർന്ന യുക്തി നിറഞ്ഞ ഒരു ലേഖനത്തിന്റെ സംഗ്രഹം സഹായകരമല്ല!) മാത്രമല്ല ധാർമ്മിക പ്രത്യാഘാതങ്ങളും ഉണ്ട്. ആത്യന്തികമായി, നിങ്ങളുടെ ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസ് മോഡലിന്റെ ഔട്ട്പുട്ടുകൾ കൃത്യതയില്ലാത്തതാണെങ്കിൽ നിങ്ങളുടെ ക്ലയന്റുകളും (റെഗുലേറ്റർമാരും) നിങ്ങളുടെ ബിസിനസ്സിനെ ഉത്തരവാദികളാക്കാൻ പോകുന്നു.

എൽഎൽഎമ്മുകളുടെ പോരായ്മകൾക്കെതിരെ ജാഗ്രത

തീർച്ചയായും, എൽഎൽഎമ്മുകൾ വികസിപ്പിക്കുന്ന ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസ് എഞ്ചിനീയർമാർ ഈ പരാജയ മോഡുകളുടെ സംഭവങ്ങൾ കുറയ്ക്കുന്നതിനും ഗാർഡ് റെയിലുകൾ ഇൻസ്റ്റാൾ ചെയ്യുന്നതിനും കഠിനമായി പരിശ്രമിക്കുന്നു – വാസ്തവത്തിൽ, ഈ പരാജയ മോഡുകൾ ഉണ്ടാകുന്നത് കുറയ്ക്കുന്നതിൽ ജിപിടി -4 കൈവരിച്ച പുരോഗതി ശ്രദ്ധേയമാണ്. എന്നിരുന്നാലും, പല ബിസിനസുകളും നല്ല കാരണങ്ങളാൽ മറ്റൊരു കമ്പനി ഹോസ്റ്റുചെയ്യുന്ന ഒരു മോഡലിന് മുകളിൽ അവരുടെ ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസ് പരിഹാരം നിർമ്മിക്കുന്നതിൽ മടുത്തു.

കോർപ്പറേഷനുകൾ അവരുടെ ഉടമസ്ഥതയിലുള്ള ഡാറ്റ സ്വന്തം ഐടി ഇൻഫ്രാസ്ട്രക്ചർ വിടാൻ അനുവദിക്കാൻ മടിക്കുന്നു, പ്രത്യേകിച്ചും ആ ഡാറ്റയ്ക്ക് അവരുടെ ക്ലയന്റുകളെക്കുറിച്ച് സെൻസിറ്റീവ് വിവരങ്ങൾ ഉള്ളപ്പോൾ. ആ സുരക്ഷാ പ്രശ്നത്തിനുള്ള പരിഹാരം ഒരു ആന്തരിക എൽഎൽഎം നിർമ്മിക്കുക എന്നതായിരിക്കാം, പക്ഷേ അതിന് സമയവും വിഭവങ്ങളും ഗണ്യമായ നിക്ഷേപം ആവശ്യമാണ്.

കൂടാതെ, എൽഎൽഎം സ്വന്തമാക്കാതെ, ഉപയോക്താക്കൾ മൂന്നാം കക്ഷി ഡവലപ്പർമാരുടെ കാരുണ്യത്തിലാണ്. ഒരു മൂന്നാം കക്ഷി അവരുടെ എൽഎൽഎം മോഡൽ കുറച്ച് അല്ലെങ്കിൽ മുന്നറിയിപ്പില്ലാതെ അപ്ഡേറ്റ് ചെയ്യില്ല എന്നതിന് ഒരു ഉറപ്പുമില്ല, അതുവഴി മേൽപ്പറഞ്ഞ പരാജയ മോഡുകളുടെ പുതിയ ഉദാഹരണങ്ങൾ അവതരിപ്പിക്കുന്നു; വാസ്തവത്തിൽ, ഒരു ഉൽ പാദന പരിതസ്ഥിതിയിൽ മോഡലുകൾ അപ് ഡേറ്റ് ചെയ്യുമ്പോൾ കർശനമായ നിയന്ത്രണം ഉണ്ടായിരിക്കാൻ ഒരാൾ ആഗ്രഹിക്കുന്നു, കൂടാതെ ഏതെങ്കിലും മാറ്റങ്ങൾ ഉണ്ടായേക്കാവുന്ന താഴേത്തട്ടിലുള്ള ആഘാതം വിലയിരുത്താൻ സമയം ആവശ്യമാണ്.

അവസാനമായി, ഉപയോഗ കേസിനെ ആശ്രയിച്ച്, ക്ലയന്റ് ഡിമാൻഡ്, നെറ്റ് വർക്ക് കാലതാമസം, ചെലവുകൾ എന്നിവയെ പിന്തുണയ്ക്കുന്നതിനുള്ള സ്കെയിലബിലിറ്റിയെക്കുറിച്ച് ആശങ്കകൾ ഉണ്ടാകാം.

ഈ കാരണങ്ങളാൽ, പല ബിസിനസുകളും അവരുടെ ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസ് പരിഹാരങ്ങൾ രൂപകൽപ്പന ചെയ്യുന്നു, അതിനാൽ അവ ഒരു നിർദ്ദിഷ്ട എൽഎൽഎമ്മിനെ ആശ്രയിക്കുന്നില്ല – എൽഎൽഎമ്മുകളെ പ്ലഗ് ആൻഡ് പ്ലേ ആയി കണക്കാക്കാം, അതുവഴി ബിസിനസുകൾക്ക് അവരുടെ ബിസിനസ്സ് ആവശ്യങ്ങളെ ആശ്രയിച്ച് വ്യത്യസ്ത മൂന്നാം കക്ഷി വെണ്ടർമാർക്കിടയിൽ മാറാനോ സ്വന്തമായി ആഭ്യന്തരമായി വികസിപ്പിച്ച എൽഎൽഎമ്മുകൾ ഉപയോഗിക്കാനോ കഴിയും.

തൽഫലമായി, ബിസിനസ്സ് പ്രക്രിയകളിലേക്ക് എൽഎൽഎമ്മുകളുടെ സംയോജനം ഗൗരവമായി പരിഗണിക്കുന്ന ഏതൊരാളും പെരുമാറ്റ പാറ്റേണുകൾ – പ്രത്യേകിച്ച് കൃത്യതയും പരാജയ മോഡുകളുടെ സന്ദർഭങ്ങളും – ക്രമാനുഗതമായി തരംതിരിക്കുന്നതിനുള്ള ഒരു പദ്ധതി വികസിപ്പിക്കണം, അതുവഴി ഏത് എൽഎൽഎം ഉപയോഗിക്കണമെന്നും മറ്റൊരു എൽഎൽഎമ്മിലേക്ക് മാറണോ എന്നതിനെക്കുറിച്ചും അവർക്ക് അറിവുള്ള തീരുമാനം എടുക്കാൻ കഴിയും.

എൽഎൽഎമ്മുകളുടെ സവിശേഷതയും മൂല്യനിർണ്ണയവും

ഒരു എൽഎൽഎമ്മിൽ അടിസ്ഥാനമാക്കിയുള്ള ഒരു ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസ് സൊല്യൂഷന്റെ പെരുമാറ്റ പാറ്റേണുകൾ വിവരിക്കുന്നതിനുള്ള ഒരു സമീപനം ഒരു എൽഎൽഎമ്മിന്റെ ഔട്ട്പുട്ടുകൾ വിശകലനം ചെയ്യാൻ മറ്റ് തരത്തിലുള്ള ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസ് ഉപയോഗിക്കുക എന്നതാണ്. ഇന്റലിജന്റ് എക്സ്പ്ലോറേഷൻ എന്നത് ഡാറ്റാ പര്യവേക്ഷണത്തിനുള്ള ഒരു രീതിശാസ്ത്രമാണ്, ഇത് ഉൾക്കാഴ്ച കണ്ടെത്തുന്നതിനും അത് വ്യക്തമായി ചിത്രീകരിക്കുന്നതിനുമായി ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസ് ദിനചര്യകളും മൾട്ടിഡൈമൻഷണൽ വിഷ്വലൈസേഷനുകളും കർശനമായി ഉപയോഗിക്കുന്നതിൽ അധിഷ്ഠിതമാണ്. എൽഎൽഎമ്മിന്റെ നിരവധി പരാജയ മോഡുകൾ ലഘൂകരിക്കാൻ ഇന്റലിജന്റ് എക്സ്പ്ലോറേഷൻ സഹായിക്കുന്ന ചില മാർഗ്ഗങ്ങൾ പരിഗണിക്കാം.

ഉദാഹരണത്തിന്, മറ്റൊരു നഗരത്തിൽ യാത്ര ചെയ്യുന്നതിനെക്കുറിച്ച് ഒരു എൽഎൽഎമ്മിനോട് ചില ചോദ്യങ്ങൾ ചോദിക്കാൻ ക്ലയന്റുകളെ അനുവദിക്കുന്ന ഒരു വെബ് ആപ്ലിക്കേഷൻ നിർമ്മിക്കാൻ ഞങ്ങൾ ആഗ്രഹിക്കുന്നുവെന്ന് കരുതുക, തീർച്ചയായും, ഞങ്ങളുടെ ക്ലയന്റുകൾ എൽഎൽഎമ്മിനുള്ളിൽ മതിഭ്രമം കാരണം നിലവിലില്ലാത്ത മ്യൂസിയങ്ങളോ മറ്റ് താൽപ്പര്യ പോയിന്റുകളോ സന്ദർശിക്കാൻ എൽഎൽഎം ശുപാർശ ചെയ്യാൻ ഞങ്ങൾ ആഗ്രഹിക്കുന്നില്ല (ഉദാഹരണത്തിന്, ചോദ്യം ഒരു സാങ്കൽപ്പിക നഗരവുമായി ബന്ധപ്പെട്ടതാണെങ്കിൽ). ഉത്തരവാദിത്തത്തോടെ ആപ്ലിക്കേഷൻ വികസിപ്പിക്കുമ്പോൾ, ചോദ്യത്തിലെ പ്രത്യേക വാക്കുകളുടെ സാന്നിധ്യം എൽഎൽഎം മിഥ്യാധാരണയുടെ സാധ്യത വർദ്ധിപ്പിക്കുമോ എന്ന് തരംതിരിക്കാൻ ഞങ്ങൾ തീരുമാനിച്ചേക്കാം (നഗരം നിലവിലില്ലെന്ന് ഉപയോക്താവിന് മുന്നറിയിപ്പ് നൽകുന്നതിനുപകരം). ഇന്റലിജന്റ് എക്സ്പ്ലോറേഷനാൽ നയിക്കപ്പെടുന്ന ഒരു സമീപനം ഇനിപ്പറയുന്നവയാകാം:

ചോദ്യങ്ങളുടെ ഒരു ടെസ്റ്റ് സെറ്റ് വികസിപ്പിക്കുക, അവയിൽ ചിലത് സാങ്കൽപ്പിക നഗരങ്ങൾ ഉൾപ്പെടുന്നു, അവയിൽ ചിലത് യഥാർത്ഥ നഗരങ്ങൾ ഉൾപ്പെടുന്നു;

എൽഎൽഎമ്മിന് നൽകിയ പ്രോംപ്റ്റിൽ പ്രത്യക്ഷപ്പെടുന്ന വാക്കുകൾ കണക്കിലെടുത്ത് ഒരു എൽഎൽഎം അതിന്റെ പ്രതികരണത്തിൽ മതിമറക്കുമോ എന്ന് പ്രവചിക്കാൻ മേൽനോട്ടത്തിലുള്ള ഒരു പഠന മോഡൽ (ഉദാഹരണത്തിന് റാൻഡം ഫോറസ്റ്റ് മോഡൽ) പരിശീലിപ്പിക്കുക;

ഏറ്റവും പ്രവചന ശക്തിയുള്ള മൂന്ന് വാക്കുകൾ തിരിച്ചറിയുക (പരിശീലനം ലഭിച്ച മോഡൽ അനുസരിച്ച്);

ഒരു മൾട്ടി-ഡയമെൻഷണൽ പ്ലോട്ട് സൃഷ്ടിക്കുക, അതിൽ ഒരു ഡാറ്റാ പോയിന്റിന്റെ X, Y, Z അളവുകൾ ഏറ്റവും പ്രവചന ശക്തിയുള്ള മൂന്ന് വാക്കുകളുടെ എണ്ണവുമായി (ചോദ്യത്തിനുള്ളിൽ) പൊരുത്തപ്പെടുന്നു, കൂടാതെ ഓരോ പോയിന്റിന്റെയും നിറം ആ ചോദ്യം എൽഎൽഎമ്മിനെ തെറ്റിദ്ധരിപ്പിക്കാൻ പ്രേരിപ്പിച്ചോ എന്ന് നിർണ്ണയിക്കുന്നു.

അത്തരമൊരു ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസ് അധിഷ്ഠിത വിഷ്വലൈസേഷൻ എൽഎൽഎമ്മിനെ ഭ്രമിപ്പിക്കാൻ പ്രേരിപ്പിക്കുന്ന വാക്കുകളുടെ നിർദ്ദിഷ്ട സംയോജനങ്ങൾ വേഗത്തിൽ തിരിച്ചറിയാൻ സഹായിക്കും.

മറ്റൊരു ഉദാഹരണം എടുക്കാൻ, ഒരു ലോൺ അപേക്ഷകനെ സംഗ്രഹിക്കുന്ന ഒരു ഡോക്യുമെന്റിനെ അടിസ്ഥാനമാക്കി ഒരു ഹോം ലോൺ എപ്പോൾ അംഗീകരിക്കണമെന്ന് തീരുമാനിക്കാൻ ഞങ്ങൾ ഒരു എൽഎൽഎം ഉപയോഗിക്കാൻ ആഗ്രഹിക്കുന്നുവെന്ന് കരുതുക, കൂടാതെ വായ്പ അനുവദിക്കാൻ നിർദ്ദേശിക്കുന്ന വായ്പകളിൽ എൽഎൽഎം അനുചിതമായ പക്ഷപാതം കാണിക്കുമെന്ന് ഞങ്ങൾക്ക് ആശങ്കയുണ്ട്. ഇനിപ്പറയുന്ന പ്രക്രിയയിലൂടെ ഈ സാധ്യമായ പക്ഷപാതം അന്വേഷിക്കാൻ ഞങ്ങൾക്ക് ഇന്റലിജന്റ് എക്സ്പ്ലോറേഷൻ ഉപയോഗിക്കാം:

ഒരു നെറ്റ് വർക്ക് ഗ്രാഫ് സൃഷ്ടിക്കുക, അതിൽ ഗ്രാഫിലെ ഓരോ നോഡും ഒരു ലോൺ ആപ്ലിക്കേഷൻ ഡോക്യുമെന്റാണ്, രണ്ട് ഡോക്യുമെന്റുകൾ തമ്മിലുള്ള ബന്ധത്തിന്റെ ശക്തി ആ രണ്ട് ഡോക്യുമെന്റുകളുമായി ബന്ധപ്പെട്ടിരിക്കുന്ന അളവിനെ അടിസ്ഥാനമാക്കിയുള്ളതാണ് (ഉദാ. രണ്ട് പ്രമാണങ്ങളിലും ഒരുമിച്ച് സംഭവിക്കുന്ന വാക്കുകളുടെയോ വാചകങ്ങളുടെയോ എണ്ണം).

നെറ്റ് വർക്കിനെ സംയോജിത കമ്മ്യൂണിറ്റികളായി വിഭജിക്കുന്നതിന് ഒരു നെറ്റ് വർക്ക് കമ്മ്യൂണിറ്റി ഡിറ്റക്ഷൻ രീതി (ഉദാ. ലൂവൈൻ രീതി) പ്രവർത്തിപ്പിക്കുക

നിരസിക്കപ്പെട്ട വായ്പാ അപേക്ഷകളുടെ അനുപാതം ഏതൊക്കെ കമ്മ്യൂണിറ്റികളിലാണെന്ന് തിരിച്ചറിയാൻ ഒരു സ്റ്റാറ്റിസ്റ്റിക്കൽ ടെസ്റ്റ് നടത്തുക, അത് മൊത്തത്തിൽ ജനസംഖ്യയിൽ നിന്ന് ഗണ്യമായി വ്യത്യസ്തമാണ്

നിയമവിരുദ്ധമായ കാരണങ്ങളാൽ എൽഎൽഎം ആ കമ്മ്യൂണിറ്റിയിലെ അപേക്ഷകരെ നിരസിക്കുന്നുണ്ടോ എന്ന് തിരിച്ചറിയാൻ ഫ്ലാഗ് ചെയ്ത കമ്മ്യൂണിറ്റിയിലെ രേഖകളുടെ ഒരു ഉപവിഭാഗം വായിക്കുക. അല്ലെങ്കിൽ പകരമായി, വായ്പ അപേക്ഷാ ഡോക്യുമെന്റുകൾ മറ്റ് സവിശേഷതകൾ ഉപയോഗിച്ച് വർദ്ധിപ്പിച്ചിട്ടുണ്ടെങ്കിൽ – ഉദാഹരണത്തിന് വരുമാനം, പിൻ കോഡ്, വംശീയത, വംശം അല്ലെങ്കിൽ ലിംഗഭേദം – ഫ്ലാഗ് ചെയ്ത കമ്മ്യൂണിറ്റി ഒരു പ്രത്യേക സവിശേഷത മൂല്യവുമായി ആനുപാതികമായി ബന്ധപ്പെട്ടിട്ടുണ്ടോ എന്ന് തിരിച്ചറിയാൻ നിങ്ങൾക്ക് കൂടുതൽ സ്റ്റാറ്റിസ്റ്റിക്കൽ ടെസ്റ്റുകൾ ഉപയോഗിക്കാം.

പ്രത്യേകിച്ചും, നെറ്റ് വർക്ക് ഗ്രാഫും അതിന്റെ കമ്മ്യൂണിറ്റികളും ദൃശ്യവൽക്കരിക്കുന്നത് ഏതൊക്കെ കമ്മ്യൂണിറ്റികൾ പരസ്പരം അടുത്ത ബന്ധമുണ്ടെന്ന് കാണിച്ചുകൊണ്ട് ഈ വിശകലനത്തെ അടിസ്ഥാനമാക്കാൻ സഹായിക്കും, ഇത് കൂടുതൽ വിശകലനം നടത്താൻ സഹായിക്കും.

പരമ്പരാഗത ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസ് ദിനചര്യകൾ (ഉദാ. റാൻഡം ഫോറസ്റ്റ് അല്ലെങ്കിൽ ലൂവൈൻ രീതി), മൾട്ടി-ഡയമെൻഷണൽ വിഷ്വലൈസേഷൻ കഴിവുകളുമായി സംയോജിപ്പിക്കുമ്പോൾ, ഒരു എൽഎൽഎമ്മിന്റെ പെരുമാറ്റ രീതികളും പക്ഷപാതങ്ങളും തിരിച്ചറിയാനും അന്വേഷിക്കാനും എങ്ങനെ സഹായിക്കുമെന്ന് ഈ രണ്ട് ഉദാഹരണങ്ങളും വിശദീകരിക്കുന്നു. മാത്രമല്ല, ഒരു മൂന്നാം കക്ഷി എൽഎൽഎമ്മിന്റെ പെരുമാറ്റവും പക്ഷപാതവും കാലക്രമേണ എങ്ങനെ മാറുന്നുവെന്ന് മനസിലാക്കുന്നതിനോ അല്ലെങ്കിൽ നിങ്ങൾ ഇപ്പോൾ ഉപയോഗിക്കുന്ന എൽഎൽഎമ്മുമായി താരതമ്യപ്പെടുത്തുമ്പോൾ നിരക്കുകളിലേക്ക് മാറാൻ നിങ്ങൾ പരിഗണിക്കുന്ന മറ്റൊരു എൽഎൽഎമ്മിനെ താരതമ്യം ചെയ്യുന്നതിനോ ഈ പ്രക്രിയകൾ ഇടയ്ക്കിടെ പ്രവർത്തിപ്പിക്കാൻ കഴിയും.

ശരിയായി ഉപയോഗിക്കുമ്പോൾ എൽഎൽഎമ്മുകൾക്ക് കാര്യമായ നേട്ടങ്ങൾ കൊണ്ടുവരാൻ കഴിയും, പക്ഷേ അവ വലിയ അളവിൽ അപകടസാധ്യത ക്ഷണിച്ചു വരുത്തും. ഇന്റലിജന്റ് എക്സ്പ്ലോറേഷന്റെ അടിസ്ഥാനത്തിലുള്ള വിശകലന ദിനചര്യകളുടെ ഒരു കൂട്ടം വികസിപ്പിക്കുകയും പരിപാലിക്കുകയും ചെയ്യുന്നത് പോലുള്ള മാർഗങ്ങൾ കണ്ടെത്തേണ്ടത് ഓർഗനൈസേഷനുകളാണ്, ഇത് ഉത്തരവാദിത്തമുള്ളതും അറിവുള്ളതും ധാർമ്മികവുമായ രീതിയിൽ ബിസിനസ്സ് പ്രശ്നങ്ങൾ പരിഹരിക്കുന്നതിന് എൽഎൽഎമ്മുകളെ ആത്മവിശ്വാസത്തോടെ പ്രയോജനപ്പെടുത്താൻ അനുവദിക്കുന്നു.

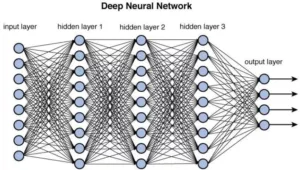

രചയിതാവിനെക്കുറിച്ച്: ഡോ. സാഗർ ഇന്ദുർഖ്യ വെർച്വലിറ്റിക്സ്, ഇൻകോർപ്പറേഷനിലെ എൻഎൽപി ഗ്രൂപ്പിന്റെ തലവനാണ്. നാച്ചുറൽ ലാംഗ്വേജ് പ്രോസസ്സിംഗ് (എൻഎൽപി), കമ്പ്യൂട്ടേഷണൽ ഭാഷാശാസ്ത്ര മേഖലയിലെ മികച്ച ജേണലുകളിലും കോൺഫറൻസുകളിലും പ്രസിദ്ധീകരണങ്ങൾ എന്നിവയുമായി എട്ട് വർഷത്തിലേറെ പരിചയമുണ്ട്. അദ്ദേഹത്തിന്റെ ഗവേഷണ പ്രവർത്തനങ്ങൾ ഉയർന്ന കൃത്യതയുള്ള സെമാന്റിക് പാർസിംഗ്, ഭാഷാ സിദ്ധാന്തത്തെ അടിസ്ഥാനമാക്കിയുള്ള ഭാഷാ ഏറ്റെടുക്കലിന്റെ കമ്പ്യൂട്ടേഷണൽ മോഡലുകളുടെ വികസനം, ഡീപ് ന്യൂറൽ നെറ്റ്വർക്ക് അധിഷ്ഠിത എൻഎൽപി സിസ്റ്റങ്ങളുടെ ബ്ലാക്ക്-ബോക്സ് വിശകലനം എന്നിവയിൽ ശ്രദ്ധ കേന്ദ്രീകരിച്ചു. മസാച്ചുസെറ്റ്സ് ഇൻസ്റ്റിറ്റ്യൂട്ട് ഓഫ് ടെക്നോളജിയിൽ (എംഐടി) നിന്ന് കംപ്യൂട്ടർ സയൻസിൽ പിഎച്ച്ഡി, എംഐടിയിൽ നിന്ന് ഇലക്ട്രിക്കൽ എഞ്ചിനീയറിംഗ് , കമ്പ്യൂട്ടർ സയൻസ് എന്നിവയിൽ ബിരുദാനന്തര ബിരുദം, എംഐടിയിൽ നിന്ന് കമ്പ്യൂട്ടർ സയൻസ്, എഞ്ചിനീയറിംഗ് എന്നിവയിൽ ബിരുദാനന്തര ബിരുദം.

Experienced Researcher with a demonstrated history of working in the Deep Learning, Computer Vision