ശ്രദ്ധാ (Attention) സംവിധാനത്തിന്റെ സെലക്ടീവ് ഫോക്കസ് എഐയിലെ മുന്നേറ്റങ്ങൾക്ക് എങ്ങനെ ഇന്ധനം നൽകുന്നു

യന്ത്രങ്ങൾ മനുഷ്യ ഭാഷയും ഇന്ദ്രിയ ഡാറ്റയും മനസ്സിലാക്കാനും സൃഷ്ടിക്കാനും ഇടപഴകാനും കൂടുതലായി പ്രതീക്ഷിക്കുന്ന ഒരു കാലഘട്ടത്തിൽ, “ശ്രദ്ധ” (attention) എന്ന ആശയം ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസ് മേഖലയിലെ ഒരു വഴികാട്ടിയായി ഉയർന്നുവന്നു. വളരെയധികം വിവരങ്ങൾ പ്രോസസ്സ് ചെയ്യുമ്പോൾ ഏറ്റവും പ്രസക്തമായ വിശദാംശങ്ങളിൽ ശ്രദ്ധ കേന്ദ്രീകരിക്കാനുള്ള ഒരു മോഡലിന്റെ കഴിവ് സങ്കൽപ്പിക്കുക- മനുഷ്യന്റെ അറിവിനെ നിർവചിക്കുന്ന തിരഞ്ഞെടുത്ത അവബോധത്തെ പ്രതിഫലിപ്പിക്കുന്ന ഒരു കഴിവ്. ശ്രദ്ധാ മോഡലുകളുടെ ലോകത്തേക്ക് സ്വാഗതം, മെഷീൻ ലേണിംഗ് മേഖലയിലെ ഒരു സുപ്രധാന മുന്നേറ്റം, ഇത് സ്വാഭാവിക ഭാഷാ ധാരണ, ഇമേജ് വിശകലനം തുടങ്ങിയ ജോലികളെ ഞങ്ങൾ എങ്ങനെ സമീപിക്കുന്നുവെന്ന് ഗണ്യമായി മാറ്റുന്നു.

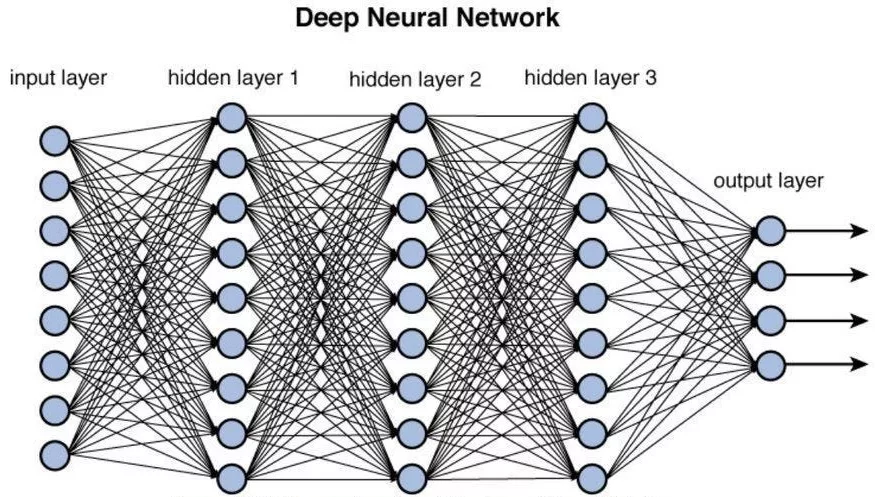

2017-ൽ പ്രസിദ്ധീകരിച്ച “ശ്രദ്ധാ ശൃംഖലകൾ” സാങ്കേതിക മേഖലയിലെ ഒരു ചർച്ചാവിഷയമാണ്, പ്രധാനമായും നാച്ചുറൽ ലാംഗ്വേജ് പ്രോസസ്സിംഗ് (എൻഎൽപി), കമ്പ്യൂട്ടർ വിഷൻ എന്നിവയിൽ വിവിധ ഡൊമെയ്നുകളിലുടനീളം വിപുലമായ പ്രയോഗം കണ്ടെത്തി. രണ്ട് ദശാബ്ദങ്ങൾക്ക് മുമ്പ് തികച്ചും സൈദ്ധാന്തികമായിരുന്ന ഡീപ് ലേണിംഗ് (ഡിഎൽ) എന്ന ആശയം ഇപ്പോൾ സംസാരത്തെ ടെക്സ്റ്റ് ട്രാൻസ്ക്രിപ്റ്റുകളാക്കി മാറ്റുക, സങ്കീർണ്ണമായ ഇമേജ് തിരിച്ചറിയൽ ജോലികൾ ചെയ്യുക, കമ്പ്യൂട്ടർ വിഷൻ, നാച്ചുറൽ ലാംഗ്വേജ് പ്രോസസ്സിംഗ് തുടങ്ങിയ മേഖലകളെ പരിവർത്തനം ചെയ്യുക തുടങ്ങിയ വ്യക്തമായ പ്രശ്നങ്ങൾ പരിഹരിക്കാൻ ഉപയോഗിക്കുന്നു. ഈ ആപ്ലിക്കേഷനുകൾക്ക് പിന്നിലെ പ്രധാന പ്രാപ്തി ശ്രദ്ധാ സംവിധാനം അല്ലെങ്കിൽ ശ്രദ്ധാ മോഡൽ എന്നറിയപ്പെടുന്ന ഒരു ആശയമാണ്.

ആഴത്തിൽ പരിശോധിക്കാൻ, ‘ശ്രദ്ധ’ എന്താണ് സൂചിപ്പിക്കുന്നതെന്നും ഡിഎല്ലിന്റെ സന്ദർഭത്തിൽ അത് എങ്ങനെ പ്രവർത്തിക്കുന്നുവെന്നും നമ്മൾ ആദ്യം മനസ്സിലാക്കണം. എൻകോഡർ, ഡീകോഡർ തുടങ്ങിയ അനുബന്ധ പദങ്ങളും ഞങ്ങൾ പര്യവേക്ഷണം ചെയ്യും. ഈ ലേഖനം ശ്രദ്ധാ സംവിധാനത്തിന്റെയും അനുബന്ധ ആശയങ്ങളുടെയും സമഗ്രമായ അവലോകനം വാഗ്ദാനം ചെയ്യുന്നു, കൂടാതെ യഥാർത്ഥ ലോക സാഹചര്യങ്ങളിൽ ഈ സാങ്കേതികവിദ്യകൾ എങ്ങനെ നടപ്പാക്കുന്നുവെന്നതിനെക്കുറിച്ച് വ്യക്തമായ ധാരണ നൽകുന്നു.

ആഴത്തിലുള്ള പഠനത്തിൽ ശ്രദ്ധാ സംവിധാനത്തിന്റെ ആമുഖം

ആഴത്തിലുള്ള പഠനത്തിൽ ശ്രദ്ധാ സംവിധാനം ഒരു പ്രധാന ആശയമായി ഉയർന്നുവന്നു. ഈ സംവിധാനം നിലവിൽ ഇമേജ് ക്യാപ്ഷനിംഗ് പോലുള്ള വൈവിധ്യമാർന്ന ജോലികളിൽ പ്രയോഗിക്കുന്നുണ്ടെങ്കിലും, അതിന്റെ യഥാർത്ഥ രൂപകൽപ്പന സീക്വൻസ്-ടു-സീക്വൻസ് മോഡലുകൾ ഉപയോഗിച്ച് ന്യൂറൽ മെഷീൻ വിവർത്തനത്തിൽ പ്രയോഗിക്കാൻ ഉദ്ദേശിച്ചുള്ളതാണ്.

Seq2seq മോഡൽ എങ്ങനെ പ്രവർത്തിക്കുന്നു?

വേരിയബിൾ-ലെങ്ത് ഇൻപുട്ട് സീക്വൻസുള്ള ഒരു സീക്വൻസ് മോഡലിംഗ് ടാസ്ക് പരിഗണിക്കുക; വേരിയബിൾ-ലെങ്ത് ഔട്ട്പുട്ട് സീക്വൻസ് പ്രവചിക്കുക എന്നതാണ് ലക്ഷ്യം. “ഐ ലവ് യു” (ഇംഗ്ലീഷ്) മുതൽ “ടെ അമോ” (സ്പാനിഷ്) വരെ വിവർത്തനം ചെയ്യുന്നത് പോലുള്ള യന്ത്ര വിവർത്തനമാണ് ഈ ദൗത്യത്തിന്റെ പ്രചാരത്തിലുള്ള ഉദാഹരണം.

ഇൻപുട്ട് സീക്വൻസിന്റെ ദൈർഘ്യം (3 വാക്കുകൾ) ഔട്ട്പുട്ട് സീക്വൻസിന്റെ (2 വാക്കുകൾ) ദൈർഘ്യവുമായി പൊരുത്തപ്പെടുന്നില്ലെന്ന് ഒരാൾക്ക് നിരീക്ഷിക്കാൻ കഴിയും. 1: 1 മാപ്പിംഗിന്റെ അഭാവം കാരണം ഓരോ ഇൻപുട്ട് ടോക്കണും അനുബന്ധ ഔട്ട്പുട്ട് ടോക്കണിലേക്ക് മാപ്പ് ചെയ്യാൻ ഒരു മോഡലിനെ പരിശീലിപ്പിക്കുന്നത് അസാധ്യമായതിനാൽ ഈ പൊരുത്തക്കേട് സീക്വൻസ് പ്രവചനത്തെ ഒരു സങ്കീർണ്ണ ജോലിയാക്കുന്നു.

ചോയും മറ്റുള്ളവരും അവതരിപ്പിച്ച ആർഎൻഎൻ എൻകോഡർ-ഡീകോഡർ ന്യൂറൽ നെറ്റ്വർക്ക് ആർക്കിടെക്ചർ ഇത്തരത്തിലുള്ള സീക്വൻസ് മോഡലിംഗിനെ നേരിടാൻ രൂപകൽപ്പന ചെയ്തു. വേരിയബിൾ-ലെങ്ത് ഇൻപുട്ട് ഒരു നിശ്ചിത വലുപ്പമുള്ള വെക്റ്ററിലേക്ക് എൻകോഡ് ചെയ്യാൻ ഇത് ഒരു ആവർത്തിച്ചുള്ള ന്യൂറൽ നെറ്റ് വർക്ക് ഉപയോഗിക്കുന്നു. രണ്ടാമത്തെ ആവർത്തന ന്യൂറൽ നെറ്റ് വർക്ക് ഈ നിശ്ചിത വലുപ്പമുള്ള വെക്റ്ററിനെ വേരിയബിൾ-ലെങ്ത് ഔട്ട്പുട്ട് സീക്വൻസിലേക്ക് ഡീകോഡ് ചെയ്യുന്നു.

ഈ സമീപനത്തെ അടിസ്ഥാനമാക്കി, വേരിയബിൾ-ലെങ്ത് സീക്വൻസുകൾ എൻകോഡുചെയ്യുന്നതിനും ഡീകോഡ് ചെയ്യുന്നതിനും എൽഎസ്ടിഎം നെറ്റ് വർക്കുകൾ ഉപയോഗിക്കുന്ന സമാനമായ ഒരു ആർക്കിടെക്ചർ സറ്റ്സ്കെവറും മറ്റുള്ളവരും അവതരിപ്പിച്ചു. എന്നിരുന്നാലും, ഈ ഘടനയിൽ, ഡീകോഡിംഗ് സമയത്ത് ഓരോ ഘട്ടത്തിനും സന്ദർഭമായി നൽകുന്നതിനുപകരം എൻകോഡറിന്റെ അന്തിമ മറഞ്ഞിരിക്കുന്ന അവസ്ഥ മാത്രമാണ് ഡീകോഡറിനെ പ്രാരംഭമാക്കാൻ ഉപയോഗിക്കുന്നത്. രസകരമെന്നു പറയട്ടെ, ഒപ്റ്റിമൈസേഷൻ പ്രശ്നം ലളിതമാക്കുന്നതിന് ഇൻപുട്ട് സീക്വൻസ് റിവേഴ്സ് ചെയ്യുന്നു.

രണ്ട് ആർക്കിടെക്ചറുകളിലും ചെറിയ വ്യത്യാസങ്ങൾ ഉണ്ടായിരുന്നിട്ടും, പൊതുവായ സമീപനം അതേപടി തുടരുന്നു: വേരിയബിൾ-ലെങ്ത് ഇൻപുട്ട് സീക്വൻസ് ഒരു നിശ്ചിത വലുപ്പത്തിലുള്ള വെക്ടറിലേക്ക് എൻകോഡുചെയ്യുന്നു, ഇത് മുഴുവൻ ഇൻപുട്ടിന്റെയും സംഗ്രഹം ഉൾക്കൊള്ളുന്നു. ഔട്ട്പുട്ട് സീക്വൻസ് സൃഷ്ടിക്കുമ്പോൾ ഈ സംഗ്രഹം ഡീകോഡറിന്റെ സന്ദർഭമായി വർത്തിക്കുന്നു.

സന്ദർഭ വെക്റ്ററിന്റെ പരിമിതികൾ

മെഷീൻ വിവർത്തനം അല്ലെങ്കിൽ ടെക്സ്റ്റ് സംഗ്രഹം പോലുള്ള സീക്വൻസ്-ടു-സീക്വൻസ് ജോലികളുടെ ഫ്ലെക്സിബിൾ പഠനത്തിന് നിശ്ചിത വലുപ്പത്തിലുള്ള സന്ദർഭ വെക്റ്റർ വഴിയൊരുക്കുമ്പോൾ, ഈ വാസ്തുവിദ്യാ തിരഞ്ഞെടുപ്പിന്റെ പ്രത്യാഘാതങ്ങൾ പരിഗണിക്കേണ്ടത് നിർണായകമാണ്.

ഇൻപുട്ട് സീക്വൻസിന്റെ സംഗ്രഹമായി പരിമിതമായ അളവിൽ വിവരങ്ങൾ സംഭരിക്കാൻ കഴിയുമെന്ന് വെക്റ്ററിന്റെ നിശ്ചിത വലുപ്പ സ്വഭാവം സൂചിപ്പിക്കുന്നു. ഉദാഹരണത്തിന്, നമ്മുടെ സന്ദർഭ വെക്റ്ററിന് 100 ബിറ്റ് വിവരങ്ങൾ നിലനിർത്താൻ കഴിയുമെന്നും ഓരോ ഇൻപുട്ട് സീക്വൻസ് ടോക്കണും ഈ വിവരത്തിന് തുല്യമായി സംഭാവന ചെയ്യുന്നുവെന്നും ഞങ്ങൾ അനുമാനിക്കുന്നുവെങ്കിൽ, 5 ടോക്കണുകളുടെ ഇൻപുട്ട് സീക്വൻസിനായി, ഓരോ ടോക്കണും സന്ദർഭ വെക്റ്ററിലേക്ക് 20 ബിറ്റ് വിവരങ്ങൾ സംഭാവന ചെയ്യും. എന്നിരുന്നാലും, 10 ടോക്കണുകളുടെ ഇൻപുട്ട് സീക്വൻസിനായി, ഓരോ ടോക്കണും സന്ദർഭ വെക്റ്ററിന് 10 ബിറ്റ് വിവരങ്ങൾ മാത്രമേ നൽകൂ.

സീക്വൻസ്-ടു-സീക്വൻസ് മോഡലുകളുടെ പ്രകടനം കൂടുതൽ ഇൻപുട്ട് സീക്വൻസുകളിലേക്ക് എങ്ങനെ കുറയുമെന്ന് ഈ ഉദാഹരണം കാണിക്കുന്നു. ഇൻപുട്ടിന്റെ വലുപ്പം വർദ്ധിക്കുന്നതിനനുസരിച്ച്, ഇൻപുട്ട് സീക്വൻസിൽ ഒരു ടോക്കണിന് സംഭരിക്കാൻ കഴിയുന്ന വിവരങ്ങൾ ക്രമേണ കുറയുന്നു.

ശ്രദ്ധാ സംവിധാനം അവതരിപ്പിക്കുന്നു: പരിഹാരം

‘സന്ദർഭ തടസ്സത്തിന്റെ’ പ്രശ്നം പരിഹരിക്കുന്നതിന്, ബഹ്ദാനൗവും മറ്റുള്ളവരും ഒരു ന്യൂറൽ നെറ്റ് വർക്ക് ആർക്കിടെക്ചർ അവതരിപ്പിച്ചു, ഇത് ഡീകോഡറിലെ ഓരോ ഘട്ടത്തിനും ഒരു പ്രത്യേക സന്ദർഭ വെക്റ്ററിന്റെ നിർമ്മാണം സുഗമമാക്കുന്നു. എൻകോഡറിലെ മറഞ്ഞിരിക്കുന്ന എല്ലാ അവസ്ഥകളിലുടനീളം വ്യത്യസ്ത ഭാരമുള്ള അഗ്രഗേഷനുകളെ അടിസ്ഥാനമാക്കിയാണ് ഇത് കൈവരിക്കുന്നത്.

മുമ്പത്തെ ഉദാഹരണത്തിൽ, മുഴുവൻ ഇൻപുട്ട് സീക്വൻസും സംഗ്രഹിക്കാൻ ഞങ്ങൾക്ക് 100 ബിറ്റ് വിവരങ്ങൾ മാത്രമേ ഉണ്ടായിരുന്നുള്ളൂ. എന്നിരുന്നാലും, ഈ പുതിയ രീതി ഉപയോഗിച്ച്, ഡീകോഡിംഗ് പ്രക്രിയയുടെ ഓരോ ഘട്ടത്തിലും ഇൻപുട്ട് സീക്വൻസിനെക്കുറിച്ചുള്ള 100 ബിറ്റ് വിവരങ്ങൾ നൽകാൻ ഞങ്ങൾക്ക് കഴിയും

അന്തിമ മറഞ്ഞിരിക്കുന്ന അവസ്ഥയേക്കാൾ എൻകോഡറിന്റെ മറഞ്ഞിരിക്കുന്ന എല്ലാ അവസ്ഥകളുടെയും ഭാരമേറിയ സംയോജനം എടുത്തുകൊണ്ട് ശ്രദ്ധാ സംവിധാനം സന്ദർഭ വെക്റ്റർ സൃഷ്ടിക്കുന്നു. നിലവിലെ ഡീകോഡറിന്റെ മറഞ്ഞിരിക്കുന്ന അവസ്ഥ കണക്കിലെടുക്കുമ്പോൾ ശ്രദ്ധാ ഭാരങ്ങൾ എൻകോഡറിന്റെ മറഞ്ഞിരിക്കുന്ന അവസ്ഥകളുടെ പ്രസക്തി നിർണ്ണയിക്കുന്നു. വാക്കുകളുടെ സമാന്തര പ്രോസസ്സിംഗ് എന്ന ആശയത്തോടെ ആഴത്തിലുള്ള പഠന മേഖലയിൽ ഗണ്യമായ മാറ്റം കൊണ്ടുവന്ന വാസ്വാനിയും മറ്റുള്ളവരും നടത്തിയ “ശ്രദ്ധയാണ് നിങ്ങൾക്ക് വേണ്ടത്” എന്ന പരിവർത്തന പ്രബന്ധത്തിന് ഇത് അടിത്തറ നൽകി.

ഈ സമീപനത്തിന്റെ സാരാംശം, ഒരു ഔട്ട്പുട്ട് വാക്ക് പ്രവചിക്കുമ്പോൾ, മോഡൽ മുഴുവൻ സീക്വൻസും പരിഗണിക്കുന്നതിനുപകരം ഏറ്റവും പ്രസക്തമായ വിവരങ്ങൾ അടങ്ങിയിരിക്കുന്ന ഇൻപുട്ടിന്റെ വിഭാഗങ്ങളിൽ മാത്രം ശ്രദ്ധ കേന്ദ്രീകരിക്കുന്നു എന്നതാണ്. മറ്റൊരു വിധത്തിൽ പറഞ്ഞാൽ, ഇത് ചില ഇൻപുട്ട് വാക്കുകൾക്ക് ‘ശ്രദ്ധ നൽകുന്നു’.

എൻകോഡറിനെയും ഡീകോഡറിനെയും ബന്ധിപ്പിക്കുന്ന ഒരു ലിങ്കായി ശ്രദ്ധാ സംവിധാനം പ്രവർത്തിക്കുന്നു, ഇത് എൻകോഡറിന്റെ ഓരോ മറഞ്ഞിരിക്കുന്ന അവസ്ഥയിൽ നിന്നുമുള്ള ഡാറ്റ ഉപയോഗിച്ച് ഡീകോഡറിന് നൽകുന്നു. ഇൻപുട്ട് സീക്വൻസിന്റെ വിലയേറിയ ഭാഗങ്ങളിൽ ഈ തിരഞ്ഞെടുത്ത ഫോക്കസ് നീണ്ട ഇൻപുട്ട് വാചകങ്ങൾ കാര്യക്ഷമമായി കൈകാര്യം ചെയ്യാൻ മോഡലിനെ അനുവദിക്കുന്നു.

“ഐ ലവ് യു” സ്പാനിഷ് ഭാഷയിലേക്ക് വിവർത്തനം ചെയ്ത ഞങ്ങളുടെ ഉദാഹരണം ഓർക്കുക. “ഞാൻ നിങ്ങളെ സ്നേഹിക്കുന്നു”, “ടെ അമോ” എന്നിവയുടെ അനുബന്ധ ടോക്കണുകൾ ഞങ്ങൾ അടിസ്ഥാനപരമായി വിന്യസിക്കുന്നു. ബഹ്ദാനൗവും മറ്റുള്ളവരും ഈ ശ്രദ്ധാ സംവിധാനത്തെ ഒരു വിന്യാസ മാതൃകയായി പരാമർശിക്കുന്നു, ഇത് ഡീകോഡർ മോഡലിന്റെ താൽക്കാലിക സ്ഥാനത്തിൽ നിന്ന് സ്വതന്ത്രമായി ഇൻപുട്ട് സീക്വൻസിലുടനീളം ഏറ്റവും പ്രസക്തമായ സമയ ഘട്ടങ്ങൾ തിരയാൻ ഡീകോഡറിനെ അനുവദിക്കുന്നു.

രണ്ടാമത്തെ ടോക്കൺ ഡീകോഡ് ചെയ്യുമ്പോൾ, എൻകോഡറിന്റെ മറഞ്ഞിരിക്കുന്ന അവസ്ഥകളിൽ നിന്ന് സന്ദർഭങ്ങളുടെ വ്യത്യസ്ത ഭാരമുള്ള സംയോജനം ഞങ്ങൾക്ക് ലഭിക്കുന്നു, ഇത് “ഐ ലവ് യു” നെ “ടെ അമോ” യുമായി വിന്യസിക്കുന്നു. ഡീകോഡർ മോഡൽ ഔട്ട്പുട്ട് സീക്വൻസ് സൃഷ്ടിക്കുന്നത് തുടരുമ്പോൾ, ഒരു സവിശേഷ സന്ദർഭ വെക്റ്റർ നിർമ്മിക്കുന്നതിന് ഞങ്ങളുടെ എല്ലാ എൻകോഡർ മറഞ്ഞിരിക്കുന്ന അവസ്ഥകളുമായും നിലവിലെ ഡീകോഡർ മറഞ്ഞിരിക്കുന്ന അവസ്ഥ താരതമ്യം ചെയ്യുന്നത് തുടരും.

അതിനാൽ, നിർദ്ദിഷ്ട മോഡൽ ഒരു വാചകം നിർമ്മിക്കുമ്പോൾ, ഏറ്റവും പ്രസക്തമായ വിവരങ്ങൾ അടങ്ങിയിരിക്കുന്ന എൻകോഡറിന്റെ മറഞ്ഞിരിക്കുന്ന അവസ്ഥകളിലെ ചില സ്ഥാനങ്ങൾ ഇത് തിരിച്ചറിയുന്നു. പ്രസക്തമായ മേഖലകളിലെ ഈ തിരഞ്ഞെടുക്കപ്പെട്ട ശ്രദ്ധയെ ‘ശ്രദ്ധ’ എന്ന് വിളിക്കുന്നു.

ശ്രദ്ധാ സംവിധാനത്തിന്റെ തരങ്ങൾ

ശ്രദ്ധാ സംവിധാനത്തിന്റെ സങ്കീർണ്ണമായ പ്രവർത്തനങ്ങൾ പര്യവേക്ഷണം ചെയ്യുന്നതിന് മുമ്പ്, വ്യത്യസ്ത തരത്തിലുള്ള ശ്രദ്ധാ സംവിധാനം ഉണ്ടെന്ന് മനസിലാക്കേണ്ടത് നിർണായകമാണ്. ശ്രദ്ധാ സംവിധാനങ്ങൾ തമ്മിലുള്ള വ്യത്യാസം പ്രാഥമികമായി അവയുടെ നിർദ്ദിഷ്ട പ്രയോഗ മേഖലകളെയും മോഡൽ ശ്രദ്ധ കേന്ദ്രീകരിക്കുന്ന അല്ലെങ്കിൽ ‘ശ്രദ്ധ കേന്ദ്രീകരിക്കുന്ന’ ഇൻപുട്ട് സീക്വൻസിന്റെ ഭാഗങ്ങളെയും അടിസ്ഥാനമാക്കിയുള്ളതാണ്. ഈ ഫോമുകൾ ഇനിപ്പറയുന്നവയാണ്:

ബഹ്ദാനൗ ശ്രദ്ധ / അഡിറ്റീവ് ശ്രദ്ധ

അഡിറ്റീവ് ശ്രദ്ധ എന്ന് പലപ്പോഴും വിളിക്കപ്പെടുന്ന ആദ്യത്തെ തരം ശ്രദ്ധാ സംവിധാനം ഡിസ്മിത്രി ബഹ്ദാനൗവിന്റെ ഒരു പ്രബന്ധത്തിൽ നിന്ന് ഉയർന്നുവന്നു. പ്രസക്തമായ ഇൻപുട്ട് വാചകങ്ങളുമായി ഡീകോഡർ വിന്യസിക്കുകയും ശ്രദ്ധ സമന്വയിപ്പിക്കുകയും ചെയ്യുന്നതിലൂടെ മെഷീൻ വിവർത്തനത്തിലെ സീക്വൻസ്-ടു-സീക്വൻസ് മോഡൽ മെച്ചപ്പെടുത്തുക എന്നതായിരുന്നു പഠനത്തിന്റെ പ്രാഥമിക ലക്ഷ്യം. ബഹ്ദാനുവിന്റെ പ്രബന്ധത്തിൽ ചിത്രീകരിച്ചിരിക്കുന്നതുപോലെ ശ്രദ്ധ പ്രയോഗിക്കുന്നതിനുള്ള സമ്പൂർണ്ണ നടപടിക്രമം ചുവടെ വിവരിച്ചിരിക്കുന്നു:

തുടക്കത്തിൽ, എൻകോഡർ ഇൻപുട്ട് സീക്വൻസിലെ ഓരോ മൂലകത്തിനും മറഞ്ഞിരിക്കുന്ന അവസ്ഥകൾ സൃഷ്ടിക്കുന്നു. തുടർന്ന്, മുമ്പത്തെ ഡീകോഡറിന്റെ മറഞ്ഞിരിക്കുന്ന അവസ്ഥയും എൻകോഡറിന്റെ മറഞ്ഞിരിക്കുന്ന ഓരോ അവസ്ഥകളും തമ്മിൽ അലൈൻമെന്റ് സ്കോറുകൾ കണക്കാക്കുന്നു. അന്തിമ എൻകോഡറിന്റെ മറഞ്ഞിരിക്കുന്ന അവസ്ഥ ഡീകോഡറിലെ പ്രാരംഭ മറഞ്ഞിരിക്കുന്ന അവസ്ഥയായി ഉപയോഗിക്കാമെന്നത് ശ്രദ്ധിക്കേണ്ടതാണ്. അടുത്തതായി, ഓരോ എൻകോഡർ മറഞ്ഞിരിക്കുന്ന അവസ്ഥയുടെയും അലൈൻമെന്റ് സ്കോറുകൾ ഒരൊറ്റ വെക്റ്ററിലേക്ക് സംയോജിപ്പിക്കുന്നു, ഇത് ഒരു സോഫ്റ്റ്മാക്സ് പ്രവർത്തനത്തിന് വിധേയമാണ്. ഇത് അടിസ്ഥാനപരമായി അസംസ്കൃത വിന്യാസ സ്കോറുകളെ ഒന്നിലേക്ക് ചുരുക്കുന്ന സാധ്യതകളാക്കി മാറ്റുന്നു, ചില മറഞ്ഞിരിക്കുന്ന അവസ്ഥകൾക്ക് മറ്റുള്ളവയേക്കാൾ ഊന്നൽ നൽകുന്നു. എൻകോഡറിന്റെ അനുബന്ധ മറഞ്ഞിരിക്കുന്ന അവസ്ഥകളുമായി അലൈൻമെന്റ് സ്കോറുകൾ ഗുണിച്ചാണ് സന്ദർഭ വെക്റ്റർ രൂപം കൊള്ളുന്നത്. ഈ സന്ദർഭ വെക്റ്റർ അടിസ്ഥാനപരമായി എൻകോഡറിന്റെ മറഞ്ഞിരിക്കുന്ന അവസ്ഥകളുടെ ഭാരമുള്ള തുകയായി വർത്തിക്കുന്നു, അലൈൻമെന്റ് സ്കോറുകൾ നിർണ്ണയിക്കുന്ന ഭാരങ്ങൾ. സന്ദർഭ വെക്റ്റർ പിന്നീട് മുമ്പത്തെ ഡീകോഡിംഗ് ഘട്ടത്തിൽ നിന്നുള്ള ഔട്ട്പുട്ടുമായി സംയോജിപ്പിക്കുന്നു. ഒരു പുതിയ ഔട്ട്പുട്ട് സൃഷ്ടിക്കുന്നതിന് ഈ സംയോജിത വിവരങ്ങൾ ആ സമയത്ത് ഡീകോഡർ ആർഎൻഎന്നിലേക്ക് മുൻ ഡീകോഡർ മറഞ്ഞിരിക്കുന്ന അവസ്ഥയോടൊപ്പം നൽകുന്നു.

2 മുതൽ 5 വരെയുള്ള ഘട്ടങ്ങൾ ഉൾക്കൊള്ളുന്ന ഈ പ്രക്രിയ, ഒരു എൻഡ് ടോക്കൺ ഉത്പാദിപ്പിക്കപ്പെടുന്നതുവരെ അല്ലെങ്കിൽ ഔട്ട്പുട്ട് ഒരു നിർദ്ദിഷ്ട പരമാവധി ദൈർഘ്യം കവിയുന്നതുവരെ ഡീകോഡറിന്റെ ഓരോ തവണയും ആവർത്തിക്കുന്നു.

Luong ശ്രദ്ധ / ആഗോള ശ്രദ്ധ / ബഹുമുഖ ശ്രദ്ധ

മൾട്ടിപ്ലിക്കേറ്റീവ് ശ്രദ്ധ എന്ന് പതിവായി പരാമർശിക്കപ്പെടുന്ന രണ്ടാമത്തെ തരം ശ്രദ്ധ താങ് ലുവാങ് തന്റെ പ്രബന്ധത്തിൽ നിർദ്ദേശിച്ചു. ഈ സമീപനം ബഹ്ദാനൗ നിർദ്ദേശിച്ച ശ്രദ്ധാ സംവിധാനത്തെ അടിസ്ഥാനമാക്കിയുള്ളതാണ്. ലുവോങ് ശ്രദ്ധയും ബഹ്ദാനൗ ശ്രദ്ധയും തമ്മിലുള്ള പ്രാഥമിക വ്യത്യാസങ്ങൾ അലൈൻമെന്റ് സ്കോർ കണക്കാക്കുന്നതിലും ഡീകോഡറിലെ ശ്രദ്ധാ സംവിധാനത്തിന്റെ സംയോജന പോയിന്റിലുമാണ്.

ബഹ്ദാനൗവിന്റെ മാതൃകയിലെ സിംഗിൾ ടൈപ്പിന് വിപരീതമായി ലുവോങ്ങിന്റെ പ്രബന്ധം മൂന്ന് വ്യത്യസ്ത തരം അലൈൻമെന്റ് സ്കോറിംഗ് ഫംഗ്ഷനുകൾ നിർദ്ദേശിക്കുന്നു. കൂടാതെ, ശ്രദ്ധാ ഡീകോഡറിന്റെ പൊതുവായ ഘടന ലുവോംഗ് ശ്രദ്ധയിൽ വ്യത്യാസപ്പെടുന്നു, അവിടെ ആർഎൻഎൻ ആ നിർദ്ദിഷ്ട സമയ ഘട്ടത്തിനുള്ള ഔട്ട്പുട്ട് സൃഷ്ടിച്ചതിന് ശേഷം മാത്രമേ സന്ദർഭ വെക്റ്റർ ഉപയോഗിക്കൂ. ലുവോങ് ശ്രദ്ധാ പ്രക്രിയയുടെ ഒരു രൂപരേഖ ഇതാ:

തുടക്കത്തിൽ, എൻകോഡർ ഇൻപുട്ട് സീക്വൻസിലെ ഓരോ മൂലകത്തിനും മറഞ്ഞിരിക്കുന്ന അവസ്ഥകൾ സൃഷ്ടിക്കുന്നു. തുടർന്ന്, മുമ്പത്തെ ഡീകോഡറിന്റെ മറഞ്ഞിരിക്കുന്ന അവസ്ഥയും ഡീകോഡർ ഔട്ട്പുട്ടും ഡീകോഡർ ആർഎൻഎന്നിലൂടെ കടന്നുപോകുന്നു, ഇത് ആ സമയ ഘട്ടത്തിനായി ഒരു പുതിയ മറഞ്ഞിരിക്കുന്ന അവസ്ഥ സൃഷ്ടിക്കുന്നു. അടുത്തതായി, പുതുതായി സൃഷ്ടിച്ച ഡീകോഡർ, എൻകോഡർ മറഞ്ഞിരിക്കുന്ന അവസ്ഥകൾ ഉപയോഗിച്ച് അലൈൻമെന്റ് സ്കോറുകൾ കണക്കാക്കുന്നു. തുടർന്ന്, ഓരോ എൻകോഡർ മറഞ്ഞിരിക്കുന്ന അവസ്ഥയുടെയും അലൈൻമെന്റ് സ്കോറുകൾ ഒരൊറ്റ വെക്റ്ററിലേക്ക് സമാഹരിക്കുന്നു. തുടർന്ന്, ഒരു സോഫ്റ്റ്മാക്സ് ഫംഗ്ഷൻ പ്രയോഗിക്കുന്നു, ഈ അസംസ്കൃത വിന്യാസ സ്കോറുകൾ സാധ്യതാ മൂല്യങ്ങളാക്കി മാറ്റുന്നു. എൻകോഡർ മറഞ്ഞിരിക്കുന്ന അവസ്ഥകളെ അതത് അലൈൻമെന്റ് സ്കോറുകൾ ഉപയോഗിച്ച് ഗുണിച്ചാണ് സന്ദർഭ വെക്റ്റർ കണക്കാക്കുന്നത്. അവസാനമായി, സന്ദർഭ വെക്റ്റർ ഘട്ടം 2 ൽ സൃഷ്ടിക്കപ്പെടുന്ന ഡീകോഡർ മറഞ്ഞിരിക്കുന്ന അവസ്ഥയുമായി സംയോജിപ്പിക്കുകയും ഒരു പുതിയ ഔട്ട്പുട്ട് ഉത്പാദിപ്പിക്കാൻ പൂർണ്ണമായും കണക്റ്റുചെയ് ത പാളിയിലൂടെ കടന്നുപോകുകയും ചെയ്യുന്നു.

2 മുതൽ 6 വരെയുള്ള ഘട്ടങ്ങൾ ഉൾക്കൊള്ളുന്ന ഈ നടപടിക്രമം, ഒരു എൻഡ് ടോക്കൺ ഉത്പാദിപ്പിക്കപ്പെടുന്നതുവരെ അല്ലെങ്കിൽ ഔട്ട്പുട്ട് ഒരു നിശ്ചിത പരമാവധി ദൈർഘ്യത്തെ മറികടക്കുന്നതുവരെ ഡീകോഡറിന്റെ ഓരോ തവണയും ആവർത്തിക്കുന്നു.

ലുവോങ് ശ്രദ്ധയിലെ ഘട്ടങ്ങളുടെ ക്രമം ബഹ്ദാനൗ ശ്രദ്ധയിൽ നിന്ന് വ്യത്യസ്തമാണ്.

സ്വയം ശ്രദ്ധ

ഔട്ട്പുട്ട് സീക്വൻസ് രൂപീകരിക്കുമ്പോൾ ഇൻപുട്ട് സീക്വൻസിന്റെ എല്ലാ സ്ഥാനങ്ങളും തമ്മിലുള്ള ആശ്രിതത്വം തിരിച്ചറിയാനും ഉപയോഗിക്കാനും അനുവദിക്കുന്ന ഒരു മോഡലാണ് ഇൻട്രാ-അറ്റൻഷൻ എന്നും അറിയപ്പെടുന്ന സ്വയം ശ്രദ്ധാ സംവിധാനം. സീക്വൻസുകൾ കൈകാര്യം ചെയ്യുമ്പോൾ ഈ സംവിധാനം തിളങ്ങുന്നു, കാരണം ഇത് ഇൻപുട്ട് സീക്വൻസിന്റെ എല്ലാ ഭാഗങ്ങളും അവയുടെ സ്ഥാനങ്ങൾ കണക്കിലെടുക്കാതെ പരിഗണിക്കുന്നു, അങ്ങനെ തുടർച്ചയായിട്ടില്ലാത്ത പ്രസക്തമായ വിവരങ്ങൾ തിരിച്ചറിയുന്നു.

ഇൻപുട്ട് (എൻകോഡർ), ഔട്ട്പുട്ട് (ഡീകോഡർ) സീക്വൻസുകൾ തമ്മിലുള്ള ബന്ധത്തെ അടിസ്ഥാനമാക്കി സന്ദർഭ വെക്റ്ററുകൾ സൃഷ്ടിക്കുന്ന പരമ്പരാഗത ശ്രദ്ധാ സംവിധാനങ്ങളിൽ നിന്ന് വ്യത്യസ്തമായി, സ്വയം ശ്രദ്ധാ സംവിധാനം സീക്വൻസിന്റെ ഓരോ ഘടകത്തിനും സീക്വൻസിനെ മാത്രം അടിസ്ഥാനമാക്കി ഒരു സന്ദർഭം സൃഷ്ടിക്കുന്നു. ഔട്ട്പുട്ട് സീക്വൻസ് പ്രവചിക്കുന്നതിൽ മാനുവൽ ഡാറ്റാ എൻട്രിയുടെയോ ബാഹ്യ സഹായത്തിന്റെയോ ആവശ്യകത കുറയ്ക്കുന്നതിനൊപ്പം സീക്വൻസിന്റെ വിവിധ ഭാഗങ്ങൾ തമ്മിലുള്ള പരസ്പര ആശ്രിതത്വവും ബന്ധങ്ങളും പഠിക്കാനും മനസ്സിലാക്കാനും ഇത് അനുവദിക്കുന്നു.

സ്വയം ശ്രദ്ധാ സംവിധാനത്തിൽ, ഇൻപുട്ട് സീക്വൻസിലെ ഓരോ ഘടകത്തിനും അതിനനുസൃതമായ ഭാരമുണ്ട്. ഈ ഭാരങ്ങൾ ശ്രേണിയിലെ മറ്റ് മൂലകങ്ങൾ നിലവിലെ മൂലകത്തെ എത്രത്തോളം സ്വാധീനിക്കണമെന്ന് നിർണ്ണയിക്കുന്നു. അതിനാൽ, സ്വയം ശ്രദ്ധാ സംവിധാനത്തിന് ക്രമത്തിലെ ഓരോ മൂലകത്തിന്റെയും പ്രാധാന്യം തൂക്കിനോക്കാനും അതിനനുസരിച്ച് സൃഷ്ടിച്ച ഔട്ട്പുട്ടിൽ അതിന്റെ സ്വാധീനം ക്രമീകരിക്കാനും കഴിയും.

ഉദാഹരണത്തിന്, സ്വാഭാവിക ഭാഷാ പ്രോസസ്സിംഗിന്റെ കാര്യത്തിൽ, സ്വയം ശ്രദ്ധാ സംവിധാനം ഒരു വാചകത്തിലെ ഓരോ വാക്കിനെയും മറ്റെല്ലാ വാക്കുകളെയും സ്വാധീനിക്കാൻ അനുവദിക്കുന്നു, ഇത് വാക്കുകൾ തമ്മിലുള്ള സന്ദർഭവും സെമാന്റിക് ബന്ധവും മനസിലാക്കാൻ മോഡലിനെ സഹായിക്കുന്നു. ക്രമത്തിലെ പരസ്പരാശ്രിതത്വം മനസിലാക്കാനും ഉപയോഗിക്കാനുമുള്ള ഈ കഴിവ് വാചക വിവർത്തനം, ടെക്സ്റ്റ് സംഗ്രഹം, വികാര വിശകലനം തുടങ്ങിയ ജോലികൾക്കായി സ്വയം ശ്രദ്ധാ സംവിധാനത്തെ അവിശ്വസനീയമാംവിധം ശക്തമായ ഉപകരണമാക്കി മാറ്റുന്നു.

മൾട്ടി-ഹെഡ് ശ്രദ്ധ

ട്രാൻസ്ഫോർമർ ശ്രദ്ധാ സംവിധാനത്തിന്റെ ഒരു പ്രത്യേക ഘടകമാണ് മൾട്ടി-ഹെഡ് ശ്രദ്ധ. മൾട്ടി-ഹെഡ് ശ്രദ്ധയ്ക്ക് പിന്നിലെ അടിസ്ഥാന ആശയം സമാന്തര പ്രോസസ്സിംഗ് എന്ന ആശയമാണ്, അവിടെ ശ്രദ്ധാ സംവിധാനം സമാന്തരമായി ഒന്നിലധികം തവണ പ്രയോഗിക്കുകയും ‘ശ്രദ്ധാ തലകൾ’ എന്നറിയപ്പെടുന്ന വ്യത്യസ്ത പാളികൾ സൃഷ്ടിക്കുകയും ചെയ്യുന്നു.

ഈ ശ്രദ്ധാ തലകൾ ഓരോന്നും ഇൻപുട്ട് സീക്വൻസും അനുബന്ധ ഔട്ട്പുട്ട് സീക്വൻസ് ഘടകവും സ്വതന്ത്രമായി പ്രോസസ്സ് ചെയ്യുന്നു. ഓരോ തലയും യഥാർത്ഥ സീക്വൻസുകളുടെ വ്യത്യസ്ത രേഖീയ പരിവർത്തനങ്ങളുമായി പ്രവർത്തിക്കുന്നു എന്നതാണ് സവിശേഷമായ വശം. ഇൻപുട്ട് സീക്വൻസിന്റെ വ്യത്യസ്ത സവിശേഷതകളിലും വശങ്ങളിലും ശ്രദ്ധ കേന്ദ്രീകരിക്കാൻ ഇത് ഓരോ ശ്രദ്ധാ മേധാവിയെയും അനുവദിക്കുന്നു, ഇത് ഡാറ്റയ്ക്കുള്ളിലെ വിശാലമായ വിവരങ്ങളും വിവിധ സൂക്ഷ്മതകളും പിടിച്ചെടുക്കാൻ മോഡലിനെ പ്രാപ്തമാക്കുന്നു.

ഓരോ തലയിലും സൃഷ്ടിക്കപ്പെടുന്ന ശ്രദ്ധാ സ്കോറുകൾ അല്ലെങ്കിൽ ഭാരങ്ങൾ സംയോജിപ്പിച്ച് അന്തിമ ശ്രദ്ധ സ്കോർ ഉണ്ടാക്കുന്നു. സംയോജിപ്പിക്കുന്ന പ്രക്രിയയിൽ ഓരോ തലയുടെയും ഔട്ട്പുട്ടുകൾ സംയോജിപ്പിക്കുകയും ഇത് ഒരു രേഖീയ പരിവർത്തനത്തിലൂടെ കൈമാറുകയും ചെയ്യുന്നു. തൽഫലമായ ഔട്ട്പുട്ട് ഇൻപുട്ടിന്റെ അതേ മാനങ്ങൾ നിലനിർത്തുന്നു, പക്ഷേ ഓരോ ഔട്ട്പുട്ട് സ്ഥാനത്തും ഇപ്പോൾ എല്ലാ ഇൻപുട്ട് സ്ഥാനങ്ങളിൽ നിന്നുമുള്ള വിവരങ്ങൾ അടങ്ങിയിരിക്കുന്നു, ഒന്നിലധികം ‘തലകൾ’ അല്ലെങ്കിൽ കാഴ്ചപ്പാടുകൾ കാണുന്നു.

ഈ മൾട്ടി-ഹെഡ് ശ്രദ്ധാ സംവിധാനം ഒരേസമയം ഇൻപുട്ട് സീക്വൻസിന്റെ വിവിധ ഭാഗങ്ങളിൽ ശ്രദ്ധ കേന്ദ്രീകരിക്കാൻ മോഡലിനെ അനുവദിക്കുന്നു, ഇത് ഡാറ്റയെക്കുറിച്ച് കൂടുതൽ സമഗ്രമായ ധാരണ നൽകുന്നു. സ്വാഭാവിക ഭാഷാ പ്രോസസ്സിംഗ്, ഇമേജ് റെക്കഗ്നിഷൻ തുടങ്ങിയ വിവിധ തരം വിവരങ്ങളോ സന്ദർഭോചിത സൂക്ഷ്മതകളോ പ്രസക്തമായ സങ്കീർണ്ണമായ ജോലികൾക്ക് ഈ ശേഷി പ്രത്യേകിച്ചും ഉപയോഗപ്രദമാണ്.

ശ്രദ്ധാ സംവിധാനം എങ്ങനെ പ്രവർത്തിക്കുന്നു?

പരമ്പരാഗത ശ്രദ്ധാ സംവിധാനങ്ങൾ ഇൻപുട്ടും ഔട്ട്പുട്ട് സീക്വൻസുകളും തമ്മിലുള്ള പരസ്പരാശ്രിതത്വത്തിൽ ശ്രദ്ധ കേന്ദ്രീകരിക്കുമ്പോൾ, ഇൻട്രാ-സീക്വൻസ് ബന്ധങ്ങളിലും സമാന്തര പ്രോസസ്സിംഗിലും ശ്രദ്ധ കേന്ദ്രീകരിക്കുന്നതിലൂടെ സ്വയം ശ്രദ്ധയും മൾട്ടി-ഹെഡ് ശ്രദ്ധയും സവിശേഷമായ കാഴ്ചപ്പാടുകൾ കൊണ്ടുവരുന്നു. ഇനിപ്പറയുന്ന വിഭാഗങ്ങൾ ഈ ശക്തമായ ശ്രദ്ധാ വകഭേദങ്ങളെക്കുറിച്ച് ആഴത്തിൽ പരിശോധിക്കും, ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസ് മോഡലുകളിലെ സീക്വൻസ് ധാരണയെ അവ എങ്ങനെ പുനർനിർവചിക്കുന്നുവെന്ന് പര്യവേക്ഷണം ചെയ്യും.

സ്വയം ശ്രദ്ധാ സംവിധാനം

“കുരയ്ക്കുന്നത് അവിശ്വസനീയമാംവിധം മനോഹരമാണ്, അവൻ ഒരു നായയാണ്” എന്ന വാചകം സങ്കൽപ്പിക്കുക. ഈ വാചകത്തിൽ ഒമ്പത് വാക്കുകൾ അല്ലെങ്കിൽ ടോക്കണുകൾ അടങ്ങിയിരിക്കുന്നു. ‘അവൻ’ എന്ന വാക്ക് വേർതിരിച്ചാൽ, ‘പിന്നെ’, ‘ഉണ്ട്’ എന്നീ രണ്ട് അടുത്ത വാക്കുകൾ നാം കാണുന്നു. എന്നിരുന്നാലും, ഈ വാക്കുകൾ ‘അവൻ’ എന്നതിന് അർത്ഥവത്തായ ഒരു സന്ദർഭവും നൽകുന്നില്ല. പകരം, ‘കുരയ്ക്കുക’, ‘നായ’ എന്നീ വാക്കുകൾ ‘അവൻ’ എന്നതിന് കൂടുതൽ സന്ദർഭോചിതമായി പ്രസക്തമാണ്. ഈ ഉദാഹരണം കാണിക്കുന്നത് ഒരു വാചകത്തിൽ, സന്ദർഭം പലപ്പോഴും സാമീപ്യത്തേക്കാൾ മുൻഗണന നേടുന്നു എന്നാണ്.

ഒരു കമ്പ്യൂട്ടർ ഈ വാക്യം പ്രോസസ്സ് ചെയ്യുമ്പോൾ, ഓരോ വാക്കിനും അല്ലെങ്കിൽ ടോക്കണിനും ഒരു വാക്ക് എംബഡിംഗ് നൽകുന്നു, V. എന്നിരുന്നാലും, ഈ പ്രാരംഭ ഉൾച്ചേർക്കലുകൾക്ക് സന്ദർഭമില്ല. യഥാർത്ഥ എംബഡിംഗ്, വിയേക്കാൾ കൂടുതൽ സന്ദർഭസമൃദ്ധമായ Y എന്ന അവസാന വാക്ക് ഉൾച്ചേർക്കാൻ ഭാരങ്ങളോ സമാനതകളോ പ്രയോഗിക്കുക എന്നതാണ് ലക്ഷ്യം.

ഉൾച്ചേർക്കൽ മേഖലയിൽ, സമാനമായ വാക്കുകൾക്ക് സമാനമായ എംബഡിംഗ് ഉണ്ട്, ഇത് എംബെഡിംഗ് സ്ഥലത്ത് അവയെ കൂടുതൽ അടുപ്പിക്കുന്നു. ഉദാഹരണത്തിന്, ‘രാജാവിന്’ അടുത്ത ബന്ധമുണ്ടാകും, അതിനാൽ ‘സീബ്ര’യേക്കാൾ ‘രാജ്ഞി’, ‘റോയൽറ്റി’ എന്നിവയുമായി സാമ്യമുണ്ട്. അതേസമയം, ‘സീബ്ര’ ‘വികാര’ത്തേക്കാൾ ‘കുതിര’യോടും ‘വരകളോടും’ കൂടുതൽ അടുപ്പമുള്ളതായിരിക്കും. ഈ ആശയം ഭാരം വെക്റ്ററുകൾ നിർണ്ണയിക്കുന്നതിനുള്ള അടിസ്ഥാനം സൃഷ്ടിക്കുന്നു, W. കൂടുതൽ സന്ദർഭം നേടുന്നതിന് വാക്ക് പരസ്പരം സംയോജിപ്പിക്കുക (ഡോട്ട് ഉൽപ്പന്നം വഴി) ഗുണിക്കുക എന്നതാണ് ആശയം. അതിനാൽ, ഞങ്ങളുടെ വാചകത്തിൽ, “പുറംതൊലി അവിശ്വസനീയമാംവിധം മനോഹരമാണ്, അവൻ ഒരു നായയാണ്”, അസംസ്കൃത പദം എംബെഡിംഗ്സ് ഉപയോഗിക്കുന്നതിനുപകരം, ഓരോ വാക്കും മറ്റെല്ലാവരുമായും ഉൾച്ചേർത്തതിന്റെ ഡോട്ട് ഉൽപ്പന്നം ഞങ്ങൾ കണക്കാക്കുന്നു.

വാചകത്തിലെ മറ്റെല്ലാ വാക്കുകളുടെയും എംബഡിംഗ് ഉപയോഗിച്ച് ആദ്യത്തെ വാക്കിന്റെ പ്രാരംഭ എംബഡിംഗ് ഡോട്ട് ഉൽപ്പന്നം എടുത്ത് ഞങ്ങൾ ആദ്യം ഭാരങ്ങൾ കണക്കാക്കുന്നു. ഈ ഭാരങ്ങൾ (W11 മുതൽ W19 വരെ) സാധാരണ നിലയിലാക്കുന്നു, അതിനാൽ അവ 1 ആയി കണക്കാക്കപ്പെടുന്നു. തുടർന്ന്, ഈ ഭാരങ്ങൾ വാക്യത്തിലെ എല്ലാ വാക്കുകളുടെയും പ്രാരംഭ ഉൾച്ചേർക്കൽ ഉപയോഗിച്ച് ഗുണിക്കുന്നു.

W11 V1 + W12 V2 + …. W19 V9 = Y1

ഇവിടെ, W11 മുതൽ W19 വരെയുള്ള എല്ലാ ഭാരങ്ങളും ആദ്യത്തെ വാക്കായ V1 ന്റെ സന്ദർഭം ഉൾക്കൊള്ളുന്നവയാണ്. അതിനാൽ, ഓരോ വാക്കും ഉപയോഗിച്ച് ഈ ഭാരങ്ങൾ ഗുണിക്കുമ്പോൾ, ആദ്യത്തെ വാക്കുമായി താരതമ്യപ്പെടുത്തുമ്പോൾ മറ്റെല്ലാ വാക്കുകളും ഞങ്ങൾ അടിസ്ഥാനപരമായി വീണ്ടും പരിശോധിക്കുന്നു. ഇതിനർത്ഥം ‘ബാർക്ക്’ എന്ന വാക്ക് ഇപ്പോൾ ‘നായ’, ‘ക്യൂട്ട്’ എന്നീ വാക്കുകളുമായി കൂടുതൽ ശക്തമായി ബന്ധപ്പെട്ടിരിക്കുന്നു എന്നാണ്.

വാചകത്തിലെ എല്ലാ വാക്കുകൾക്കും ഈ പ്രക്രിയ ആവർത്തിക്കുന്നു; അതിനാൽ, ഓരോ വാക്കിനും വാചകത്തിലെ മറ്റെല്ലാ വാക്കുകളിൽ നിന്നും സന്ദർഭം നൽകുന്നു. ഒരു വാചകത്തിലെ വാക്കുകൾക്ക് സന്ദർഭം നൽകുന്ന ഈ സാങ്കേതികതയെ സ്വയം ശ്രദ്ധ എന്ന് വിളിക്കുന്നു. സ്വയം ശ്രദ്ധയുടെ ഏറ്റവും രസകരമായ ഒരു വശം ഇത് വാക്ക് ക്രമം, പദ സാമീപ്യം അല്ലെങ്കിൽ വാചക ദൈർഘ്യം എന്നിവയെ ആശ്രയിക്കുന്നില്ല എന്നതാണ്, ഇതിന് ഭാരങ്ങളൊന്നും പരിശീലിപ്പിക്കേണ്ടതില്ല.

സെൽഫ്-അറ്റൻഷൻ മെക്കാനിസത്തിന്റെ, പ്രാരംഭ വാക്ക് എംബെഡിംഗ്സ് (വി) മൂന്ന് തവണ പ്രത്യക്ഷപ്പെടുന്നു. പ്രാരംഭ വാക്ക് ഉൾച്ചേർക്കലിനും വാചകത്തിലെ മറ്റെല്ലാ പദങ്ങൾക്കും (വാക്ക് ഉൾപ്പെടെ) ഇടയിലുള്ള ഡോട്ട് ഉൽപ്പന്നം കണ്ടെത്താൻ അവ ആദ്യം ഉപയോഗിക്കുന്നു. ഈ കണക്കുകൂട്ടൽ ഭാരങ്ങൾ സൃഷ്ടിക്കുന്നു, തുടർന്ന് അന്തിമ സന്ദർഭ സമ്പന്നമായ എംബെഡിംഗ്സ് നൽകുന്നതിന് മൂന്നാം തവണ എംബെഡിംഗ്സ് എന്ന വാക്ക് ഉപയോഗിച്ച് ഗുണിക്കുന്നു. ഈ സാഹചര്യത്തിൽ, V-യുടെ ഈ മൂന്ന് സംഭവങ്ങൾക്ക് പകരം Query, Keys, Values എന്നീ പദങ്ങൾ ഉപയോഗിക്കാം.

ആദ്യത്തെ വാക്കായ V1-മായി ബന്ധപ്പെട്ട് എല്ലാ വാക്കുകളും ക്രമീകരിക്കാൻ ഞങ്ങൾ ലക്ഷ്യമിടുന്നുവെന്ന് കരുതുക. തുടർന്ന് ഞങ്ങൾ V1 നെ Query വാക്കായി നിയോഗിക്കുന്നു. ഈ Query word ഒരു ഡോട്ട് ഉൽപ്പന്നത്തെ വാചകത്തിലെ മറ്റെല്ലാ പദങ്ങളുമായും (V1 മുതൽ V9 വരെ) കണക്കാക്കുന്നു – ഇവ കീകളായി കണക്കാക്കപ്പെടുന്നു. Query ഉം Keys ഉം തമ്മിലുള്ള ഈ പ്രതിപ്രവർത്തനം ഭാരങ്ങൾ നൽകുന്നു. ഈ ഭാരങ്ങൾ പിന്നീട് എല്ലാ വാക്കുകളും ഉപയോഗിച്ച് ഒരിക്കൽ കൂടി (V1 മുതൽ V9 വരെ) ഗുണിക്കുന്നു, ഇത് മൂല്യങ്ങളായി പ്രവർത്തിക്കുന്നു. ഈ പ്രക്രിയ ഞങ്ങൾക്ക് ചോദ്യം, കീകൾ, മൂല്യങ്ങൾ എന്നിവയുടെ ആശയങ്ങൾ നൽകുന്നു.

ഒരു ക്രമത്തിനുള്ളിൽ പരസ്പരാശ്രിതത്വം പിടിച്ചെടുക്കുന്നതിൽ സ്വയം ശ്രദ്ധാ സംവിധാനം കാര്യമായ നേട്ടങ്ങൾ നൽകുന്നുണ്ടെങ്കിലും, അതുമായി ബന്ധപ്പെട്ട ചില പരിമിതികളോ ചതിക്കുഴികളോ ഉണ്ട്:

കംപ്യൂട്ടേഷണൽ ചെലവ്: സ്വയം ശ്രദ്ധയ്ക്ക് ഒരു ക്രമത്തിലെ എല്ലാ മൂലകങ്ങളും തമ്മിലുള്ള ജോഡി തിരിച്ചുള്ള പ്രതിപ്രവർത്തനങ്ങളുടെ കണക്കുകൂട്ടൽ ആവശ്യമാണ്, ഇത് സീക്വൻസ് ദൈർഘ്യത്തിന്റെ അടിസ്ഥാനത്തിൽ ക്വാഡ്രാറ്റിക് കമ്പ്യൂട്ടേഷണൽ സങ്കീർണ്ണതയിലേക്ക് നയിക്കുന്നു. ദൈർഘ്യമേറിയ സീക്വൻസുകൾ കൈകാര്യം ചെയ്യുമ്പോൾ ഇത് ഗണ്യമായ പോരായ്മയാകാം, ഇത് കണക്കുകൂട്ടലിൽ ചെലവേറിയതാക്കുന്നു.

സ്ഥാന വിവരങ്ങളുടെ അഭാവം: മൂലകങ്ങൾ തമ്മിലുള്ള സാമ്യതയെ അടിസ്ഥാനമാക്കി സ്വയം ശ്രദ്ധ വെയ്റ്റേജ് കണക്കാക്കുന്നതിനാൽ, ക്രമത്തിനുള്ളിലെ മൂലകങ്ങളുടെ സമ്പൂർണ്ണ അല്ലെങ്കിൽ ആപേക്ഷിക സ്ഥാനങ്ങളെക്കുറിച്ചുള്ള വിവരങ്ങൾ അതിൽ ഇല്ല. പൊസിഷനൽ എൻകോഡിംഗുകൾ അല്ലെങ്കിൽ ആപേക്ഷിക പൊസിഷനൽ എംബഡിംഗ്സ് ഉപയോഗിച്ച് ഈ പ്രശ്നം ലഘൂകരിക്കാൻ കഴിയുമെങ്കിലും, അത്തരം സ്ഥാന വിവരങ്ങൾ ഉൾപ്പെടുത്തുന്നതിനുള്ള ഒരു അധിക ഘട്ടം ഇത് ഇപ്പോഴും അവതരിപ്പിക്കുന്നു.

മെമ്മറി തീവ്രത: ശ്രദ്ധാ മാപ്പുകൾ സംഭരിക്കാൻ സ്വയം ശ്രദ്ധാ സംവിധാനം ഉയർന്ന അളവിൽ മെമ്മറി ആവശ്യപ്പെടുന്നു, പ്രത്യേകിച്ച് ദൈർഘ്യമേറിയ സീക്വൻസുകൾക്ക്. വലിയ മോഡലുകളെ പരിശീലിപ്പിക്കുമ്പോഴോ കൂടുതൽ സീക്വൻസ് ദൈർഘ്യത്തോടെ പ്രവർത്തിക്കുമ്പോഴോ ഇത് ഒരു പ്രധാന വെല്ലുവിളി ഉയർത്തും.

പ്രാദേശിക ആശ്രിതത്വങ്ങൾ മോഡലുചെയ്യുന്നതിലെ ബുദ്ധിമുട്ട്: ആഗോള ആശ്രിതത്വങ്ങൾ പിടിച്ചെടുക്കുന്നതിൽ അതിന്റെ ശക്തിയുണ്ടെങ്കിലും, പ്രാദേശിക ആശ്രിതത്വങ്ങളെ മാതൃകയാക്കുന്നതിനോ പ്രാദേശിക വിവരങ്ങൾ കൺവലൂഷണൽ അല്ലെങ്കിൽ ആവർത്തിച്ചുള്ള നെറ്റ് വർക്കുകൾ പോലെ ഫലപ്രദമായി ചൂഷണം ചെയ്യുന്നതിനോ സ്വയം ശ്രദ്ധ ബുദ്ധിമുട്ടുകൾ നേരിടേണ്ടി വന്നേക്കാം, പ്രത്യേകിച്ചും ചിത്രങ്ങൾ പോലുള്ള ഉയർന്ന റെസല്യൂഷൻ ഇൻപുട്ടുകൾ കൈകാര്യം ചെയ്യുമ്പോൾ.

വ്യാഖ്യാനത്തിന്റെ അഭാവം: ശ്രദ്ധ ഭാരങ്ങൾക്ക് ചിലപ്പോൾ ചില തലത്തിലുള്ള വ്യാഖ്യാനക്ഷമത നൽകാൻ കഴിയുമെങ്കിലും, സ്വയം ശ്രദ്ധയിൽ പഠിച്ച ആശ്രിതത്വങ്ങൾ പൂർണ്ണമായി മനസിലാക്കാനും വ്യാഖ്യാനിക്കാനും പലപ്പോഴും ബുദ്ധിമുട്ടാണ്. ശ്രദ്ധയുടെ ഒന്നിലധികം പാളികൾ അല്ലെങ്കിൽ മൾട്ടി-ഹെഡ് ശ്രദ്ധ പോലുള്ള സങ്കീർണ്ണമായ ഘടനകൾ കൈകാര്യം ചെയ്യുമ്പോൾ ഇത് പ്രത്യേകിച്ചും സത്യമാണ്.

ഓവർഫിറ്റിംഗിന്റെ അപകടസാധ്യത: എല്ലാ ജോഡി തിരിച്ചുള്ള ആശ്രിതത്വങ്ങളും പിടിച്ചെടുക്കാനുള്ള കഴിവുള്ളതിനാൽ, സ്വയം ശ്രദ്ധ പരിശീലന ഡാറ്റയ്ക്ക് അമിതമായി യോജിച്ചേക്കാം, പ്രത്യേകിച്ചും ചെറിയ ഡാറ്റാസെറ്റുകൾ കൈകാര്യം ചെയ്യുമ്പോൾ.

ഈ ചതിക്കുഴികൾക്കിടയിലും, പല ആപ്ലിക്കേഷനുകളിലും സ്വയം ശ്രദ്ധ ഒരു ശക്തമായ സംവിധാനമാണെന്ന് തെളിയിക്കപ്പെട്ടിട്ടുണ്ട്, തുടർന്നുകൊണ്ടിരിക്കുന്ന ഗവേഷണം ഈ വെല്ലുവിളികൾക്ക് തുടർച്ചയായി പരിഹാരങ്ങൾ കണ്ടെത്തുന്നു.

മൾട്ടി-ഹെഡ് ശ്രദ്ധാ സംവിധാനം

ഇൻപുട്ടിന്റെ വിവിധ വശങ്ങളിൽ ഒരേസമയം ശ്രദ്ധ കേന്ദ്രീകരിക്കാനുള്ള ശ്രദ്ധാ സംവിധാനത്തിന്റെ കഴിവ് വർദ്ധിപ്പിക്കുന്നതിന് മൾട്ടി-ഹെഡ് ശ്രദ്ധ എന്ന ആശയം പ്രവർത്തിക്കുന്നു. നമുക്ക് വാചകം വീണ്ടും പരിശോധിക്കാം – “കുരയ്ക്കൽ വളരെ മനോഹരമാണ്, അവൻ ഒരു നായയാണ്.” ‘നായ’ എന്ന വാക്ക് പരിഗണിക്കുമ്പോൾ, വ്യാകരണപരമായി, ‘കുരയ്ക്കുക’, ‘ക്യൂട്ട്’, ‘അവൻ’ എന്നീ വാക്കുകൾക്ക് ‘നായ’യുമായി താരതമ്യപ്പെടുത്തുമ്പോൾ പ്രാധാന്യമുണ്ടെന്ന് ഞങ്ങൾ മനസ്സിലാക്കുന്നു. ഈ വാക്കുകൾ സൂചിപ്പിക്കുന്നത് നായയുടെ പേര് ബാർക്ക് എന്നാണ്, അവൻ പുരുഷനാണ്, അവൻ സുന്ദരിയായി കണക്കാക്കപ്പെടുന്നു. ഒരൊറ്റ ശ്രദ്ധാ സംവിധാനം ഈ മൂന്ന് വാക്കുകളെ ‘നായ’യ്ക്ക് പ്രസക്തമാണെന്ന് ശരിയായി തിരിച്ചറിയാൻ കഴിഞ്ഞേക്കില്ല, മൂന്ന് വ്യത്യസ്ത ശ്രദ്ധാ സംവിധാനങ്ങൾ ഉപയോഗിക്കുന്നത് ഈ വാക്കുകളെ ‘നായ’യുമായി ബന്ധിപ്പിക്കുന്നതിൽ കൂടുതൽ ഫലപ്രദമാകുമെന്ന് സൂചിപ്പിക്കുന്നു. ഈ സമീപനം പ്രസക്തമായ എല്ലാ വാക്കുകളും തിരിച്ചറിയുന്നതിനുള്ള ഒരൊറ്റ ശ്രദ്ധാ സംവിധാനത്തിന്റെ ഭാരം കുറയ്ക്കുകയും കൂടുതൽ പ്രസക്തമായ വാക്കുകൾ കണ്ടെത്താനുള്ള സാധ്യത വർദ്ധിപ്പിക്കുകയും ചെയ്യുന്നു.

ഇത് നടപ്പിലാക്കുന്നതിന്, കീകൾ, അന്വേഷണങ്ങൾ, മൂല്യങ്ങൾ എന്നിവയെ പ്രതിനിധീകരിക്കുന്നതിന് ഞങ്ങൾ കൂടുതൽ രേഖീയ പാളികൾ ചേർക്കുന്നു. ഈ പാളികൾ സമാന്തരമായി പ്രവർത്തിക്കുകയും സ്വതന്ത്ര ഭാരം വഹിക്കുകയും ചെയ്യുന്നു. അതിനാൽ, ഒരൊറ്റ ഔട്ട്പുട്ട് സൃഷ്ടിക്കുന്നതിനുപകരം, ഓരോ കീകളും ചോദ്യങ്ങളും മൂല്യങ്ങളും മൂന്ന് ഔട്ട്പുട്ടുകൾ ഉത്പാദിപ്പിക്കുന്നു. ഈ മൂന്ന് സെറ്റ് താക്കോലുകളും അന്വേഷണങ്ങളും മൂന്ന് വ്യത്യസ്ത സെറ്റ് ഭാരങ്ങൾക്ക് കാരണമാകുന്നു. ഈ ഭാരങ്ങൾ ഓരോന്നും മാട്രിക്സ് ഗുണനത്തിലൂടെ മൂന്ന് മൂല്യങ്ങളുമായി സംവദിക്കുന്നു, അതിന്റെ ഫലമായി മൂന്ന് വ്യത്യസ്ത ഔട്ട്പുട്ടുകൾ ഉണ്ടാകുന്നു. ഈ മൂന്ന് ശ്രദ്ധാ ബ്ലോക്കുകൾ ഒടുവിൽ ഒരൊറ്റ അന്തിമ ശ്രദ്ധാ ഔട്ട്പുട്ട് നൽകുന്നതിന് സംയോജിപ്പിക്കപ്പെടുന്നു.

എന്നിരുന്നാലും, ഈ ഉദാഹരണത്തിനായി മൂന്നാം നമ്പർ ഏകപക്ഷീയമായി തിരഞ്ഞെടുത്തു. വാസ്തവത്തിൽ, രേഖീയ പാളികളുടെ എണ്ണം അല്ലെങ്കിൽ “തലകൾ” ഏത് സംഖ്യയും ആകാം. ഓരോ ഹെഡ്ഡും ഒരു പ്രത്യേക ശ്രദ്ധാ ഔട്ട്പുട്ട് നൽകുന്നു, ഈ ഔട്ട്പുട്ടുകൾ ഒരുമിച്ച് സംയോജിപ്പിച്ചിരിക്കുന്നു, അതിനാലാണ് ഇതിനെ “മൾട്ടി-ഹെഡ്” ശ്രദ്ധ എന്ന് വിളിക്കുന്നത്.

ശ്രദ്ധാ സംവിധാനത്തിന്റെ പ്രയോഗം – ട്രാൻസ്ഫോർമർ ആർക്കിടെക്ചർ

“ട്രാൻസ്ഫോർമർ” എന്നറിയപ്പെടുന്ന സവിശേഷമായ ഒരു ഘടനയാണ് ‘ശ്രദ്ധ നിങ്ങൾക്ക് ആവശ്യമുള്ളതെല്ലാം’ എന്ന ശ്രദ്ധേയമായ ഗവേഷണ രേഖ അവതരിപ്പിക്കുന്നത്. പേര് സൂചിപ്പിക്കുന്നത് പോലെ, ഈ മോഡൽ മുമ്പ് സൂചിപ്പിച്ച ശ്രദ്ധാ സംവിധാനം ഉപയോഗിക്കുന്നു. എൽഎസ്ടിഎമ്മുമായി താരതമ്യപ്പെടുത്തുമ്പോൾ, രണ്ട് ഘടകങ്ങൾ (എൻകോഡർ, ഡീകോഡർ) ഉപയോഗിച്ച് ഒരു സീക്വൻസിനെ മറ്റൊന്നിലേക്ക് പരിവർത്തനം ചെയ്യുന്നതിനാണ് ട്രാൻസ്ഫോർമർ രൂപകൽപ്പന ചെയ്തിരിക്കുന്നത്, എന്നിരുന്നാലും ആവർത്തിച്ചുള്ള നെറ്റ്വർക്കുകളൊന്നും (ജിആർയു, എൽഎസ്ടിഎം മുതലായവ) ഉൾപ്പെടുത്താതെ നിലവിലുള്ള സീക്വൻസ്-ടു-സീക്വൻസ് മോഡലുകളിൽ നിന്ന് ഇത് വേറിട്ടുനിൽക്കുന്നു.

സീക്വൻസുകളിലെ താൽക്കാലിക ആശ്രിതത്വം കൈകാര്യം ചെയ്യുന്നതിനുള്ള ഏറ്റവും ഫലപ്രദമായ രീതികളിലൊന്നായി ആവർത്തിച്ചുള്ള നെറ്റ് വർക്കുകൾ കണക്കാക്കപ്പെടുന്നു. എന്നിരുന്നാലും, ശ്രദ്ധാ സംവിധാനങ്ങൾ മാത്രം ഉപയോഗിക്കുന്നതും ഏതെങ്കിലും തരത്തിലുള്ള ആവർത്തന ന്യൂറൽ നെറ്റ് വർക്കുകൾ (ആർഎൻഎൻ) പൂർണ്ണമായും ഒഴിവാക്കുന്നതുമായ ഒരു ചട്ടക്കൂടിന് വിവർത്തനം പോലുള്ള ജോലികളിൽ നിലവിലുള്ള മോഡലുകളെക്കാൾ മികച്ച പ്രകടനം കാഴ്ചവയ്ക്കാൻ കഴിയുമെന്ന് ഈ പ്രബന്ധത്തിന് പിന്നിലുള്ള ഗവേഷണ സംഘം തെളിയിച്ചിട്ടുണ്ട്. അതിനാൽ, ഞങ്ങൾ ചോദിക്കുന്നു, ഒരു ട്രാൻസ്ഫോർമർ കൃത്യമായി എന്താണ്?

എൻകോഡർ മൊഡ്യൂൾ ഇടതുവശത്തും ഡീകോഡർ വലതുവശത്തും സ്ഥാപിച്ചിരിക്കുന്നു. എൻകോഡറും ഡീകോഡറും ആവർത്തിച്ച് അടുക്കിവയ്ക്കാൻ കഴിയുന്ന മൊഡ്യൂളുകൾ കൊണ്ടാണ് നിർമ്മിച്ചിരിക്കുന്നത്, രേഖാചിത്രത്തിൽ Nx സൂചിപ്പിക്കുന്നു. ഈ മൊഡ്യൂളുകളുടെ പ്രധാന ഘടകങ്ങൾ മൾട്ടി-ഹെഡ് ശ്രദ്ധയും ഫീഡ്-ഫോർവേഡ് ലെയറുകളുമാണ്. ഞങ്ങൾക്ക് നേരിട്ട് സ്ട്രിംഗുകൾ ഉപയോഗിച്ച് പ്രവർത്തിക്കാൻ കഴിയാത്തതിനാൽ, ഇൻപുട്ടും ഔട്ട്പുട്ടും (ടാർഗെറ്റ് വാചകങ്ങൾ) തുടക്കത്തിൽ എൻ-ഡയമെൻഷണൽ സ്പേസിലേക്ക് മാപ്പ് ചെയ്യുന്നു.

ഈ മോഡലിന്റെ സൂക്ഷ്മമായി നിർണായകമായ ഒരു വശം ഓരോ വാക്കിനും കാരണമായ സ്ഥാന എൻകോഡിംഗ് ആണ്. മോഡലിലേക്ക് സീക്വൻസുകൾ ഇൻപുട്ട് ചെയ്യുന്ന ക്രമം ഓർമ്മിക്കാൻ കഴിവുള്ള ആവർത്തിച്ചുള്ള നെറ്റ് വർക്കുകളുടെ അഭാവത്തിൽ, സീക്വൻസിന്റെ പ്രാധാന്യം അതിന്റെ ഘടകങ്ങളുടെ ക്രമത്തെ ആശ്രയിച്ചിരിക്കുന്നതിനാൽ ഞങ്ങളുടെ സീക്വൻസിലെ ഓരോ ഭാഗത്തിനും / വാക്കിനും ആപേക്ഷിക സ്ഥാനം നൽകേണ്ടത് ആവശ്യമാണ്. ഈ സ്ഥാനങ്ങൾ ഓരോ വാക്കിന്റെയും ഉൾച്ചേർത്ത രൂപത്തെ പ്രതിനിധീകരിക്കുന്ന എൻ-ഡയമെൻഷണൽ വെക്റ്ററിലേക്ക് ചേർത്തിരിക്കുന്നു.

ഇപ്പോൾ, മോഡലിന്റെ ഈ മൾട്ടി-ഹെഡ് ശ്രദ്ധാ ഘടകങ്ങളിലേക്ക് കുറച്ചുകൂടി ആഴത്തിൽ പരിശോധിക്കാം:

ശ്രദ്ധാ സംവിധാനത്തിന്റെ ഇടതുവശത്തെ ചിത്രീകരണത്തോടെ നമുക്ക് ആരംഭിക്കാം. ഇത് തികച്ചും ലളിതമാണ്, ഇനിപ്പറയുന്ന സൂത്രവാക്യം ഉപയോഗിച്ച് പ്രകടിപ്പിക്കാം:

Q എന്നത് ചോദ്യം കൈവശമുള്ള ഒരു മാട്രിക്സിനെ പ്രതിനിധീകരിക്കുന്നു (ക്രമത്തിലെ ഒരൊറ്റ വാക്കിന്റെ വെക്റ്ററൈസ്ഡ് പ്രാതിനിധ്യം), K യിൽ എല്ലാ കീകളും അടങ്ങിയിരിക്കുന്നു (ക്രമത്തിലെ ഓരോ വാക്കിന്റെയും വെക്റ്ററൈസ്ഡ് പ്രാതിനിധ്യങ്ങൾ), V മൂല്യങ്ങളെ സൂചിപ്പിക്കുന്നു, അവ ക്രമത്തിലെ എല്ലാ വാക്കുകളുടെയും വെക്റ്ററൈസ്ഡ് പ്രാതിനിധ്യങ്ങളാണ്. എൻകോഡറിലെയും ഡീകോഡറിലെയും മൾട്ടി-ഹെഡ് ശ്രദ്ധാ മൊഡ്യൂളുകൾക്ക്, V എന്നത് Q ന്റെ അതേ വാക്ക് സീക്വൻസ് ഉൾക്കൊള്ളുന്നു. എന്നിരുന്നാലും, എൻകോഡർ, ഡീകോഡർ സീക്വൻസുകൾ പരിഗണിക്കുന്ന ശ്രദ്ധാ മൊഡ്യൂളിൽ, Q പ്രതിനിധീകരിക്കുന്ന സീക്വൻസിൽ നിന്ന് V വ്യത്യസ്തമാണ്.

ഇത് ലളിതമാക്കാൻ, V-യിലെ മൂല്യങ്ങൾ ചില ശ്രദ്ധാ ഭാരങ്ങൾ ഉപയോഗിച്ച് ഗുണിക്കുകയും സംഗ്രഹിക്കുകയും ചെയ്യുന്നുവെന്ന് പ്രസ്താവിക്കാം, അവിടെ ശ്രേണിയിലെ ഓരോ വാക്കും (Q പ്രതിനിധീകരിക്കുന്നു) സീക്വൻസിലെ മറ്റെല്ലാ വാക്കുകളാലും (കെ പ്രതിനിധീകരിക്കുന്നു) എങ്ങനെ സ്വാധീനിക്കപ്പെടുന്നു എന്നതിനെ ആശ്രയിച്ചാണ് ഭാരങ്ങൾ നിർണ്ണയിക്കുന്നത്. കൂടാതെ, 0 നും 1 നും ഇടയിലുള്ള വിതരണം ഉറപ്പാക്കുന്നതിന് ഭാരങ്ങളിൽ ഒരു സോഫ്റ്റ്മാക്സ് ഫംഗ്ഷൻ ഉപയോഗിക്കുന്നു. ഈ ഭാരങ്ങൾ പിന്നീട് V-യിൽ അടങ്ങിയിരിക്കുന്ന എല്ലാ വാക്കുകൾക്കും പ്രയോഗിക്കുന്നു (എൻകോഡറിനും ഡീകോഡറിനും Q പോലെ സമാനമായ വെക്റ്ററുകൾ, എന്നാൽ എൻകോഡർ, ഡീകോഡർ എന്നിവയിൽ നിന്നുള്ള ഇൻപുട്ടുകൾ ഉൾപ്പെടുന്ന മൊഡ്യൂളിന് വ്യത്യസ്തമാണ്).

ഈ ശ്രദ്ധാ സംവിധാനം ഒരേസമയം ഉപയോഗിക്കുന്നതിന് ഒന്നിലധികം സമാന്തര സംവിധാനങ്ങളായി എങ്ങനെ വിതരണം ചെയ്യാമെന്ന് വലതുവശത്തെ രേഖാചിത്രം ചിത്രീകരിക്കുന്നു. Q, K, V എന്നിവയുടെ ലീനിയർ പ്രൊജക്ഷനുകൾ ഉപയോഗിച്ച് ശ്രദ്ധാ സംവിധാനം ഒന്നിലധികം തവണ ആവർത്തിക്കുന്നു. ഈ കഴിവ് വ്യത്യസ്ത ക്യു, കെ, വി പ്രാതിനിധ്യങ്ങളിൽ നിന്ന് പഠിക്കാൻ സിസ്റ്റത്തെ പ്രാപ്തമാക്കുന്നു, ഇത് മോഡലിന് ഗുണം ചെയ്യുന്നു. പരിശീലന വേളയിൽ പഠിച്ച ഭാര മാട്രിസുകൾ W ഉപയോഗിച്ച് Q, K, V എന്നിവ ഗുണിച്ചാണ് ഈ രേഖീയ പ്രാതിനിധ്യങ്ങൾ നിർവഹിക്കുന്നത്.

ക്യൂ, കെ, വി എന്നീ മാട്രിസുകൾ ആർക്കിടെക്ചറിനുള്ളിലെ ശ്രദ്ധാ മൊഡ്യൂളുകളുടെ ഓരോ സ്ഥാനത്തിനും വ്യത്യാസപ്പെടുന്നു, അവ എൻകോഡർ, ഡീകോഡർ അല്ലെങ്കിൽ എൻകോഡറും ഡീകോഡറും ബന്ധിപ്പിക്കുന്ന പ്രദേശത്താണോ സ്ഥിതിചെയ്യുന്നത് എന്നതിനെ അടിസ്ഥാനമാക്കി. എൻകോഡറിന്റെ മുഴുവൻ ഇൻപുട്ട് സീക്വൻസിലോ അല്ലെങ്കിൽ ഡീകോഡറിൽ നിന്നുള്ള ഇൻപുട്ട് സീക്വൻസിന്റെ ഒരു ഭാഗത്തിലോ ശ്രദ്ധ കേന്ദ്രീകരിക്കാൻ ഞങ്ങൾ ലക്ഷ്യമിടുന്നതിനാലാണ് ഈ വ്യതിയാനം ഉണ്ടാകുന്നത്. എൻകോഡറും ഡീകോഡറും ബന്ധിപ്പിക്കുന്ന മൾട്ടി-ഹെഡ് ശ്രദ്ധാ മൊഡ്യൂൾ എൻകോഡറിന്റെ ഇൻപുട്ട് സീക്വൻസ് ഒരു നിശ്ചിത സ്ഥാനം വരെ ഡീകോഡറിന്റെ ഇൻപുട്ട് സീക്വൻസിനൊപ്പം പരിഗണിക്കുന്നുവെന്ന് ഉറപ്പാക്കുന്നു.

എൻകോഡറിലെയും ഡീകോഡറിലെയും മൾട്ടി-ശ്രദ്ധാ തലകളെ പിന്തുടർന്ന്, പോയിന്റ് തിരിച്ചുള്ള ഫീഡ്-ഫോർവേഡ് പാളി നിലവിലുണ്ട്. ഈ കോംപാക്റ്റ് ഫീഡ്-ഫോർവേഡ് നെറ്റ്വർക്ക് ഓരോ സ്ഥാനത്തിനും സമാനമായ പാരാമീറ്ററുകൾ നിലനിർത്തുന്നു, ഇത് നൽകിയ ക്രമത്തിൽ നിന്ന് ഓരോ മൂലകത്തിന്റെയും പ്രത്യേകവും സമാനവുമായ രേഖീയ പരിവർത്തനമായി വ്യാഖ്യാനിക്കാം.

ചുരുക്കത്തിൽ – ട്രാൻസ്ഫോർമർ ആർക്കിടെക്ചർ എങ്ങനെ പ്രവർത്തിക്കുന്നു എന്നതിന്റെ ഘട്ടം ഘട്ടമായുള്ള നടത്തം ഇതാ:

ശ്രദ്ധാ സംവിധാനം: ആർഎൻഎനുകളിൽ നിന്നും അവയുടെ വേരിയന്റുകളിൽ നിന്നും വ്യത്യസ്തമായി, മുമ്പ് സൃഷ്ടിക്കപ്പെട്ട എല്ലാ ടോക്കണുകളിലും “അറ്റൻഡ്” അല്ലെങ്കിൽ “ഫോക്കസ്” ചെയ്യാൻ ശ്രദ്ധാ സംവിധാനം ട്രാൻസ്ഫോർമറിനെ പ്രാപ്തമാക്കുന്നു. ഒരു പരിധിയില്ലാത്ത മെമ്മറി വിൻഡോ പരിപാലിക്കുന്നത് ടെക്സ്റ്റ് ജനറേറ്റുചെയ്യുമ്പോൾ മുഴുവൻ സന്ദർഭവും മനസിലാക്കാനും ഉപയോഗിക്കാനും ട്രാൻസ്ഫോർമറിനെ അനുവദിക്കുന്നു.

ഇൻപുട്ട് എംബഡിംഗ്സ്: പ്രാരംഭ ഘട്ടത്തിൽ, ഇൻപുട്ട് ഒരു വേഡ് എംബഡിംഗ് ലെയറിലേക്ക് നൽകുന്നു. ഓരോ വാക്കിന്റെയും പഠിച്ച വെക്റ്റർ പ്രാതിനിധ്യം ലഭിക്കുന്നതിന് ഈ പാളി ഒരു ലുക്ക് അപ്പ് ടേബിളായി പ്രവർത്തിക്കുന്നു. എംബെഡിംഗ് ലെയർ എന്ന വാക്ക് ന്യൂറൽ നെറ്റ് വർക്കുകൾക്ക് മനസ്സിലാക്കാൻ കഴിയുന്ന തരത്തിൽ വാക്കുകളെ തുടർച്ചയായ മൂല്യ വെക്റ്ററുകളാക്കി മാറ്റുന്നു.

പൊസിഷണൽ എൻകോഡിംഗ്: അടുത്ത ഘട്ടത്തിൽ എംബഡിംഗ്സിലേക്ക് സ്ഥാന വിവരങ്ങൾ കുത്തിവയ്ക്കുന്നത് ഉൾപ്പെടുന്നു. ട്രാൻസ്ഫോർമർ എൻകോഡറുകൾക്ക് ആർഎൻഎൻ പോലെ ആവർത്തനം ഇല്ലാത്തതിനാൽ, ക്രമത്തിലെ ഓരോ വാക്കിന്റെയും സ്ഥാനത്തെക്കുറിച്ചുള്ള വിവരങ്ങൾ ചേർക്കേണ്ടത് പ്രധാനമാണ്.

എൻകോഡറും ഡീകോഡറും: ട്രാൻസ്ഫോർമർ ആർക്കിടെക്ചർ അടിസ്ഥാനപരമായി ശ്രദ്ധ അടിസ്ഥാനമാക്കിയുള്ള എൻകോഡർ-ഡീകോഡർ ടൈപ്പ് ആർക്കിടെക്ചറാണ്. എൻകോഡർ, ഡീകോഡർ സ്റ്റാക്കുകൾ എന്നിവയ്ക്ക് അവയുമായി ബന്ധപ്പെട്ട എംബഡിംഗ് പാളികളുണ്ട്. അന്തിമ ഔട്ട്പുട്ട് സൃഷ്ടിക്കാൻ ഒരു അധിക ഔട്ട്പുട്ട് ലെയർ ഉപയോഗിക്കുന്നു. ഓരോ എൻകോഡറിനും ഡീകോഡറിനും അതിന്റേതായ ഭാരങ്ങളുണ്ട്. എൻകോഡർ ഒരു ഇൻപുട്ട് സീക്വൻസിനെ തുടർച്ചയായ അമൂർത്ത പ്രാതിനിധ്യത്തിലേക്ക് മാപ്പ് ചെയ്യുന്നു, അതിൽ ആ ഇൻപുട്ടിന്റെ പഠിച്ച എല്ലാ വിവരങ്ങളും അടങ്ങിയിരിക്കുന്നു. ഡീകോഡർ ഒരു ഔട്ട്പുട്ട് സൃഷ്ടിക്കാൻ ആ പ്രാതിനിധ്യം ഉപയോഗിക്കുന്നു, ഒരു സമയത്ത് ഓരോ ഘട്ടം. അടുത്ത ഔട്ട്പുട്ട് സൃഷ്ടിക്കുമ്പോൾ മുമ്പത്തെ ഔട്ട്പുട്ടും ഇത് പരിഗണിക്കുന്നു.

സ്വയം ശ്രദ്ധയും ഫീഡ്-ഫോർവേഡ് പാളികളും: സീക്വൻസിലെ വ്യത്യസ്ത വാക്കുകളും ഫീഡ്-ഫോർവേഡ് ലെയറും തമ്മിലുള്ള ബന്ധം കണക്കാക്കുന്ന നിർണായക സ്വയം ശ്രദ്ധാ പാളി എൻകോഡറിൽ ഉൾപ്പെടുന്നു. ഡീകോഡറിൽ ഒരു സ്വയം ശ്രദ്ധാ പാളി, ഫീഡ്-ഫോർവേഡ് ലെയർ, ഒരു അധിക എൻകോഡർ-ഡീകോഡർ ശ്രദ്ധാ പാളി എന്നിവ അടങ്ങിയിരിക്കുന്നു.

ട്രാൻസ്ഫോർമർ മോഡലിന്റെ ശക്തി അതിന്റെ ശ്രദ്ധയുടെ ഉപയോഗത്തിലാണ്, ഇത് മോഡലിനെ അതിന്റെ പ്രോസസ്സിംഗ് പദവുമായി അടുത്ത ബന്ധമുള്ള വാക്കുകളിൽ ശ്രദ്ധ കേന്ദ്രീകരിക്കാൻ അനുവദിക്കുന്നു. ഒരു വാക്യത്തിലെ പ്രധാനപ്പെട്ടതും അനുബന്ധവുമായ വാക്കുകൾ ശ്രദ്ധിക്കുന്നതിലൂടെ സന്ദർഭം നന്നായി മനസ്സിലാക്കാനും കൂടുതൽ പ്രസക്തമായ ഔട്ട്പുട്ടുകൾ സൃഷ്ടിക്കാനും മോഡലിന് കഴിയും.

ശ്രദ്ധാ സംവിധാനം ഉപയോഗിക്കുന്നതിന്റെ പ്രയോജനങ്ങൾ

ട്രാൻസ്ഫോർമർ ആർക്കിടെക്ചർ പോലുള്ള മെഷീൻ ലേണിംഗ് മോഡലുകളിൽ ശ്രദ്ധാ സംവിധാനം പ്രയോഗിക്കുന്നത് അവയുടെ മൊത്തത്തിലുള്ള പ്രകടനം വർദ്ധിപ്പിക്കുന്ന നിരവധി നേട്ടങ്ങൾ വഹിക്കുന്നു. ഇതാ ചില പ്രധാന ഗുണങ്ങൾ:

ദീർഘകാല ആശ്രിതത്വം പിടിച്ചെടുക്കൽ: ചില ഇൻപുട്ട് ഘടകങ്ങൾ സീക്വൻസ്-ടു-സീക്വൻസ് ജോലികളിൽ വിദൂര ഘടകങ്ങളെ ആശ്രയിച്ചിരിക്കും. “അപ്രത്യക്ഷമാകുന്ന ഗ്രേഡിയന്റ്” പ്രശ്നം കാരണം പരമ്പരാഗത ആവർത്തന ന്യൂറൽ നെറ്റ് വർക്കുകൾക്ക് അത്തരം ദീർഘകാല ആശ്രിതത്വങ്ങളുമായി പോരാടാൻ കഴിയും. ഇൻപുട്ട് സീക്വൻസിന്റെ പ്രസക്തമായ ഭാഗങ്ങളിൽ ശ്രദ്ധ കേന്ദ്രീകരിക്കാൻ മോഡലിനെ അനുവദിക്കുന്നതിലൂടെ ശ്രദ്ധാ സംവിധാനങ്ങൾക്ക് ഈ പ്രശ്നം ലഘൂകരിക്കാൻ കഴിയും, അവയുടെ സ്ഥാനം കണക്കിലെടുക്കാതെ, ഈ ദീർഘദൂര ആശ്രിതത്വങ്ങൾ മികച്ച രീതിയിൽ പിടിച്ചെടുക്കാൻ ഇത് പ്രാപ്തമാക്കുന്നു.

വ്യാഖ്യാനക്ഷമത: പ്രവചനങ്ങൾ നടത്തുമ്പോൾ വ്യത്യസ്ത ഇൻപുട്ടുകൾക്ക് മോഡൽ നൽകുന്ന ഭാരങ്ങൾ ദൃശ്യവൽക്കരിക്കാൻ ശ്രദ്ധാ സംവിധാനം ഞങ്ങളെ അനുവദിക്കുന്നു. മോഡലിന്റെ തീരുമാനമെടുക്കൽ പ്രക്രിയയെ വ്യാഖ്യാനിക്കാനുള്ള ഈ കഴിവ് മോഡൽ പ്രധാനപ്പെട്ടതോ പ്രസക്തമോ ആയി കണക്കാക്കുന്ന കാര്യങ്ങളെക്കുറിച്ച് ഉൾക്കാഴ്ച നൽകുന്നു, ഇത് ആരോഗ്യസംരക്ഷണം അല്ലെങ്കിൽ ധനകാര്യം പോലുള്ള ചില ഡൊമെയ്നുകളിൽ നിർണായകമാണ്.

കാര്യക്ഷമത: പരമ്പരാഗത സീക്വൻസ്-ടു-സീക്വൻസ് മോഡലുകൾക്ക് പലപ്പോഴും കാര്യമായ കമ്പ്യൂട്ടേഷണൽ വിഭവങ്ങൾ ആവശ്യമാണ്, കാരണം അവ തുടർച്ചയായി ഇൻപുട്ടുകൾ പ്രോസസ്സ് ചെയ്യുന്നു. മറുവശത്ത്, ശ്രദ്ധാ സംവിധാനം എല്ലാ ഇൻപുട്ടുകളും ഒരേസമയം പ്രോസസ്സ് ചെയ്യാൻ കഴിയുന്നതിനാൽ കംപ്യൂട്ടേഷനെ സമാന്തരമാക്കാൻ മോഡലിനെ അനുവദിക്കുന്നു, ഇത് കാര്യക്ഷമത നേട്ടങ്ങളിലേക്ക് നയിക്കുന്നു.

പ്രകടന മെച്ചപ്പെടുത്തൽ: അനുഭവപരമായി, ശ്രദ്ധാ സംവിധാനങ്ങളുള്ള മോഡലുകൾ പലപ്പോഴും ഇല്ലാത്തവയെക്കാൾ മികച്ചതാണ്. വ്യത്യസ്ത ഇൻപുട്ടുകളുടെ പ്രാധാന്യം തൂക്കിനോക്കാനുള്ള കഴിവ് കൂടുതൽ അറിവുള്ള തീരുമാനങ്ങൾ എടുക്കാൻ മോഡലിനെ അനുവദിക്കുന്നു, ഇത് കൂടുതൽ കൃത്യമായ പ്രവചനങ്ങളിലേക്ക് നയിക്കുന്നു. മെഷീൻ വിവർത്തനത്തിലും സ്പീച്ച് റെക്കഗ്നിഷൻ ജോലികളിലും ഇത് പ്രത്യേകിച്ചും പ്രകടമാണ്.

വേരിയബിൾ-ലെങ്ത് ഇൻപുട്ടും ഔട്ട്പുട്ടും കൈകാര്യം ചെയ്യുക: ഇൻപുട്ട്, ഔട്ട്പുട്ട് സീക്വൻസുകൾക്ക് വ്യത്യസ്ത ദൈർഘ്യമുള്ള ജോലികളിൽ ശ്രദ്ധാ സംവിധാനങ്ങൾ മികവ് പുലർത്തുന്നു. ഈ സവിശേഷത മെഷീൻ വിവർത്തനത്തിൽ പ്രത്യേകിച്ചും ഉപയോഗപ്രദമാണ്, അവിടെ ഉറവിടത്തിന്റെയും ടാർഗെറ്റ് വാചകങ്ങളുടെയും ദൈർഘ്യം വളരെയധികം വ്യത്യാസപ്പെടാം.

സന്ദർഭ-അവബോധം: ഔട്ട്പുട്ട് സീക്വൻസിന്റെ ഓരോ ഭാഗവും സൃഷ്ടിക്കുമ്പോൾ ഇൻപുട്ട് സീക്വൻസിന്റെ വിവിധ ഭാഗങ്ങളുടെ പ്രാധാന്യം തൂക്കിനോക്കുന്നതിലൂടെ, ഇൻപുട്ട് ഡാറ്റയുടെ വിശാലമായ സന്ദർഭം പരിഗണിക്കാൻ ശ്രദ്ധാ സംവിധാനങ്ങൾ മോഡലിനെ അനുവദിക്കുന്നു, ഇത് കൂടുതൽ സൂക്ഷ്മവും കൃത്യവുമായ പ്രവചനങ്ങളിലേക്ക് നയിക്കുന്നു.

എൻകോഡിംഗിലെ ഭാരം കുറയ്ക്കൽ: പരമ്പരാഗത എൻകോഡർ-ഡീകോഡർ ഘടനകളിൽ, എൻകോഡർ ഒരു നിശ്ചിത നീളമുള്ള വെക്ടറിലെ ഇൻപുട്ടിന്റെ മുഴുവൻ ഭാഗത്തെയും പ്രതിനിധീകരിക്കണം, തുടർന്ന് ഔട്ട്പുട്ട് സൃഷ്ടിക്കാൻ ഡീകോഡർ ഉപയോഗിക്കുന്നു. ദൈർഘ്യമേറിയ സീക്വൻസുകൾ കൈകാര്യം ചെയ്യുമ്പോൾ ഇത് ഒരു പ്രധാന പരിമിതിയാകാം. ഇൻപുട്ട് സീക്വൻസിലേക്ക് ‘തിരിഞ്ഞുനോക്കാൻ’ ഡീകോഡറിനെ അനുവദിക്കുന്നതിലൂടെ ശ്രദ്ധാ സംവിധാനം എൻകോഡറിലെ ഭാരം കുറയ്ക്കുന്നു, അതുവഴി പ്രാതിനിധ്യ ലോഡ് വ്യാപിപ്പിക്കുന്നു.

സീക്വൻസ് ഡാറ്റയിൽ നിന്ന് മനസ്സിലാക്കാനും പ്രോസസ്സ് ചെയ്യാനും പ്രവചിക്കാനും മോഡലിന്റെ കഴിവ് ശ്രദ്ധാ സംവിധാനം ഗണ്യമായി വർദ്ധിപ്പിക്കുന്നു, പ്രത്യേകിച്ചും നീണ്ടതും സങ്കീർണ്ണവുമായ സീക്വൻസുകൾ കൈകാര്യം ചെയ്യുമ്പോൾ. വ്യാഖ്യാനിക്കാനും പ്രകടനം വർദ്ധിപ്പിക്കാനും കമ്പ്യൂട്ടേഷണൽ വിഭവങ്ങൾ കാര്യക്ഷമമായി ഉപയോഗിക്കാനുമുള്ള അതിന്റെ കഴിവ് പല ആധുനിക മെഷീൻ ലേണിംഗ് ആർക്കിടെക്ചറുകളുടെയും മൂലക്കല്ലാക്കി മാറ്റി.

ശ്രദ്ധാ സംവിധാനത്തിന്റെ യഥാർത്ഥ ലോക ആപ്ലിക്കേഷനുകൾ

മെഷീൻ വിവർത്തനത്തിൽ ശ്രദ്ധാ സംവിധാനത്തിന്റെ ഉപയോഗം

ഔട്ട്പുട്ട് സീക്വൻസ് സൃഷ്ടിക്കുമ്പോൾ, ഡീകോഡർ എൻകോഡ് ചെയ്ത ഇൻപുട്ട് വെക്റ്ററും മുമ്പ് സൃഷ്ടിച്ച വാക്കുകളും പരിഗണിക്കുകയും ഇൻപുട്ട് സീക്വൻസിലെ ഓരോ വാക്കിനും ശ്രദ്ധ സ്കോർ കണക്കാക്കുകയും ചെയ്യുന്നു. നിലവിലെ ഔട്ട്പുട്ട് വാക്ക് സൃഷ്ടിക്കുമ്പോൾ ഓരോ ഇൻപുട്ട് വാക്കിനും എത്രമാത്രം ‘ശ്രദ്ധ’ നൽകണമെന്ന് ഈ ശ്രദ്ധ സ്കോറുകൾ നിർണ്ണയിക്കുന്നു.

പ്രായോഗികമായി പറഞ്ഞാൽ, ഒരു വാചകം വിവർത്തനം ചെയ്യുമ്പോൾ, മോഡൽ നിലവിൽ ഉറവിട വാചകത്തിലെ ഒരു നിർദ്ദിഷ്ട വാക്കുമായി നേരിട്ട് പൊരുത്തപ്പെടുന്ന ഒരു വാക്ക് സൃഷ്ടിക്കുകയാണെങ്കിൽ, വാചകത്തിലെ സ്ഥാനം കണക്കിലെടുക്കാതെ, ശ്രദ്ധാ സംവിധാനം ആ ഉറവിട പദത്തിൽ ശ്രദ്ധ കേന്ദ്രീകരിക്കാൻ മോഡലിനെ അനുവദിക്കുന്നു, അതിന്റെ ഫലമായി ഇനിപ്പറയുന്ന ആനുകൂല്യങ്ങൾ ലഭിക്കുന്നു:

മെച്ചപ്പെട്ട വിവർത്തന നിലവാരം: ഇൻപുട്ട് സീക്വൻസിലേക്ക് മടങ്ങാൻ മോഡലിനെ അനുവദിക്കുന്നതിലൂടെ, കൂടുതൽ കൃത്യവും ഒഴുക്കുള്ളതുമായ വിവർത്തനങ്ങൾ നിർമ്മിക്കാൻ ശ്രദ്ധാ സംവിധാനം സഹായിക്കുന്നു.

നീണ്ട വാചകങ്ങൾ കൈകാര്യം ചെയ്യൽ: ശ്രദ്ധാ സംവിധാനം നീണ്ട വാചകങ്ങളിലെ വിവര നഷ്ടത്തിന്റെ പ്രശ്നം ലഘൂകരിക്കുന്നു, ഇത് പരമ്പരാഗത സെക്ക് 2 സെക്ക് മോഡലുകളിൽ ശ്രദ്ധേയമായ പ്രശ്നമായിരുന്നു.

വിന്യാസ വിവരങ്ങൾ: ശ്രദ്ധ സ്കോറുകൾക്ക് ഉറവിടവും ടാർഗെറ്റ് വാക്യങ്ങളും തമ്മിലുള്ള വിന്യാസത്തെക്കുറിച്ച് ഉൾക്കാഴ്ച നൽകാൻ കഴിയും, ഓരോ ടാർഗെറ്റ് വാക്കും സൃഷ്ടിക്കുമ്പോൾ ഏത് ഉറവിട വാക്കുകൾ പ്രധാനമാണെന്ന് കാണിക്കുന്നു.

NLP ടാസ്കുകളിലെ പങ്ക്

ടെക്സ്റ്റ് സംഗ്രഹം, ചോദ്യോത്തരം, വികാര വിശകലനം മുതലായ നിരവധി എൻഎൽപി ജോലികളിൽ ശ്രദ്ധാ സംവിധാനങ്ങൾ ഒരു ഗെയിം ചേഞ്ചറാണ്. ഇതാ എങ്ങനെ:

ടെക്സ്റ്റ് സംഗ്രഹം: ഒരു ദൈർഘ്യമേറിയ ടെക്സ്റ്റ് ഡോക്യുമെന്റിന്റെ സംക്ഷിപ്തവും അർത്ഥവത്തായതുമായ സംഗ്രഹം സൃഷ്ടിക്കുന്ന പ്രക്രിയയാണ് ടെക്സ്റ്റ് സംഗ്രഹീകരണം. സംഗ്രഹത്തിൽ ഉൾപ്പെടുത്തേണ്ട ഇൻപുട്ട് ടെക്സ്റ്റിന്റെ ഏറ്റവും പ്രധാനപ്പെട്ട ഭാഗങ്ങൾ തിരിച്ചറിയുന്നതിൽ ശ്രദ്ധാ സംവിധാനം നിർണായക പങ്ക് വഹിക്കുന്നു. ടെക്സ്റ്റ് സംഗ്രഹത്തിന് പ്രയോഗിക്കുന്ന ഒരു സെക്ക് 2സെക്ക് മോഡലിൽ, സംഗ്രഹം സൃഷ്ടിക്കുമ്പോൾ യഥാർത്ഥ വാചകത്തിലേക്ക് (എൻകോഡ് ചെയ്ത അവസ്ഥയെ ആശ്രയിക്കുന്നതിന് പകരം) തിരിഞ്ഞുനോക്കാൻ ശ്രദ്ധാ സംവിധാനം മോഡലിനെ അനുവദിക്കുന്നു. സംഗ്രഹത്തിലെ ഓരോ വാക്കും ജനറേറ്റുചെയ്യുമ്പോൾ, ശ്രദ്ധാ സംവിധാനം ഉറവിട വാചകത്തിലെ ഓരോ വാക്കിനും ശ്രദ്ധ സ്കോറുകൾ കണക്കാക്കുന്നു. ഈ സ്കോറുകൾ അടിസ്ഥാനപരമായി സംഗ്രഹത്തിൽ സൃഷ്ടിക്കപ്പെടുന്ന പദത്തിന് ഓരോ ഉറവിട പദത്തിന്റെയും പ്രസക്തി അല്ലെങ്കിൽ സംഭാവനയെ സൂചിപ്പിക്കുന്നു. സംഗ്രഹ ജനറേഷന്റെ ഓരോ ഘട്ടത്തിലും യഥാർത്ഥ വാചകത്തിന്റെ ഏറ്റവും പ്രസക്തമായ ഭാഗങ്ങളിൽ ശ്രദ്ധ കേന്ദ്രീകരിക്കാൻ ഇത് മോഡലിനെ അനുവദിക്കുന്നു, അതുവഴി യഥാർത്ഥ വാചകത്തിൽ നിന്ന് ഏറ്റവും പ്രധാനപ്പെട്ട വിവരങ്ങൾ പിടിച്ചെടുക്കുന്ന സംഗ്രഹങ്ങൾ സൃഷ്ടിക്കുന്നു.

ചോദ്യോത്തരം: നൽകിയിരിക്കുന്ന വാചകത്തെക്കുറിച്ചുള്ള ചോദ്യങ്ങൾക്ക് ഉത്തരം നൽകാൻ മോഡൽ ആവശ്യപ്പെടുന്ന ഒരു എൻഎൽപി ടാസ്ക് ആണ് ചോദ്യോത്തരം (QA). ശ്രദ്ധാ സംവിധാനങ്ങൾ QA മോഡലുകളുടെ പ്രകടനം ഗണ്യമായി മെച്ചപ്പെടുത്തി. ഒരു ഉത്തരം സൃഷ്ടിക്കുമ്പോൾ വാചകത്തിന്റെ പ്രസക്തമായ ഭാഗങ്ങളിൽ ശ്രദ്ധ കേന്ദ്രീകരിക്കാൻ മോഡലിനെ അനുവദിക്കുന്നു. ഒരു ചോദ്യവും സന്ദർഭവും (ഉദാഹരണത്തിന്, ഉത്തരം അടങ്ങിയ ഒരു ഖണ്ഡിക) അവതരിപ്പിക്കുമ്പോൾ, മോഡൽ സന്ദർഭത്തിലെ ഓരോ വാക്കിന്റെയും ശ്രദ്ധ സ്കോറുകൾ കണക്കാക്കുന്നു. ഈ സ്കോറുകൾ ചോദ്യത്തിന് ഏറ്റവും പ്രസക്തമായ സന്ദർഭത്തിൽ വാക്കുകളെ ഉയർത്തിക്കാട്ടുന്നു. ഉത്തരം സൃഷ്ടിക്കാൻ മോഡൽ ഈ ഹൈലൈറ്റ് ചെയ്ത ഭാഗങ്ങൾ ഉപയോഗിക്കുന്നു, ഇത് ഉത്തരം ശരിയാകാനുള്ള സാധ്യത വർദ്ധിപ്പിക്കുന്നു.

മറ്റ് എൻ എൽ പി ജോലികൾ: മറ്റ് പല എൻ എൽ പി ജോലികളിലും, ഇൻപുട്ടിന്റെ പ്രധാന ഭാഗങ്ങളിൽ ശ്രദ്ധ കേന്ദ്രീകരിക്കാൻ ശ്രദ്ധാ സംവിധാനം മോഡലിനെ സഹായിക്കുന്നു:

നാമകരണം ചെയ്ത എന്റിറ്റി റെക്കഗ്നിഷൻ (എൻഇആർ): എൻഇആറിൽ, മോഡൽ ടെക്സ്റ്റിലെ ശരിയായ നാമങ്ങൾ തിരിച്ചറിയുന്നു (വ്യക്തികളുടെ പേരുകൾ, ഓർഗനൈസേഷൻ പേരുകൾ, ലൊക്കേഷനുകൾ എന്നിവ പോലെ). ഒരു വാക്കിന് ചുറ്റുമുള്ള സന്ദർഭത്തിൽ ശ്രദ്ധ കേന്ദ്രീകരിക്കാൻ മോഡലിനെ സഹായിക്കും, ഇത് വാക്കിനെ ശരിയായി തരംതിരിക്കാൻ സഹായിക്കുന്നു.

വികാര വിശകലനം: വികാര വിശകലനം പോലുള്ള ജോലികൾക്ക്, ഒരു വാചകത്തിന്റെ വികാരം പലപ്പോഴും കുറച്ച് കീവേഡുകളോ വാചകങ്ങളോ നിർണ്ണയിക്കുന്നു. വികാരം നിർണ്ണയിക്കുമ്പോൾ ഈ പ്രധാന ഭാഗങ്ങളിൽ ശ്രദ്ധ കേന്ദ്രീകരിക്കാൻ ശ്രദ്ധാ സംവിധാനം മോഡലിനെ സഹായിക്കും.

മറ്റ് പല എൻഎൽപി ജോലികളിലും, ഇൻപുട്ടിന്റെ പ്രധാന ഭാഗങ്ങളിൽ ശ്രദ്ധ കേന്ദ്രീകരിക്കാൻ ശ്രദ്ധാ സംവിധാനം മോഡലിനെ സഹായിക്കുന്നു:

പ്രോസസ്സിംഗിന്റെ ഓരോ ഘട്ടത്തിലും ഇൻപുട്ട് ഡാറ്റയുടെ ഏറ്റവും പ്രസക്തമായ ഭാഗങ്ങളിൽ ചലനാത്മകമായി ശ്രദ്ധ കേന്ദ്രീകരിക്കാൻ ശ്രദ്ധാ സംവിധാനം എൻഎൽപി മോഡലുകളെ അനുവദിക്കുന്നു, ഇത് നിരവധി സങ്കീർണ്ണമായ ജോലികളിൽ മെച്ചപ്പെട്ട പ്രകടനത്തിലേക്ക് നയിക്കുന്നു. ഇൻപുട്ടിന്റെ വിവിധ ഭാഗങ്ങൾക്ക് വ്യത്യസ്ത ഭാരങ്ങൾ നൽകുന്നതിലൂടെ, മറ്റ് മോഡലുകൾക്ക് നഷ്ടമായേക്കാവുന്ന ഡാറ്റയിലെ ആശ്രിതത്വം പിടിച്ചെടുക്കാൻ ശ്രദ്ധാ സംവിധാനങ്ങൾക്ക് കഴിയും.

കമ്പ്യൂട്ടർ കാഴ്ചയിൽ ശ്രദ്ധാ സംവിധാനത്തിന്റെ പ്രയോഗങ്ങൾ

സ്വാഭാവിക ഭാഷാ പ്രോസസ്സിംഗിൽ വളരെയധികം വിജയം കണ്ട ശ്രദ്ധാ സംവിധാനം കമ്പ്യൂട്ടർ കാഴ്ചയിലും മികച്ച ഫലങ്ങളോടെ പ്രയോഗിച്ചു. കമ്പ്യൂട്ടർ വിഷനിൽ, ഇമേജ് ക്ലാസിഫിക്കേഷൻ, ഒബ്ജക്റ്റ് ഡിറ്റക്ഷൻ അല്ലെങ്കിൽ സെമാന്റിക് സെഗ്മെന്റേഷൻ പോലുള്ള ജോലികൾ ചെയ്യുമ്പോൾ ഇമേജിലെ ചില പ്രദേശങ്ങളിലേക്ക് ഒരു മോഡലിന്റെ ഫോക്കസ് നയിക്കാൻ ഇത് ഉപയോഗിക്കാം.

കമ്പ്യൂട്ടർ കാഴ്ചയിൽ ശ്രദ്ധാ സംവിധാനം എങ്ങനെ പ്രവർത്തിക്കുന്നു:

സ്പേഷ്യൽ ശ്രദ്ധ: സ്പേഷ്യൽ ശ്രദ്ധയിൽ, മോഡൽ ചിത്രത്തിന്റെ നിർദ്ദിഷ്ട പ്രദേശങ്ങളിൽ ശ്രദ്ധ കേന്ദ്രീകരിക്കാൻ പഠിക്കുന്നു. ചിത്രത്തിൽ ഓരോ പ്രദേശത്തിനും ഒരു ശ്രദ്ധ സ്കോർ കണക്കാക്കുന്നു, സാധാരണയായി ആ പ്രദേശത്ത് നിന്ന് വേർതിരിച്ചെടുത്ത സവിശേഷതകളെ അടിസ്ഥാനമാക്കി. ഓരോ പ്രദേശത്തിനും എത്രമാത്രം ‘ശ്രദ്ധ’ ലഭിക്കണമെന്ന് ഈ സ്കോറുകൾ നിർണ്ണയിക്കുന്നു. മോഡലിന്റെ അടുത്ത പാളിയിലേക്ക് കൈമാറുന്നതിനുമുമ്പ് ഓരോ പ്രദേശത്തു നിന്നുമുള്ള സവിശേഷതകൾ അവയുടെ ശ്രദ്ധ സ്കോറുകൾ അനുസരിച്ച് ഭാരം വയ്ക്കുന്നു. കൈയിലുള്ള ദൗത്യത്തിന് കൂടുതൽ പ്രസക്തമായ പ്രദേശങ്ങളിൽ കൂടുതൽ ശ്രദ്ധ കേന്ദ്രീകരിക്കാൻ ഇത് മോഡലിനെ അനുവദിക്കുന്നു.

ചാനൽ ശ്രദ്ധ: ചാനൽ ശ്രദ്ധ കൂടുതൽ വിജ്ഞാനപ്രദമായ ഫീച്ചർ ചാനലുകൾ തിരഞ്ഞെടുക്കുന്നതിൽ ശ്രദ്ധ കേന്ദ്രീകരിക്കുന്നു. ഫീച്ചർ മാപ്പിന്റെ ഓരോ ചാനലിനും, ഒരു ശ്രദ്ധാ സ്കോർ കണക്കാക്കുന്നു, ഇത് ആ ചാനലിന്റെ പ്രാധാന്യം അളക്കുന്നു. ചാനലുകൾ അവയുടെ ശ്രദ്ധ സ്കോറുകൾക്കനുസരിച്ച് ഭാരം വയ്ക്കുന്നു, ഇത് കൈയിലുള്ള ജോലിക്ക് ഏറ്റവും പ്രസക്തമായ ചാനലുകളിൽ കൂടുതൽ ശ്രദ്ധ കേന്ദ്രീകരിക്കാൻ മോഡലിനെ അനുവദിക്കുന്നു.

കമ്പ്യൂട്ടർ കാഴ്ചയിലെ സ്വയം ശ്രദ്ധ: നോൺ-ലോക്കൽ ഓപ്പറേഷൻ എന്നും അറിയപ്പെടുന്ന സ്വയം ശ്രദ്ധ, ഒരു ചിത്രത്തിലെ ഒരു സ്ഥാനത്തെ പ്രതികരണത്തെ ഇമേജിലെ എല്ലാ സ്ഥാനങ്ങളിലെയും സവിശേഷതകളുടെ ഭാരിച്ച തുകയായി കണക്കാക്കുന്നു. പരമ്പരാഗത ആശയവിനിമയ പ്രവർത്തനങ്ങൾ നൽകുന്ന പ്രാദേശിക സന്ദർഭത്തേക്കാൾ ആഗോള സന്ദർഭം പരിഗണിക്കാൻ ഇത് മോഡലിനെ അനുവദിക്കുന്നു.

കമ്പ്യൂട്ടർ കാഴ്ചയിൽ ശ്രദ്ധാ സംവിധാനത്തിന്റെ പ്രയോഗങ്ങൾ:

ഒബ്ജക്റ്റ് കണ്ടെത്തലും സെഗ്മെന്റേഷനും: ഒബ്ജക്റ്റ് കണ്ടെത്തൽ, സെഗ്മെന്റേഷൻ തുടങ്ങിയ ജോലികളിൽ, പശ്ചാത്തലമോ അപ്രസക്തമായ വസ്തുക്കളോ അവഗണിച്ചുകൊണ്ട് താൽപ്പര്യമുള്ള വസ്തുക്കൾ അടങ്ങിയ പ്രദേശങ്ങളിൽ ശ്രദ്ധ കേന്ദ്രീകരിക്കാൻ സ്പേഷ്യൽ ശ്രദ്ധ മോഡലിനെ സഹായിക്കും.

ഇമേജ് അടിക്കുറിപ്പ്: ഇമേജ് ക്യാപ്ഷനിംഗിൽ, ഒരു ചിത്രത്തിന്റെ വാചക വിവരണം സൃഷ്ടിക്കുക എന്നതാണ് ജോലി, ക്യാപ്ഷൻ ജനറേഷന്റെ ഓരോ ഘട്ടത്തിലും ചിത്രത്തിന്റെ വ്യത്യസ്ത പ്രദേശങ്ങളിൽ ശ്രദ്ധ കേന്ദ്രീകരിക്കാൻ ശ്രദ്ധാ സംവിധാനം മോഡലിനെ സഹായിക്കും. കൂടുതൽ കൃത്യവും വിശദവുമായ അടിക്കുറിപ്പുകൾ സൃഷ്ടിക്കാൻ ഇത് മോഡലിനെ അനുവദിക്കുന്നു.

വിഷ്വൽ ചോദ്യ ഉത്തരം: വിഷ്വൽ ചോദ്യ ഉത്തരത്തിൽ, മോഡലിന് ഒരു ചിത്രവും ചിത്രത്തെക്കുറിച്ചുള്ള ഒരു ചോദ്യവും (ഉദാഹരണത്തിന്, “ചിത്രത്തിൽ പൂച്ചയുടെ നിറം എന്താണ്?”), ഉത്തരം ജനറേറ്റുചെയ്യുമ്പോൾ ചിത്രത്തിന്റെ പ്രസക്തമായ ഭാഗങ്ങളിൽ ശ്രദ്ധ കേന്ദ്രീകരിക്കാൻ ശ്രദ്ധാ സംവിധാനം മോഡലിനെ സഹായിക്കും.

കാഴ്ചയിൽ ട്രാൻസ്ഫോർമറുകൾ: എൻഎൽപിയിലെ ട്രാൻസ്ഫോർമറുകളുടെ വിജയത്തിൽ നിന്ന് പ്രചോദനം ഉൾക്കൊണ്ട്, ഗവേഷകർ കമ്പ്യൂട്ടർ വിഷൻ ജോലികളിൽ ട്രാൻസ്ഫോർമറുകളും പ്രയോഗിച്ചു. ഉദാഹരണത്തിന്, വിഷൻ ട്രാൻസ്ഫോർമർ (വിഐടി) ഒരു ഇമേജിനെ പാച്ചുകളുടെ ഒരു സീക്വൻസായി പരിഗണിക്കുകയും എൻഎൽപിയിലെ ടോക്കണുകളുടെ ഒരു സീക്വൻസ് ഉപയോഗിച്ച് ഒരു ട്രാൻസ്ഫോർമർ എങ്ങനെ പ്രവർത്തിക്കുന്നു എന്നതുപോലെ സ്വയം ശ്രദ്ധയും സ്ഥാനം ഉൾപ്പെടുത്തലും പ്രയോഗിക്കുകയും ചെയ്യുന്നു.

ശ്രദ്ധാ സംവിധാനം കമ്പ്യൂട്ടർ വിഷൻ മോഡലുകളെ അവരുടെ കമ്പ്യൂട്ടേഷണൽ വിഭവങ്ങൾ ചലനാത്മകമായി അനുവദിക്കാൻ അനുവദിക്കുന്നു, ഇമേജിന്റെയോ ഫീച്ചർ മാപ്പിന്റെയോ പ്രധാന ഭാഗങ്ങളിൽ കൂടുതൽ ശ്രദ്ധ കേന്ദ്രീകരിക്കുകയും പ്രസക്തി കുറഞ്ഞ ഭാഗങ്ങളിൽ കുറവ് ശ്രദ്ധ കേന്ദ്രീകരിക്കുകയും ചെയ്യുന്നു. ഇത് പലതരം സങ്കീർണ്ണമായ ജോലികളിൽ മെച്ചപ്പെട്ട പ്രകടനത്തിലേക്ക് നയിച്ചേക്കാം.

Endnote

പരമ്പരാഗത എൻകോഡർ-ഡീകോഡർ സീക്വൻസ് മോഡലുകൾ പലപ്പോഴും ഒരു വിവര തടസ്സവുമായി പൊരുത്തപ്പെടുന്നു. എൻകോഡറിൽ നിന്ന് ഡീകോഡർ ഘട്ടങ്ങളിലേക്ക് വിവരങ്ങൾ കൈമാറുമ്പോൾ ഈ പ്രശ്നം ഉണ്ടാകുന്നു. ശ്രദ്ധാ സംവിധാനം ഈ ദുരവസ്ഥയ്ക്ക് ഒരു തന്ത്രപരമായ പരിഹാരമായി വർത്തിക്കുന്നു, ഔട്ട്പുട്ട് സീക്വൻസിന്റെ ഓരോ ഘടകവും സൃഷ്ടിക്കുമ്പോൾ ഇൻപുട്ട് സീക്വൻസിന്റെ മുഴുവൻ ഭാഗത്തിലൂടെയും നാവിഗേറ്റ് ചെയ്യാൻ ഡീകോഡറിനെ അനുവദിക്കുന്നു.

ഓരോ എൻകോഡറും ഡീകോഡർ മറഞ്ഞിരിക്കുന്ന അവസ്ഥയുമായി ബന്ധപ്പെട്ട പ്രസക്തി സ്കോർ കണക്കാക്കാൻ രൂപകൽപ്പന ചെയ്ത ഒരു കോംപാക്റ്റ് ശ്രദ്ധാ മോഡൽ സംയോജിപ്പിച്ചാണ് ഇത് കൈവരിക്കുന്നത്. ഈ പ്രസക്തി സ്കോറുകൾ പ്രയോജനപ്പെടുത്തി, എൻകോഡർ മറഞ്ഞിരിക്കുന്ന അവസ്ഥകളുടെ സവിശേഷമായ ഭാരമുള്ള സംയോജനം ഡീകോഡിംഗ് പ്രക്രിയയുടെ ഓരോ ഘട്ടത്തിനും സന്ദർഭമായി നിർമ്മിക്കാൻ കഴിയും.

ശ്രദ്ധാ സംവിധാനത്തിന്റെ വരവ് എൻ എൽ പി മോഡൽ സൃഷ്ടിയുടെ ലാൻഡ്സ്കേപ്പിനെ നിസ്സംശയമായും മാറ്റിമറിച്ചു. അതിന്റെ ആപ്ലിക്കേഷൻ അത്യാധുനിക എൻഎൽപി മോഡലുകളുടെ ഒരു സ്റ്റാൻഡേർഡ് ഘടകമായി മാറി. ഇൻപുട്ടിലെ എല്ലാ വാക്കുകളും “ഓർമ്മിക്കാനും” ഒരു പ്രതികരണം രചിക്കുമ്പോൾ നിർദ്ദിഷ്ട വാക്കുകളിൽ ശ്രദ്ധ കേന്ദ്രീകരിക്കാനുമുള്ള കഴിവാണ് ഇതിന് കാരണം, അതുവഴി മോഡലിന്റെ ഫലപ്രാപ്തിയും കൃത്യതയും വളരെയധികം വർദ്ധിപ്പിക്കുന്നു.

നിങ്ങളുടെ ബിസിനസ്സിനായി ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസിന്റെ ശക്തി ഉപയോഗപ്പെടുത്താൻ തയ്യാറാണോ? നിങ്ങളുടെ ആവശ്യങ്ങൾക്ക് അനുയോജ്യമായ സ്മാർട്ട് ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസ് പരിഹാരങ്ങൾക്കായി ലീവേഹെർട്സിന്റെ ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസ് വിദഗ്ധരെ ഇന്ന് ബന്ധപ്പെടുക!

Experienced Researcher with a demonstrated history of working in the Deep Learning, Computer Vision