ന്യൂറൽ നെറ്റ് വർക്കുകളുടെയും ഡീപ് ലേണിംഗ് ന്റെയും ചരിത്രം

സാങ്കേതിക പരിണാമത്തിന്റെ ചരിത്രത്തിൽ, ജീവജാലങ്ങളുടെ ജൈവ ഘടനയിലും പ്രവർത്തനത്തിലും നിന്ന് പ്രചോദനം ഉൾക്കൊണ്ട നിരവധി കണ്ടുപിടുത്തങ്ങളും സേവനങ്ങളും ഉണ്ടായിട്ടുണ്ട്. ബുള്ളറ്റ് ട്രെയിനുകൾ മുതൽ കൃത്രിമ അവയവങ്ങൾ വരെ, കൃത്രിമ പ്രകാശസംശ്ലേഷണം മുതൽ സ്ട്രക്ചറൽ എഞ്ചിനീയറിംഗ് വരെ നിരവധി പുതുമകൾ വരെ പ്രകൃതി പ്രചോദനത്തിന്റെ സമ്പന്നമായ ഉറവിടമാണ്.

എന്നാൽ തലച്ചോറിന്റെ പ്രവർത്തനത്തെ അനുകരിക്കാൻ കഴിഞ്ഞാലോ?

മനുഷ്യ പരിണാമത്തിന്റെ സഹസ്രാബ്ദങ്ങൾ ഉണ്ടായിരുന്നിട്ടും, തലച്ചോറിന്റെ പ്രവർത്തനത്തിന്റെയും കഴിവുകളുടെയും 10-20% മാത്രമേ നമുക്ക് ഇപ്പോഴും മനസ്സിലാകൂ. മസ്തിഷ്കം ഒരു നിഗൂഢ അത്ഭുതമായി തുടരുന്നു!

ഇപ്പോൾ, തലച്ചോറിന്റെ പ്രവർത്തനത്തെക്കുറിച്ചും മെഷീൻ ലേണിംഗ് മേഖലയുമായുള്ള അതിന്റെ ബന്ധത്തെക്കുറിച്ചും നമുക്ക് പരിശോധിക്കാം.

ന്യൂറൽ നെറ്റ് വർക്കുകളുടെ ജനനം:

1957-ൽ റോസെൻബ്ലാറ്റ് എന്ന ഗണിതശാസ്ത്രജ്ഞൻ ആദ്യത്തെയും ലളിതവുമായ ന്യൂറൽ നെറ്റ് വർക്ക് മോഡലായ “പെർസെപ്റ്റോൺ” സൃഷ്ടിച്ചുകൊണ്ട് ഈ മേഖലയ്ക്ക് ശ്രദ്ധേയമായ സംഭാവന നൽകി. കുറഞ്ഞ മാറ്റങ്ങളോടെ ലോജിസ്റ്റിക് പിന്നോക്കാവസ്ഥയ്ക്ക് സമാനമായ പെർസെപ്റ്റോൺ ഒരു പുതിയ യുഗത്തിന്റെ തുടക്കം കുറിച്ചു.

ന്യൂറോണുകളെ മനസ്സിലാക്കുക:

ഒരു അടിസ്ഥാന മസ്തിഷ്ക കോശമായ ഒരു ന്യൂറോൺ വിവരങ്ങൾ പ്രോസസ്സ് ചെയ്യുന്നതിനും കൈമാറുന്നതിനും ഉത്തരവാദിയാണ്. മറ്റ് ന്യൂറോണുകളുമായി ബന്ധിപ്പിക്കുന്ന ഡെൻഡ്രൈറ്റുകൾ, സിഗ്നൽ ട്രാൻസ്മിഷനുള്ള ആക്സോണുകൾ, ഔട്ട്പുട്ടുകൾ ഉൽപാദിപ്പിക്കുന്ന ഇലക്ട്രോകെമിക്കൽ സിഗ്നലുകൾ ഉത്തേജിപ്പിക്കുന്നതിന് ഉത്തരവാദിയായ സെൽ ബോഡിയായ സോമ എന്നിവ ഇതിൽ ഉൾപ്പെടുന്നു. ന്യൂറോണുകൾ ഒറ്റപ്പെട്ട് പ്രവർത്തിക്കുന്നില്ല; അവ പരസ്പരം ബന്ധിപ്പിക്കുകയും ഒന്നിൽ നിന്ന് മറ്റൊന്നിലേക്ക് വിവരങ്ങൾ കൈമാറുകയും ചെയ്യുന്നു.

വ്യക്തിപരമായി ഒരിക്കലും അനുഭവിച്ചിട്ടില്ലാത്ത സാഹചര്യങ്ങളോട് നമ്മൾ എങ്ങനെ പ്രതികരിക്കുന്നുവെന്ന് നിങ്ങൾ എപ്പോഴെങ്കിലും ചിന്തിച്ചിട്ടുണ്ടോ?

തീയോ മൂർച്ചയുള്ള വസ്തുക്കളോ ഒഴിവാക്കുന്നത് പോലുള്ള ചില പ്രതികരണങ്ങൾ മറ്റുള്ളവരുടെ അനുഭവങ്ങളിൽ നിന്ന് പഠിക്കുന്നു, നമ്മുടെ തലച്ചോർ ഈ അറിവ് നമുക്കായി സംഭരിക്കുന്നു.

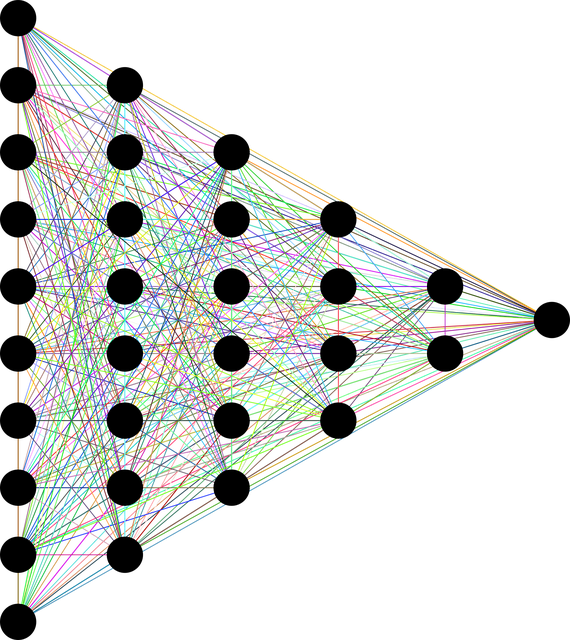

ന്യൂറൽ കണക്ഷനുകൾ എത്രത്തോളം സങ്കീർണ്ണമായിരിക്കാമെന്നതിന്റെ പ്രാതിനിധ്യം.

സങ്കീർണ്ണമായ ന്യൂറൽ കണക്ഷനുകൾ:

തലച്ചോറിന്റെ ശൃംഖലയുടെ ഘടനാപരമായ പ്രവർത്തനം അനുകരിക്കാൻ ഒരു മാർഗമുണ്ടോ?

1980-കളിൽ ആളുകൾ ഉത്തരങ്ങൾ കണ്ടെത്താൻ തുടങ്ങി. എന്നിരുന്നാലും, 1960 കൾ മുതൽ അവർ വെല്ലുവിളികൾ നേരിട്ടു. ബാക്ക് പ്രൊപ്പഗേഷൻ എന്നറിയപ്പെടുന്ന മെഷീൻ ലേണിംഗിലെ ഏറ്റവും പ്രധാനപ്പെട്ട മുന്നേറ്റങ്ങളിലൊന്ന് 1986 ൽ ജെഫ്രി ഹിന്റണും ഒരു കൂട്ടം ഗണിതശാസ്ത്രജ്ഞരും നിർദ്ദേശിച്ചു. ഗണിതശാസ്ത്രപരമായ ഉൾക്കാഴ്ചകളുള്ള വ്യത്യാസത്തിന്റെ “ചെയിൻ റൂൾ” ആയി ബാക്ക് പ്രൊപ്പഗേഷനെ കണക്കാക്കാം.

എന്നിരുന്നാലും, അക്കാലത്ത് കമ്പ്യൂട്ടേഷണൽ പവർ പരിമിതമായിരുന്നു, കൂടാതെ സപ്പോർട്ട് വെക്റ്റർ മെഷീനുകൾ (എസ്വിഎം) പോലുള്ള ഇതര അൽഗോരിതങ്ങൾ ശ്രദ്ധ നേടി. രണ്ട് ദശാബ്ദങ്ങൾക്ക് ശേഷം, ജെഫ്രി ഹിന്റൺ ഡീപ് ന്യൂറൽ നെറ്റ്വർക്കുകളെക്കുറിച്ചുള്ള ഒരു പ്രധാന പ്രബന്ധവുമായി തിരിച്ചെത്തി, ഇപ്പോൾ ഡീപ് ലേണിംഗ് എന്നറിയപ്പെടുന്നു, ഇത് വിവിധ അനുബന്ധ ആശയങ്ങളിലേക്ക് നയിക്കുന്നു. ഇമേജ് കണ്ടെത്തലിന്റെ പ്രശ്നത്തിന് മിക്ക അൽഗോരിതങ്ങളും 2010 വരെ ഉയർന്ന കൃത്യത നൽകുന്നതിൽ പരാജയപ്പെട്ടു.

ഡീപ് ലേണിംഗ് ന്റെ ഉയർച്ച:

ഇമേജ് കണ്ടെത്തലിനായി, മിക്ക അൽഗോരിതങ്ങളും 2010 വരെ ഉയർന്ന കൃത്യത കൈവരിക്കാൻ പാടുപെട്ടു. 2012 ൽ ഇമേജ് ക്ലാസിഫിക്കേഷനായി ഇമേജ്നെറ്റ് മത്സരം ഒരു വഴിത്തിരിവായി. വിപുലമായ ഡാറ്റാസെറ്റുകളും നൂതന കമ്പ്യൂട്ടേഷണൽ വിഭവങ്ങളും ഉപയോഗിച്ച് ഒരു ടീം ഡീപ് ന്യൂറൽ നെറ്റ് വർക്കുകൾ ഉപയോഗിച്ചു, ശ്രദ്ധേയമായ ഫലങ്ങൾ നേടി. ഈ വിജയം ഡീപ് ലേണിംഗ് ശ്രദ്ധാകേന്ദ്രമാക്കി. ആമസോൺ, മൈക്രോസോഫ്റ്റ്, ബെയ്ഡു, ഗൂഗിൾ, ഫേസ്ബുക്ക് (ഇപ്പോൾ മെറ്റ) തുടങ്ങിയ വലിയ ഇന്റർനെറ്റ് കമ്പനികൾ ഡാറ്റ, കമ്പ്യൂട്ടേഷണൽ റിസോഴ്സുകൾ, ടാലന്റ് എന്നിവയിൽ നിക്ഷേപം നടത്തി, ഇത് പുതിയതും നൂതനവുമായ അൽഗോരിതങ്ങളുടെ വികസനത്തിലേക്ക് നയിച്ചു.

ഡീപ് ലേണിംഗ് ന്റെ പ്രയോഗങ്ങൾ:

അതിനുശേഷം, ഡീപ് ലേണിംഗ് വിവിധ ഡൊമെയ്നുകളിൽ നടപ്പിലാക്കി:

സിരി, അലെക്സ, ഗൂഗിൾ അസിസ്റ്റന്റ് തുടങ്ങിയ വോയ്സ് അസിസ്റ്റന്റുമാർ.

ടെസ്ല, ഗൂഗിളിന്റെ വേമോ തുടങ്ങിയ കമ്പനികളിൽ നിന്നുള്ള സെൽഫ് ഡ്രൈവിംഗ് കാറുകൾ.

മൊബൈൽ ക്യാമറകൾ ഉപയോഗിച്ച് ചർമ്മ-കാൻസർ രോഗനിർണയത്തിനുള്ള മൊബൈൽ ആപ്ലിക്കേഷനുകൾ, എല്ലാം ഡീപ് ലേണിംഗ് ഉപയോഗിച്ച് പ്രവർത്തിക്കുന്നു.

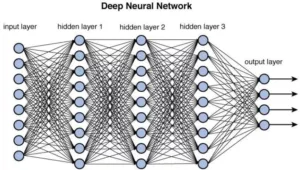

Artificial Neural Network (ANN):

പ്രാരംഭ ആർട്ടിഫിഷ്യൽ ന്യൂറൽ നെറ്റ് വർക്ക് ചുവടെയുള്ള ഘടന പോലെ കാണപ്പെടുന്നു

ANN പ്രാരംഭ പ്രാതിനിധ്യം.

ഒരു ആർട്ടിഫിഷ്യൽ ന്യൂറൽ നെറ്റ് വർക്കിന്റെ പ്രാരംഭ പ്രാതിനിധ്യത്തിൽ ഒന്നിലധികം പാളികൾ ഉൾപ്പെടുന്നു, അവിടെ ഇൻപുട്ടുകൾക്ക് ആപേക്ഷിക ഭാരങ്ങൾ നൽകുന്നു. ഈ ഇൻപുട്ടുകൾ സംയോജിപ്പിക്കുകയും സംഗ്രഹിക്കുകയും സജീവമാക്കൽ പ്രവർത്തനത്തിന് വിധേയമാക്കുകയും ചെയ്യുന്നു. ഈ ഔട്ട്പുട്ട് മറ്റ് ന്യൂറോണുകൾക്ക് ഇൻപുട്ടായി പ്രവർത്തിക്കും.

Sum = W1X1 + W2X2 + ……. + WnXn

ഫംഗ്ഷൻ = F(W1X1 + W2X2 + ……. + WnXn)

ഈ വാസ്തുവിദ്യ ജീവശാസ്ത്രത്തിൽ നിന്ന് പ്രചോദനം ഉൾക്കൊണ്ടതാണ്, പക്ഷേ കൃത്യമായ പകർപ്പല്ല. യഥാർത്ഥത്തിൽ സിഎൻഎന്നുകൾ 1990 കളുടെ ആരംഭം മുതലുള്ളതാണ്.

2 ലേയേർഡ് ന്യൂറൽ കണക്ഷൻ.

ബയോളജിക്കൽ ന്യൂറോണുകൾ:

ന്യൂറോണും അതിന്റെ ഭാഗങ്ങളും പ്രതിനിധീകരിക്കുന്നു.

ഗ്രാഫ് സിദ്ധാന്തത്തിന്റെ വീക്ഷണകോണിൽ നിന്ന് അവ പുറത്തുപോകുന്ന അരികുകളോ വെർട്ടീസുകളോ ആണ്, ജീവശാസ്ത്രത്തിൽ അവ “ആക്സോണുകൾ” ആണ്.

ഇവിടെ ഓരോ ഡെൻഡ്രൈറ്റും സമാനമാകണമെന്നില്ല, അവയിൽ ചിലത് കട്ടിയുള്ളതും ചിലത് നേർത്തതുമാണ്, ഓരോന്നിനും അവരുടേതായ പ്രാധാന്യവും വിവരങ്ങളും ഉണ്ട്.

സിംഗിൾ ലെയർ ഇൻപുട്ടുകളും അനുബന്ധ ഔട്ട്പുട്ടും.

ബയോളജിക്കൽ ന്യൂറോണുകൾ, ഒരു ഗ്രാഫ് സിദ്ധാന്ത വീക്ഷണകോണിൽ നിന്ന്, പുറത്തുപോകുന്ന അരികുകൾ അല്ലെങ്കിൽ വെർട്ടീസുകളാണ്. ജീവശാസ്ത്രത്തിൽ ഇവയെ “ആക്സോണുകൾ” എന്ന് വിളിക്കുന്നു. എല്ലാ ഡെൻഡ്രൈറ്റുകളും ഒരുപോലെയല്ല; ചിലത് കട്ടിയുള്ളതാണ്, ചിലത് നേർത്തതാണ്, ഓരോന്നിനും സവിശേഷമായ വിവരങ്ങൾ ഉണ്ട്.

സിഗ്നലുകളുടെ പ്രാധാന്യത്തെ ആശ്രയിച്ച് ഓരോ ഡെൻഡ്രൈറ്റിനും നൽകിയ ഭാരം വ്യത്യാസപ്പെടുന്നു. ഭാരം കൂടുന്തോറും ഡെൻഡ്രൈറ്റിന്റെ കട്ടി കൂടുന്തോറും വിവരങ്ങൾ കൂടുതൽ നിർണ്ണായകമാകും.

മതിയായ സിഗ്നൽ ഇൻപുട്ട് ലഭിക്കുമ്പോൾ ന്യൂറോണുകൾ സജീവമാക്കുകയോ പ്രേരിപ്പിക്കുകയോ ചെയ്യുന്നു, ഇത് ഔട്ട്പുട്ട് പുറത്തുവിടുന്നു.

Opt = f (ΣWiXi) for i = 1 to n.

ന്യൂറൽ നെറ്റ് വർക്കുകളുടെ രൂപീകരണം:

ന്യൂറോണുകളുടെ ഇടപെടലുകളാണ് ന്യൂറൽ നെറ്റ് വർക്കുകൾ. ജനനസമയത്ത്, ന്യൂറൽ നെറ്റ് വർക്കുകൾ വിരളമാണ്, പക്ഷേ കുട്ടിക്കാലത്ത്, ഭാഷ, സംസാരം, ഒബ്ജക്റ്റ് ഐഡന്റിഫിക്കേഷൻ എന്നിവ പഠിക്കുമ്പോൾ കണക്ഷനുകൾ വർദ്ധിക്കുന്നു. ഈ ഘട്ടത്തിൽ തലച്ചോറിന്റെ ഊർജ്ജ ഉപഭോഗം ഗണ്യമാണ്, കണക്ഷനുകൾക്ക് ആവശ്യമായ ഇലക്ട്രോകെമിക്കൽ പ്രതിപ്രവർത്തനങ്ങൾ നിലനിർത്തുന്നു.

പ്രായമാകുന്തോറും, ന്യൂറൽ കണക്ഷനുകൾ ക്ഷയിക്കാൻ തുടങ്ങുന്നു, ഇത് വസ്തുക്കളെയും ആളുകളെയും തിരിച്ചറിയുന്നതിൽ ബുദ്ധിമുട്ട്, ആശയവിനിമയ പ്രശ്നങ്ങൾ, കേൾവിയും കാഴ്ചയും ദുർബലമാകൽ തുടങ്ങിയ പ്രശ്നങ്ങളിലേക്ക് നയിക്കുന്നു.

ശരീരത്തിലെ മറ്റേതൊരു കോശങ്ങളെയും പോലെ, നിർജ്ജീവ മസ്തിഷ്ക കോശങ്ങൾ അറിവും ചിന്താശേഷിയും നഷ്ടപ്പെടുന്നതിലേക്ക് നയിക്കുന്നു.

ന്യൂറൽ നെറ്റ് വർക്കുകളുടെ ബയോളജിക്കൽ ബിൽഡിംഗ്:

ബയോളജിക്കൽ പ്രചോദിത അൽഗോരിതങ്ങൾ ഡാറ്റ ഉപയോഗിച്ചാലുടൻ പുതിയ കണക്ഷനുകൾ രൂപീകരിക്കാൻ രൂപകൽപ്പന ചെയ്തിരിക്കുന്നു. രസകരമെന്നു പറയട്ടെ, ഈ കണക്ഷനുകൾ യാദൃശ്ചികമല്ല, മറിച്ച് ഉപഭോഗ ഡാറ്റയാൽ സ്വാധീനിക്കപ്പെടുന്നു.

ബാല്യകാലം മുതൽ 6 വയസ്സ് വരെ നാം വസ്തുക്കളുടെ ഭാഷ, സംസാരം, തിരിച്ചറിയൽ എന്നിവ പഠിക്കാൻ പ്രവണത കാണിക്കുന്നു, ഈ ഘട്ടത്തിൽ ഞങ്ങൾക്ക് ഉയർന്ന കണക്ഷൻ നിരക്ക് ഉണ്ട്. കൂടുതൽ കണക്ഷനുകൾക്കായി, അരികുകളുമായി ബന്ധിപ്പിക്കുന്നതിന് ഇലക്ട്രോ കെമിക്കൽ പ്രതിപ്രവർത്തനം നിലനിർത്താൻ നമുക്ക് ധാരാളം ഊർജ്ജവും കലോറിയും ആവശ്യമാണ്.

6 വയസ്സ് വരെ കുട്ടികൾ വിഷ്വൽ, ഓഡിയോ, സെൻസറി ഇൻപുട്ടുകൾ മുതലായ ധാരാളം ഡാറ്റ ഉപയോഗിക്കുന്നു…

ജീവിതത്തിന്റെ വിവിധ പ്രായങ്ങളിലെ ന്യൂറൽ കണക്ഷനുകൾ

പ്രായമാകുന്തോറും, വാർദ്ധക്യ പ്രക്രിയ ബാധിക്കുമ്പോൾ, നമുക്ക് ന്യൂറൽ കണക്ഷനുകളുടെ അപചയം ഉണ്ടാകും. കാരണം, വാർദ്ധക്യ പ്രക്രിയയിലൂടെ നമ്മുടെ ശരീരം ദുർബലമാവുകയും ചില ബന്ധങ്ങൾ നഷ്ടപ്പെടുകയും ചെയ്യും, തൽഫലമായി വാർദ്ധക്യത്തിൽ ധാരാളം ആളുകൾ വസ്തുക്കളെയും ആളുകളെയും തിരിച്ചറിയുന്നത് നിർത്തുകയും വ്യക്തമായി ആശയവിനിമയം നടത്താൻ പോലും കഴിയാത്ത പ്രശ്നങ്ങൾ, കേൾവി, കാഴ്ച മുതലായവ കാണുകയും ചെയ്യുന്നു.

ശരീരത്തിലെ മറ്റേതൊരു കോശത്തെയും പോലെ, കോശങ്ങളോ മസ്തിഷ്ക കോശങ്ങളോ മരിച്ചുപോയാൽ നമുക്ക് നമ്മുടെ അറിവോ ചിന്തിക്കാനുള്ള കഴിവോ നഷ്ടപ്പെടും.

ഡാറ്റ ഉപയോഗിച്ചാലുടൻ പരിശീലിപ്പിക്കുന്നതിനായി ജൈവശാസ്ത്രപരമായി നിർമ്മിച്ച ഒരു അൽഗോരിതത്തിൽ എല്ലാ ഡാറ്റയും ഇൻപുട്ടായി എടുക്കുന്നതിലൂടെ, പുതിയ കണക്ഷനുകൾ രൂപം കൊള്ളുന്നു. രസകരമായ ഒരു കാര്യം, രൂപപ്പെടുന്ന കണക്ഷനുകൾ ഉപഭോഗം ചെയ്യപ്പെടുന്ന ഡാറ്റ മൂലമാണ്, പക്ഷേ യാദൃശ്ചികമല്ല.

രൂപപ്പെടുന്ന കണക്ഷനുകൾ ഉപഭോഗ ഡാറ്റയെ അടിസ്ഥാനമാക്കി സവിശേഷവും വ്യത്യസ്തവുമാണ്.

ഉദാഹരണം:

ഒരു ചൂടുള്ള വസ്തുവിൽ സ്പർശിച്ച് പരിക്കേറ്റ ഒരു കുട്ടിയെക്കുറിച്ച് നമുക്ക് ചിന്തിക്കാം, ഈ സാഹചര്യത്തിൽ ഒരു പുതിയ ന്യൂറൽ കണക്ഷൻ രൂപപ്പെടും, കണക്ഷനുകൾ വ്യത്യാസപ്പെടുന്ന കേസുകളെ ആശ്രയിച്ചിരിക്കുന്നു.

വേദന അനുഭവിച്ച വ്യക്തിക്ക് ന്യൂറൽ കണക്ഷന്റെ സാങ്കൽപ്പിക പ്രാതിനിധ്യം.

മധുരം രുചിച്ച വ്യക്തിക്ക് ന്യൂറൽ കണക്ഷന്റെ സാങ്കൽപ്പിക പ്രാതിനിധ്യം.

ഡാറ്റയെ അടിസ്ഥാനമാക്കി, ന്യൂറോണുകൾ പെരുമാറ്റം പഠിക്കും. ശാരീരിക അനുഭവത്തിലൂടെ നേരിട്ട് രൂപപ്പെട്ട കണക്ഷനുകൾ (അല്ലെങ്കിൽ) നമ്മെ അറിയിക്കുന്ന ഒരാൾ, ഈ രീതിയിൽ ന്യൂറോണുകൾ പെരുമാറ്റം പഠിക്കുന്നു.

ഒരു ഉദാഹരണം എടുക്കാൻ, ഒരു കുട്ടി അവനെ വേദനിപ്പിക്കുന്നുവെന്ന് അറിയാൻ എല്ലായ്പ്പോഴും ചൂടുള്ള വസ്തുവിൽ സ്പർശിക്കേണ്ട ആവശ്യമില്ല. മാതാപിതാക്കളുടെയോ മറ്റൊരാളുടെയോ അനുഭവം കേട്ടുകൊണ്ട് അവന് ഇത് പഠിക്കാൻ കഴിയും.

എല്ലാ പഠനങ്ങളും, ഈ സാഹചര്യത്തിൽ ന്യൂറോണുകളുടെ ബയോളജിക്കൽ പഠനങ്ങൾ, പഠനം, പെരുമാറ്റം (അല്ലെങ്കിൽ) അനുഭവം അനുസരിച്ച് ന്യൂറൽ കണക്ഷനുകളുടെ ഭാരങ്ങളല്ലാതെ മറ്റൊന്നുമല്ല. ഈ ആശയങ്ങൾ “ആർട്ടിഫിഷ്യൽ ന്യൂറൽ നെറ്റ് വർക്കുകളുമായി” താരതമ്യേന നന്നായി ബന്ധിപ്പിക്കും.

ഭാരം “0” ന് തുല്യമാണെങ്കിൽ കണക്ഷൻ ഇല്ല. ഭാരം വർദ്ധിച്ചാൽ കണക്ഷനുകൾ രൂപപ്പെടുന്നു.

എഎൻഎന്നിൽ, പഠനം എന്നത് ചില അറ്റങ്ങളുള്ള വിവിധ സിംഗിൾ ന്യൂറോണുകളുമായി ബന്ധിപ്പിക്കുകയല്ലാതെ മറ്റൊന്നുമല്ല, അവയിൽ കുറച്ച് ഭാരങ്ങളുമുണ്ട്, അതാണ് പഠനം. പഠനം നടക്കുന്നത് ഡാറ്റയിലൂടെയാണ്. ഇതിനർത്ഥം ആർട്ടിഫിഷ്യൽ ന്യൂറൽ നെറ്റ് വർക്കിൽ (അല്ലെങ്കിൽ) ഒരു കമ്പ്യൂട്ടേഷണൽ ന്യൂറൽ നെറ്റ് വർക്കിൽ പോലും ഈ ഭാര പഠനം ഭാരം കണക്കുകൂട്ടൽ അല്ലാതെ മറ്റൊന്നുമല്ല.

ലോജിസ്റ്റിക് റിഗ്രഷൻ & പെർസെപ്റ്റോൺ:

പോസിറ്റീവ്, നെഗറ്റീവ് പോയിന്റുകൾ ജ്യാമിതീയമായി വേർതിരിക്കുന്നതിനുള്ള അറിയപ്പെടുന്ന സാങ്കേതികതയാണ് ലോജിസ്റ്റിക് റിഗ്രഷൻ. പ്രവചിക്കപ്പെട്ട മൂല്യങ്ങളിലേക്കുള്ള മാപ്പിംഗ് ഇൻപുട്ടുകളായി ഒരു ന്യൂറോണിന്റെ വീക്ഷണകോണിൽ നിന്ന് ഇത് മനസ്സിലാക്കാൻ കഴിയും.

പെർസെപ്റ്റോൺ ഒരു ലീനിയർ ക്ലാസിഫയറായി പ്രവർത്തിക്കുന്നു, ലോജിസ്റ്റിക് റിഗ്രഷനിൽ ഉപയോഗിക്കുന്ന സ്ക്വാഷിംഗ് ഫംഗ്ഷൻ ഇല്ലാതെ തന്നെ പോയിന്റുകൾ വർഗ്ഗീകരിക്കുന്നതിനുള്ള ഒരു രേഖ കണ്ടെത്താൻ ശ്രമിക്കുന്നു.

രണ്ട് വ്യത്യസ്ത പോയിന്റുകൾ തരംതിരിക്കുന്നു.

ഇപ്പോൾ, ഒരു ന്യൂറോണിന്റെ വീക്ഷണകോണിൽ നിന്ന് ലോജിസ്റ്റിക് റിഗ്രഷന്റെ വിശദീകരണത്തിലേക്ക് പോകാം.

ഗണിതപരമായ വിശദീകരണം:

^yi = Sigmoid (wTxi+b), ഇവിടെ xi ഒരു R-dimensional space-ൽ ഉൾപ്പെടുന്നു.

പരിശീലന ലോജിസ്റ്റിക് റിഗ്രഷൻ ഭാരം വെക്റ്റർ (ഡബ്ല്യു), പക്ഷപാതം (ബി) എന്നിവ കണ്ടെത്തുന്നതിൽ ഉൾപ്പെടുന്നു. പരിശീലനം സ്റ്റൊകാസ്റ്റിക് ഗ്രേഡിയന്റ് ഡിസന്റ് (എസ്ജിഡി) ഉപയോഗിക്കുന്നു.

ഇതിനു വിപരീതമായി, 1957 ൽ റോസെൻബ്ലാറ്റ് വികസിപ്പിച്ചെടുത്ത പെർസെപ്റ്റോൺ ലോജിസ്റ്റിക് റിഗ്രഷനുമായി സാമ്യമുള്ളതാണ്, പക്ഷേ അതിന്റെ സജീവമാക്കൽ പ്രവർത്തനത്തിൽ വ്യത്യാസമുണ്ട്. പെർസെപ്റ്റോണിന്റെ ആക്റ്റിവേഷൻ പ്രവർത്തനം ബൈനറിയാണ്: 1 ഉണ്ടെങ്കിൽ (WTXi+b) > 0, അല്ലാത്തപക്ഷം 0.

ഒരു എൽആറിന്റെ കാര്യത്തിൽ ഫിഗ്മോയിഡ് പ്രവർത്തനം

SGD ഉപയോഗിച്ചുകൊണ്ട് ഞങ്ങൾ LR-നെ പരിശീലിപ്പിക്കുന്നു. (LR and Optimization case.)

ഒരു ന്യൂറൽ നെറ്റ് വർക്കിനെ പരിശീലിപ്പിക്കുന്നതിന്റെ ഏറ്റവും പ്രധാനപ്പെട്ട ഭാഗം അരികുകളിൽ / വെർട്ടീസുകളിൽ ഭാരം കണ്ടെത്തുകയല്ലാതെ മറ്റൊന്നുമല്ല.

LR = > ന്യൂറോൺ (ഞങ്ങൾ ആക്റ്റിവേഷൻ ഫംഗ്ഷൻ ചെയ്യുമ്പോൾ ന്യൂറോണിനെ സിഗ്മോയിഡ് അല്ലെങ്കിൽ ലോജിസ്റ്റിക് ഫംഗ്ഷനായി അവതരിപ്പിക്കുന്നു).

Perceptron:

1957 ൽ റോസൻ ബ്ലാറ്റ് ആണ് പെർസെപ്റ്റോൺ എന്ന ആശയം സൃഷ്ടിച്ചത്. ചില വ്യത്യാസങ്ങളുള്ള ലോജിസ്റ്റിക് റിഗ്രഷൻ എന്ന ആശയവുമായി ഈ ആശയം വളരെ സാമ്യമുള്ളതാണ്.

എൽആർ, പെർസെപ്റ്റോൺ എന്നിവയിലെ ഒരേയൊരു വ്യത്യാസം ആക്ടിവേഷൻ ഫംഗ്ഷനാണ്.

ΣWjXij + b (j = 1 -> d)

f(x) = { 1 if WTXi+b > 0 ; 0 അല്ലാത്തപക്ഷം.}

ഒരു ബയോളജിക്കൽ ന്യൂറോണിന്റെ ആശയം, അപ്പോൾ, വലുപ്പങ്ങളിൽ വ്യത്യാസമുള്ള ചില ഇൻപുട്ടുകൾ ഞങ്ങൾക്ക് ലഭിക്കും; അവയുടെ ഭാരത്തെ അടിസ്ഥാനമാക്കി കട്ടിയുള്ളതും നേർത്തതുമാണ്, ഈ ന്യൂറോൺ പിന്നീട് തീപിടിക്കുന്നു (അല്ലെങ്കിൽ) പ്രേരിപ്പിക്കുന്നില്ല; ഒരു മൂല്യത്തിന്റെ ഉത്പാദനത്തെ സൂചിപ്പിക്കുന്ന ഇവിടെ ട്രിഗറിംഗ് അല്ലെങ്കിൽ തീ; പ്രേരിപ്പിച്ചില്ലെങ്കിൽ ഫല മൂല്യം “0” ആണ്.

പെർസെപ്റ്റോൺ ഒരു ലീനിയർ ക്ലാസിഫയറാണ്. ജ്യാമിതീയ സ്റ്റാൻഡ് പോയിന്റിൽ നിന്ന്, ഒരു പെർസെപ്റ്റോൺ അല്ലെങ്കിൽ ഒരു പെർസെപ്റ്റോൺ അതിനനുസരിച്ച് പോയിന്റുകളെ തരംതിരിക്കാൻ ഒരു രേഖ കണ്ടെത്താൻ ശ്രമിക്കുന്നു. ഒരേയൊരു വ്യത്യാസം എൽആറിന് പെർസെപ്റ്റോണിൽ “സ്ക്വാഷിംഗ് അല്ലെങ്കിൽ സിഗ്മോയിഡ് ഫംഗ്ഷൻ” ഉണ്ട് എന്നതാണ്.

മെഷീൻ ലേണിംഗിൽ ഇതുവരെ ഉപയോഗിച്ചിട്ടുള്ളതിൽ ഏറ്റവും പഴയ മോഡലാണ് പെർസെപ്റ്റോൺ.

എന്നാൽ കാത്തിരിക്കുക, പെർസെപ്റ്റോണിനെ എങ്ങനെ പരിശീലിപ്പിക്കും?

തീർച്ചയായും, ഞങ്ങൾക്ക് SGD ഉണ്ട്.

ലീനിയർ, ലോജിസ്റ്റിക് റിഗ്രഷനിൽ എസ്ജിഡി എങ്ങനെ ഉപയോഗിക്കാമെന്നും ഞങ്ങൾക്കറിയാം. എന്നാൽ ഒരു പെർസെപ്ട്രോണിനെ പരിശീലിപ്പിക്കുക എന്നാൽ അരികുകളുടെ ഭാരം കണക്കാക്കുക (അല്ലെങ്കിൽ) ഗ്രേഡിയന്റ് ഡിസെന്റ് സമീപനങ്ങളിൽ ഏതെങ്കിലും ഉപയോഗിക്കുക എന്നാണ് അർത്ഥമാക്കുന്നത്.

എൽആർ, പെർസെപ്റ്റോൺ എന്നിവ ഒരു ലളിതമായ സിംഗിൾ ന്യൂറോൺ മോഡലുകളായി നമുക്ക് പലപ്പോഴും ചിന്തിക്കാൻ കഴിയും. ഒരേയൊരു വ്യത്യാസം എൽആറിൽ ഞങ്ങൾ “സിഗ്മോയിഡ്” ഉപയോഗിക്കുന്നു, പെർസെപ്റ്റോണിൽ ഞങ്ങൾക്ക് ഒരു ഫംഗ്ഷനുണ്ട്, അതിൽ അത് “0” (അല്ലെങ്കിൽ) ആണെങ്കിലും മൂല്യത്തെക്കുറിച്ച് പറയുന്നു.

Multi Layered Perceptron (MLP):

പെർസെപ്റ്റോൺ ഒരു ന്യൂറോണിന്റെ ലളിതമായ പതിപ്പിനെ പ്രതിനിധീകരിക്കുന്നു, കൂടാതെ ലോജിസ്റ്റിക് റിഗ്രഷനുമായി ചില സാമ്യതകൾ പങ്കിടുന്നു. സിംഗിൾ-ന്യൂറോൺ മോഡൽ അല്ലെങ്കിൽ പെർസെപ്റ്റോണിൽ, ലോജിസ്റ്റിക് റിഗ്രഷന് സമാനമായ ഇൻപുട്ട്, ഔട്ട്പുട്ട് പാളികൾ ഉണ്ട്.

എന്നിരുന്നാലും, ഒരു മൾട്ടി-ലേയേർഡ് പെർസെപ്റ്റോൺ (എം എൽ പി) ഒന്നിലധികം പാളികൾ അവതരിപ്പിക്കുന്നു, ഓരോന്നും ഒരു പെർസെപ്റ്റോൺ അല്ലെങ്കിൽ ന്യൂറോണിന് സമാനമാണ്. ഓരോ പാളിയിലും ഒരു ഫംഗ്ഷൻ അടങ്ങിയിരിക്കുന്നു, അത് സമാനമോ വ്യത്യസ്തമോ ആകാം.

സിംഗിൾ ന്യൂറോൺ അല്ലെങ്കിൽ പെർസെപ്റ്റോൺ.

ഒരൊറ്റ ന്യൂറോൺ മോഡലിൽ (അല്ലെങ്കിൽ) ഒരു പെർസെപ്റ്റോണിൽ നമുക്ക് ഒരു ഇൻപുട്ട് ലെയറും ലോജിസ്റ്റിക് റിഗ്രഷനിലെ പോലെ ഔട്ട്പുട്ട് ലെയറും ഉണ്ടാകും.

ന്യൂറൽ നെറ്റ് വർക്ക്.

മുകളിൽ പറഞ്ഞ ന്യൂറൽ നെറ്റ് വർക്കിനെ “മൾട്ടി ലേയേർഡ് പെർസെപ്റ്റോൺ” എന്നും വിളിക്കുന്നു. ഇവിടെ ഒന്നിലധികം പാളികളുണ്ട്, അവ ഓരോന്നും പെർസെപ്റ്റോണുകളായി കണക്കാക്കാം. ഓരോ ന്യൂറോണിലും (അല്ലെങ്കിൽ) പെർസെപ്റ്റോണിൽ ഒരു പ്രവർത്തനം ഉണ്ട്, അത് ഒരേ പ്രവർത്തനമോ വ്യത്യസ്ത പ്രവർത്തനമോ ആകട്ടെ.

ഇതിന് എന്തെങ്കിലും കാരണമുണ്ടോ, എന്തുകൊണ്ടാണ് ഞങ്ങൾ എം എൽ പിയെ ശ്രദ്ധിക്കേണ്ടത്?

വാസ്തവത്തിൽ, ഒന്നിലധികം ഉണ്ട്, പക്ഷേ ഇത് രണ്ട് വാദങ്ങളിൽ ചർച്ച ചെയ്യാം.

ബയോളജിക്കൽ പ്രചോദനം: ന്യൂറോ സയൻസിൽ, ന്യൂറോണുകളുടെ സങ്കീർണ്ണമായ ഘടനകൾ വളരെയധികം പരസ്പരബന്ധിതമാണ്, മൾട്ടി-ലേയേർഡ് ഘടനകൾ സ്വീകരിക്കാൻ പ്രചോദനമായി. ഈ ഘടനകൾ ഒരൊറ്റ ഗ്രഹണങ്ങളേക്കാൾ ശക്തമാണെന്ന് തെളിഞ്ഞു.

ന്യൂറോണുകൾക്കായുള്ള ഒരു ശൃംഖലയിലെ ഒന്നിലധികം കണക്ഷനുകളുടെ സാങ്കൽപ്പിക രേഖാചിത്രം

മൾട്ടി ലേയേർഡ് ഘടനയ്ക്ക് കൂടുതൽ നേട്ടങ്ങൾ കൊണ്ടുവരാൻ കഴിയുന്നതിനാൽ ഒരൊറ്റ പെർസെപ്റ്റോൺ ഉപയോഗിക്കുന്നതിനേക്കാൾ റഫറൻസിനായി ഒരു ന്യൂറൽ ഘടന ഉപയോഗിക്കുന്നത് കൂടുതൽ ശക്തവും ഉപയോഗപ്രദവുമാണെന്ന് അവർ കണ്ടെത്തിയത് അങ്ങനെയാണ്.

ഗണിതശാസ്ത്രപരമായ വാദം:

പാളികൾ ചേർത്തും ലളിതമായ ഗണിത പ്രവർത്തനങ്ങൾ പ്രയോഗിച്ചും സങ്കീർണ്ണമായ പ്രശ്നങ്ങൾ പരിഹരിക്കാൻ എം എൽ പികൾ അനുവദിക്കുന്നു. വളരെ സങ്കീർണ്ണമായ പ്രശ്നങ്ങൾ പോലും ഈ ലെയറിംഗ് ടെക്നിക്കിലൂടെ പരിഹരിക്കാൻ കഴിയും.

ഞങ്ങൾ ഇതുവരെ നടത്തിയ പ്രധാന ചർച്ചയിൽ നിന്ന് അൽപ്പം വ്യതിചലിച്ചുകൊണ്ട് ഒരു പിന്നോക്ക പ്രശ്നത്തിന്റെ ഉദാഹരണം എടുക്കാം.

മേൽപ്പറഞ്ഞ സങ്കീർണ്ണമായ പ്രശ്നത്തിനായി പ്ലോട്ട് ചെയ്യുക.

D = {xi, yi}. “xi” നെ “യി” യുമായി ബന്ധിപ്പിക്കുന്ന ഫംഗ്ഷൻ F(xi) കണ്ടെത്തുക; (yi E Real Numbers)

ലളിതമായ ഫംഗ്ഷനുകളും പാളികളും ചേർത്തുകൊണ്ട് സങ്കീർണ്ണമായ പ്രശ്നം ലളിതമാക്കുക.

ഫംഗ്ഷനുകളുടെ സീക്വൻസുകളിലൂടെ ഞങ്ങൾ ഇൻപുട്ടുകൾ കൈമാറുന്നു. മൾട്ടി ലേയേർഡ് പെർസെപ്റ്റോൺ പോലുള്ള ഘടനകൾ ഉപയോഗിച്ച് ഇപ്പോൾ നമുക്ക് ഒരു സങ്കീർണ്ണമായ ഫംഗ്ഷൻ f(x) = 2 sin (x^2) + √5x പ്രതിനിധീകരിക്കാൻ കഴിയും.

ഒരു മൾട്ടി-ലേയേർഡ് ഘടന ഉപയോഗിക്കുന്നതിലൂടെ, നമ്മുടെ പ്രശ്നം പരിഹരിക്കുന്നതിന് സങ്കീർണ്ണമായ ഗണിത പ്രവർത്തനങ്ങൾ കൊണ്ടുവരാൻ കഴിയും.

മൾട്ടി-ലേയേർഡ് പെർസെപ്റ്റോൺ ഘടന മോഡലുകൾക്ക് വളരെയധികം ശക്തി നൽകുന്നു.

{ഏറ്റവും ലളിതമായ മോഡൽ ലീനിയർ മോഡൽ ആണ്. ഡാറ്റ രേഖീയമല്ലെങ്കിൽ, RBF-SVM (സപ്പോർട്ട് വെക്റ്റർ മെഷീൻ), RF, GBDT പോലുള്ള നോൺ-ലീനിയർ മോഡലുകൾ.

മേൽപ്പറഞ്ഞവയ്ക്കായി ഫംഗ്ഷനുകളുടെ ക്രമം ഉപയോഗിച്ചും വളരെ ശക്തമായ അവ പ്രയോഗിച്ചും ഞങ്ങൾ നോൺ-ലീനിയറിറ്റി സൃഷ്ടിക്കുന്നു. ഇത് ഹൈസ്കൂൾ ആശയത്തിനും ഫംഗ്ഷൻ ഘടനയ്ക്കും ഒരുപോലെ പ്രസക്തമാണ്. [F(g(x)) ; G(f(x))]

യി = 2 sin (x^2) + √5x;

F(x) നമുക്ക് ഈ F(x) എന്നത് f1,f2,f3,f4,f5 എന്നിങ്ങനെ എഴുതാം,…. മുതലായവ..

F(x) = 2 sin (x^2) + √5x

യി = 2 sin (x^2) + √5x; ഇങ്ങനെ എഴുതാം:

f5(2,sinx)

f5(2,f4)

f5(2,f4(f2(x))

F(x) = f1(2,f4(f2(x)), f3(f5(x,5)))

മൾട്ടി ലേയേർഡ് പെർസെപ്റ്റോൺ ഫംഗ്ഷൻ കോമ്പോസിഷൻ ആശയത്തിന് സമാനമാണ്.

MLP-യിലെ ഫംഗ്ഷൻ കോമ്പോസിഷൻ എന്ന ആശയം F(g(x)), G(f(x)എന്നിവയുമായി സാമ്യമുള്ളതാണ്. പാളികൾ ചേർക്കുന്നതിലൂടെ, സങ്കീർണ്ണമായ ഗണിത പ്രവർത്തനങ്ങൾ ലളിതമായവയുടെ രചനകളായി പ്രതിനിധീകരിക്കാൻ കഴിയും. ഈ സമീപനം ന്യൂറൽ നെറ്റ് വർക്കുകളിലും ഡീപ് ലേണിംഗ് ലും ഒരു അടിസ്ഥാന ആശയമാണ്.

എന്നിരുന്നാലും, മൾട്ടി-ലേയേർഡ് ഘടനകൾ ശക്തമായ മോഡലുകൾക്ക് കാരണമാകുമെങ്കിലും, അവ അമിതമായി ഫിറ്റിംഗ് ചെയ്യാൻ സാധ്യതയുണ്ട് എന്നതാണ് ഒരു മുന്നറിയിപ്പ്. ഡീപ് ലേണിംഗ് ൽ അണ്ടർ ഫിറ്റിംഗ്, ഓവർഫിറ്റിംഗ് എന്നിവ തമ്മിലുള്ള സന്തുലിതാവസ്ഥ ഒരു നിർണായക ദൗത്യമാണ്.

ചുരുക്കത്തിൽ, ഡീപ് ലേണിംഗ് ലും മെഷീൻ ലേണിംഗിലും മൾട്ടി-ലേയേർഡ് പെർസെപ്റ്റോൺ (എം എൽ പി) ഒരു പ്രധാന ആശയമാണ്. ലളിതമായ ഫംഗ്ഷനുകൾ സംയോജിപ്പിച്ചുകൊണ്ട് സങ്കീർണ്ണമായ പ്രശ്നങ്ങൾ കൈകാര്യം ചെയ്യാൻ അനുവദിക്കുന്ന ഫംഗ്ഷൻ കോമ്പോസിഷൻ എന്ന ആശയം ഇത് അവതരിപ്പിക്കുന്നു.

ശക്തമായ മോഡലുകളുള്ള മൾട്ടി-ലേയേർഡ് ഘടനയ്ക്ക് എളുപ്പത്തിൽ യോജിക്കാൻ കഴിയും.

മുഴുവൻ ഡീപ് ലേണിംഗ് മോഡലുകളിലും ഒരുപക്ഷേ മുഴുവൻ മെഷീൻ ലേണിംഗിലും മൾട്ടി ലേയേർഡ് പെർസെപ്റ്റോൺ വളരെ പ്രധാനപ്പെട്ടതും രസകരവുമായ ആശയങ്ങളാണ്.

കുറിപ്പുകൾ:

D = {xi, yi} ; xi E യഥാർത്ഥ സംഖ്യ – > റിഗ്രഷൻ പ്രശ്നം.

ചിത്രങ്ങള് :

Xij = > “i” index & “j” സവിശേഷത

Fij = > “i” ലെയർ നമ്പർ; “j” ഫംഗ്ഷൻ സൂചിക.

k – > അടുത്ത ലെയർ.

Wij = > ഭാരം; ഇൻപുട്ടിൽ നിന്ന് “i”, “j” എന്നത് ന്യൂറോണിലേക്ക്.

മൾട്ടി ലേയേർഡ് ന്യൂറൽ കണക്ഷൻ.

ഇവിടെ, സാധ്യമായ ഓരോ ജോഡിക്കും പാളികളിൽ സാധ്യമായ എല്ലാ കണക്ഷനുകളും ഞങ്ങൾ ബന്ധിപ്പിക്കുന്നു.

ഞങ്ങൾക്ക് ലഭ്യമായ എല്ലാ കണക്ഷനുകളും ഉള്ള ഒരു നെറ്റ് വർക്കിനെ “പൂർണ്ണമായും കണക്റ്റുചെയ് ത ന്യൂറൽ നെറ്റ് വർക്ക്” (അല്ലെങ്കിൽ) ഇന്റർ ലെയർ കണക്ഷനുകൾ ഒഴികെയുള്ള “പൂർണ്ണമായും കണക്റ്റുചെയ് ത മൾട്ടി ലേയേർഡ് പെർസെപ്റ്റോൺ” എന്ന് വിളിക്കുന്നു. നമുക്ക് ഒരു ഘട്ടത്തിൽ നിന്ന് മറ്റൊന്നിലേക്ക് (അല്ലെങ്കിൽ) ഒരു പാളിയെ മറ്റൊരു പാളിയിലേക്ക് മാത്രമേ ബന്ധിപ്പിക്കാൻ കഴിയൂ.

ഇപ്പോൾ നമുക്ക് ആദ്യത്തെ ന്യൂറോണിന്റെ വീക്ഷണകോണിൽ നിന്ന് നോക്കാം:

ആദ്യ പാളിയിൽ നിന്ന്; അതിനനുസൃതമായി ഭാരങ്ങൾ നൽകിയിരിക്കുന്നു.

W11, W12, W13 എന്നിവയാണ് ആദ്യ ഇൻപുട്ടിൽ നിന്ന് ആദ്യ പാളിയിലേക്കുള്ള ഭാരം.

Xi1 -> f11, f12, f13.

Xi2 -> f11, f12, f13 = > W21, W22, W23

Xi3 -> f11, f12, f13 = > W31, W32, W33

Xi4 (Input) -> f11, f12, f13 (Edges) => W41, W42, W43 (ഭാരങ്ങൾ).

ഈ ഭാരങ്ങളെ 4 X 3 മാട്രിക്സ് ആയി പ്രതിനിധീകരിക്കാം; 4 നിരകളും 3 നിരകളും.